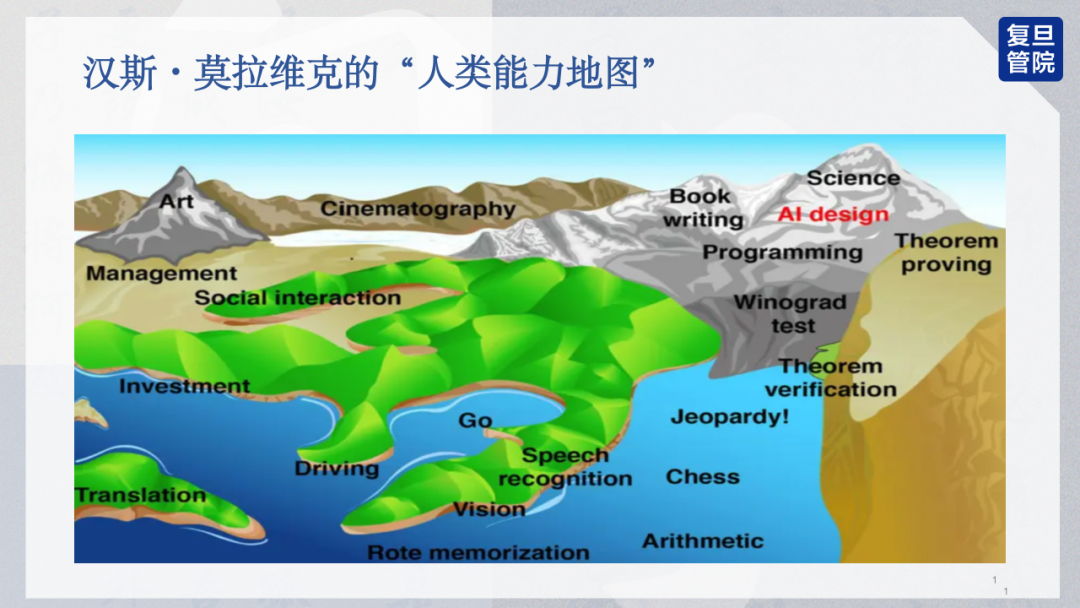

欢迎大家收听「开挂」~自AlphaGo到ChatGPT,AI技术开始具备了通用人类意图理解和思维链的能力,在兴奋之余,我们也开始思考机器智能是否可能超越人类智能,AI会不会带来负面的效果,我们是不是要为AI踩刹车?

本期内容来自复旦管院出品「问学」系列,我们邀请到复旦管院信息管理与商业智能系张成洪教授,张老师将与大家分享AI算法的“治”与“理”。

【对话嘉宾】张成洪老师

【你将会听到】

01:28 机器已经超越人类?

04:41 AI的近忧

06:47 AI算法治理的定义

07:30 打开“黑匣子”,AI算法治理的难点

08:26 AI算法治理的三个层次

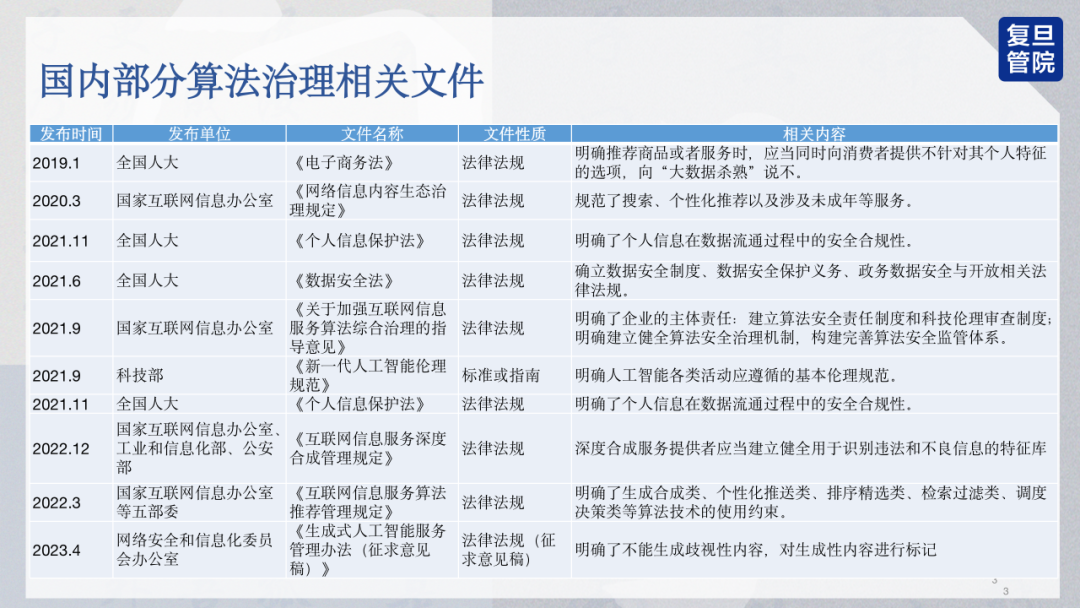

09:41 AI算法治理的政策法规

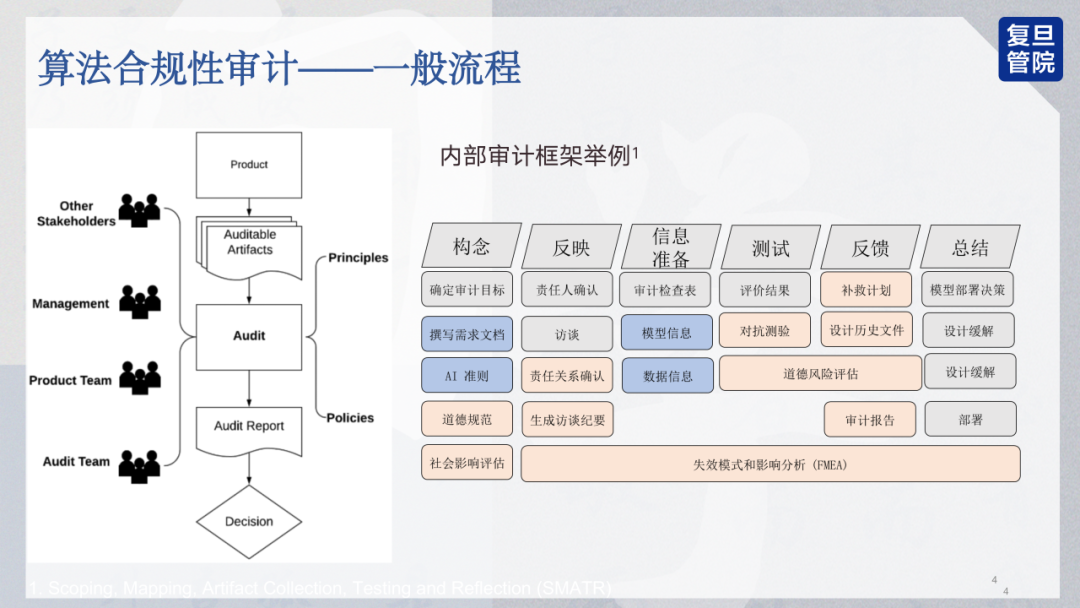

10:29 为什么算法需要合规性审计?算法公开程度 VS 算法知识产权保护

12:12 AI算法合规性审计的困难在哪里?

13:26 AI算法合规性审计的测试方法

14:33 AI算法合规性审计的评价指标案例:公平性问题的识别

16:02 AI算法合规性审计的评价指标案例:信息茧房

17:33 造成算法歧视的原因是什么?

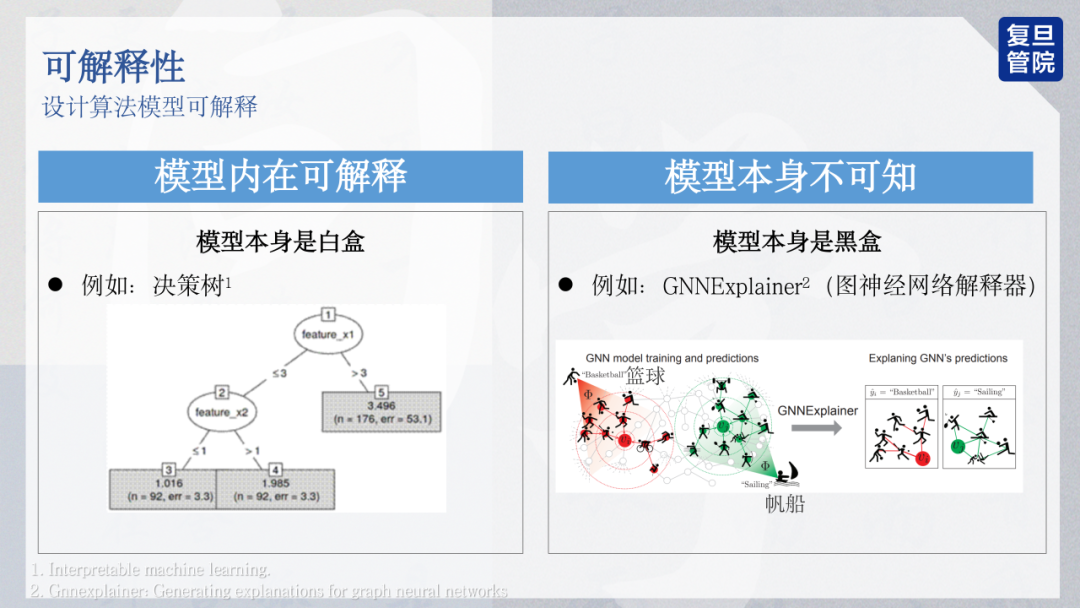

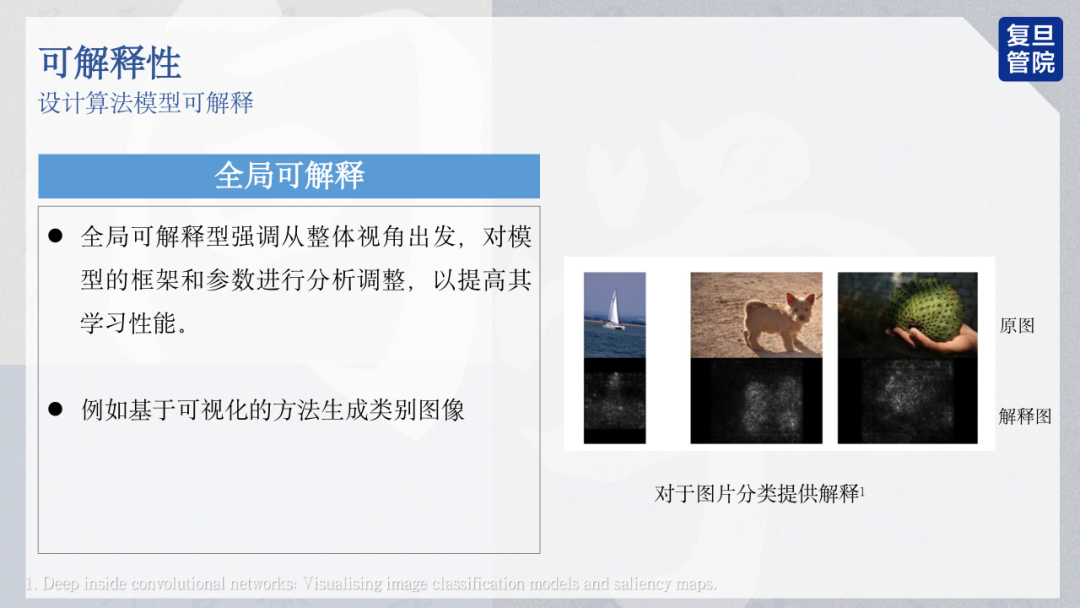

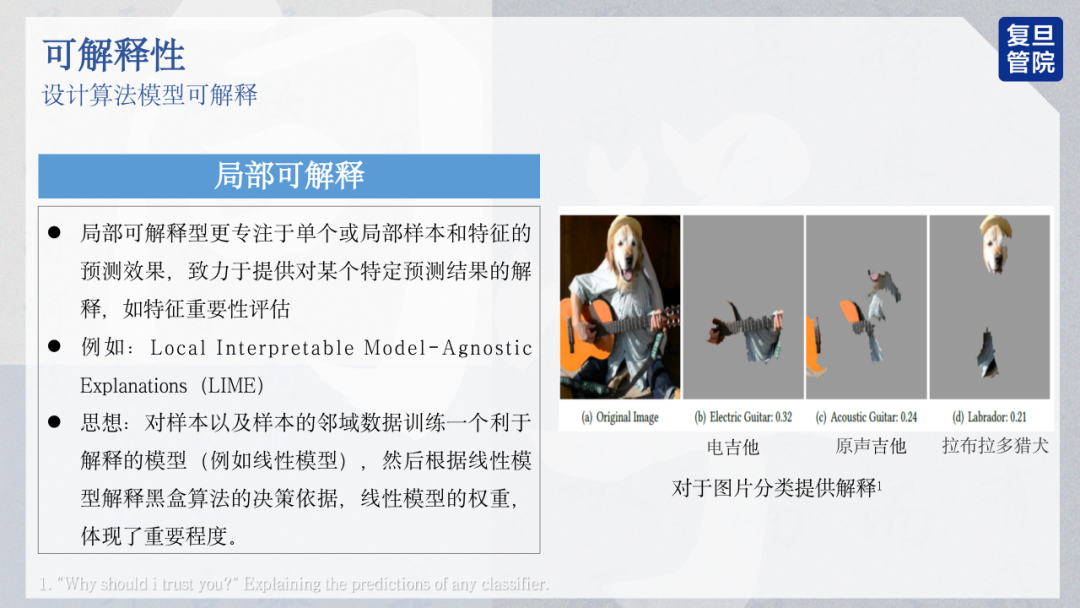

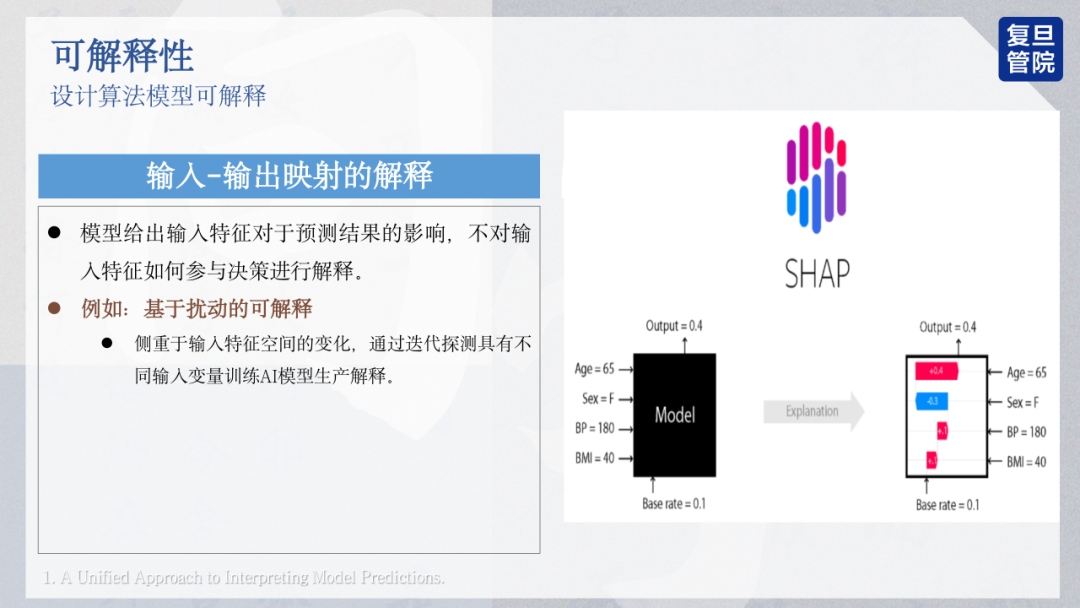

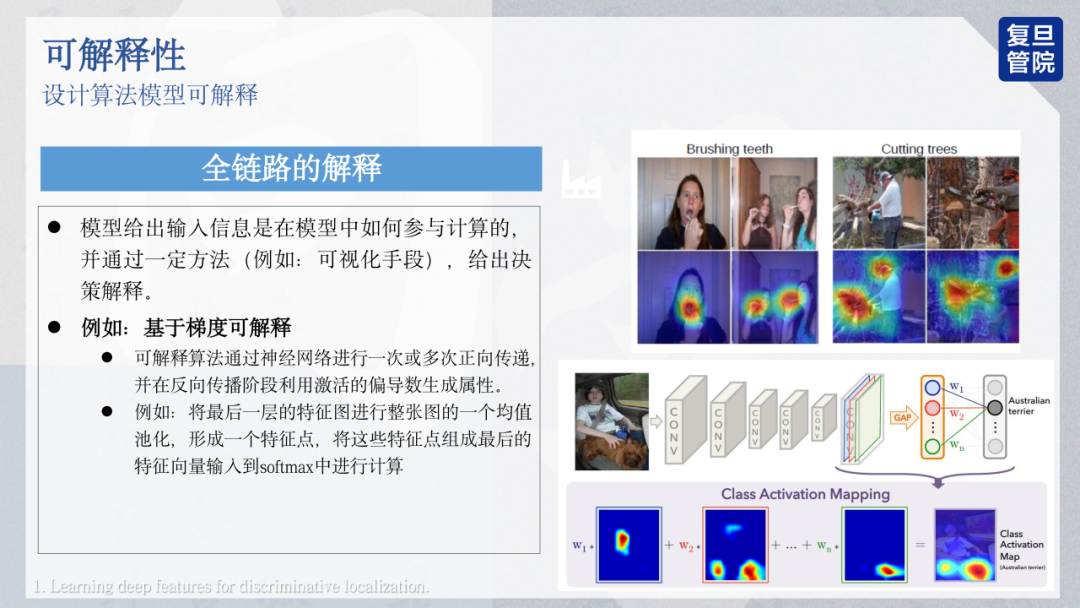

19:17 可解释性:设计算法模型可解释

全局可解释 ↓

局部可解释 ↓

输入-输出映射的解释 ↓

全链路的解释 ↓

22:59 隐私性保护:联邦学习

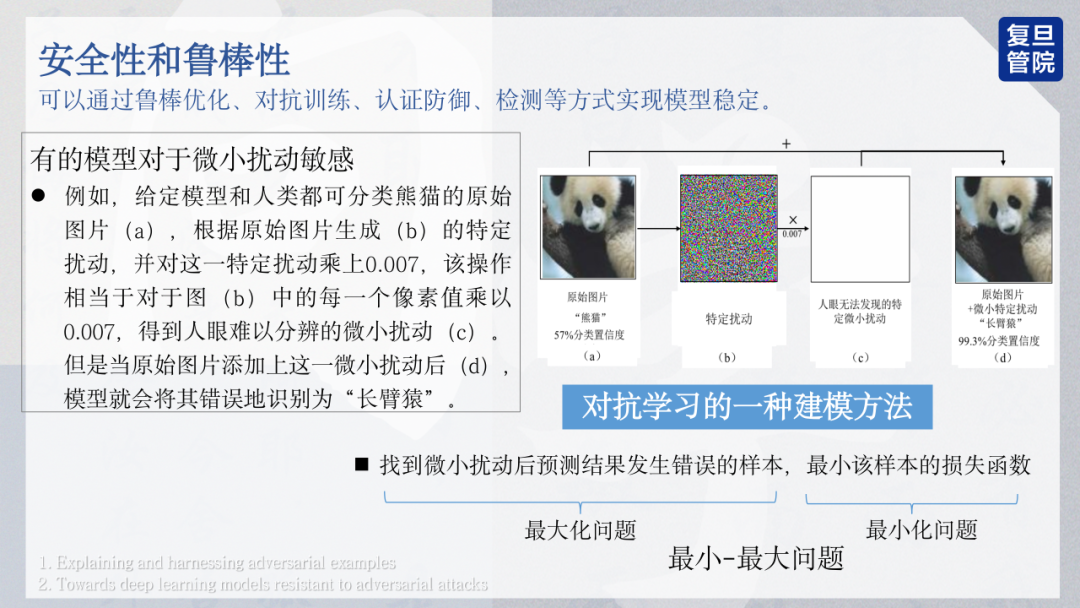

25:05 安全性和鲁棒性:实现模型稳定

【你还可以在这里找到我们】

小红书:复旦大学管理学院

哔哩哔哩:复旦大学管理学院

微信公众号:复旦管院

【欢迎入群】

加听友群:Fiona_sunr

音频剪辑:Eskild

【你将了解到更多】

扫描海报二维码,了解复旦管院最新“问学”系列

27

27 1

1