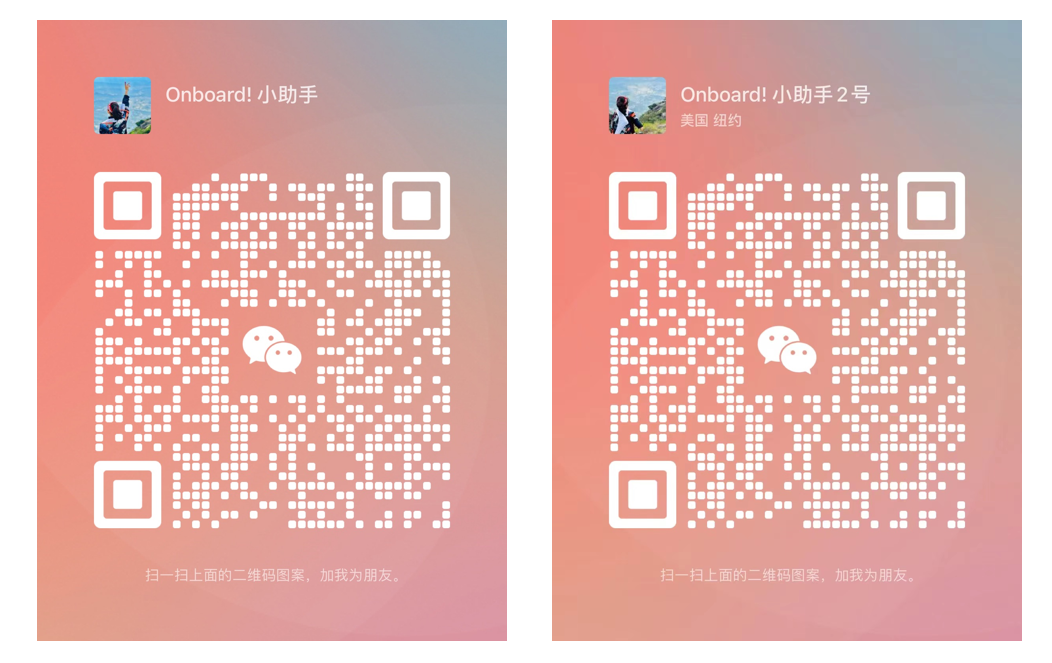

OnBoard! 终于成立听友群啦!新年新气象,加入Onboard听友群,结识到高质量的听友们,我们还会组织线下主题聚会,开放实时旁听播客录制,嘉宾互动等新的尝试。添加任意一位小助手微信,onboard666, 或者 Nine_tunes, 发送你的姓名、公司和职位,小助手会拉你进群。期待你来!

久违的一对一访谈回来啦!这次的嘉宾绝对重磅,贾扬清老师,关注AI领域的同学应该都听过他的鼎鼎大名!他在 UC Berkeley 博士期间创立了深度学习框架 Caffe, 很快成为行业事实标准。先后在 Google Brain, Facebook AI 从事最前沿的AI研究,随后又担任了阿里巴巴技术副总裁,领导大数据计算平台。2023年开始新征程,在硅谷创立了 Lepton AI.

Hello World, who is OnBoard!?

作为AI和infra行业的行业领军人物,扬清老师是如何思考自己AI创业的方向的?他如何理解未来AI对于基础设施的需求,跟云计算这么多年的发展有哪些异同的地方?这一年以来,回到世界AI创新中心的硅谷,他对于AI和创业的理解、开发者工具和应用的价值、开源和闭源模型等等话题,都有怎样的思考迭代?

我们不知不觉又聊了近两个小时,真是干货满满,你也能感受到扬清条理清晰、观点犀利,又温和儒雅,实在是太令人享受的谈话了。这大概就是播客的魅力,让我们在文字之外,感受到更真实鲜活的人。

嘉宾长期在美国工作生活,有英文在所难免,不接受抱怨!Enjoy!

嘉宾介绍

贾扬清(推特:@jiayq),Lepton.ai 创始人。本科和研究生阶段就读于清华大学自动化专业,后赴加州大学伯克利分校攻读计算机科学博士。他在博士期间创立并开源了如今业内耳熟能详的深度学习框架Caffe,被微软、雅虎、英伟达、Adobe 等公司采用。2013年毕业后,他加入谷歌,是谷歌大脑 TensorFlow 的作者之一。2016年2月加盟Facebook,并开发出Caffe2Go、Caffe2、PyTorch等深度学习框架。2019 年加入阿里巴巴,担任阿里巴巴集团副总裁、阿里云智能计算平台事业部总裁。

嘉宾主持:戴雨森,真格基金合伙人,清华大学工业工程系2004级校友,曾在斯坦福大学管理科学与工程系就读。戴雨森22岁时参与创办了知名互联网上市公司聚美优品,主管互联网产品、运营、市场投放、品类等。加入真格基金之后,主要关注人工智能方向投资。

OnBoard! 主持:Monica:美元VC投资人,前 AWS 硅谷团队+ AI 创业公司打工人,公众号M小姐研习录 (ID: MissMStudy) 主理人 | 即刻:莫妮卡同学

我们都聊了什么

02:14 主持和嘉宾的自我介绍,Lepton 最近一篇论文为什么值得关注?

06:00 Lepton AI是做什么的,为什么称之为 AI cloud company?

10:02 为什么想要成立 Lepton AI?

11:50 设计针对AI的基础设施难点在哪里?跟传统云厂商和HPC的差别是什么?

19:46 为什么说现在我们不需要担心AI推理成本?未来提升的空间有多少?硬件和软件还可能有哪些突破?

25:27 开发者如何选择AI基础设施和响应的开发工具?为什么 leaderboard 是不够的?

28:49 Nvidia 会有新的挑战者吗?什么是“不可能三角”?

33:48 MLOps 是个伪命题?!AI 需要的开发工具是怎样的?

39:01 应用开发门槛越来越低,如何思考AI应用的价值?微软20年前的海报给了我们怎样的启发?

44:47 AI native 的组织是怎样的?

54:51 开源和闭源、专用和通用模型未来的关系?未来会 one model rules all 吗?

64:24 创业之后有什么感受和收获?去年年初提出的“三个基本假设”,这一年有什么变化?

67:56 未来AI应用和平台的市场格局会发生怎样的变化?

70:01 为什么说我们低估了颠覆的难度?期待5年后AI可以完成什么?

76:59 快问快答:喜欢的AI产品,推荐的书籍,解压的方式,想要问 AI 什么问题?

我们提到的内容

- DistriFusion: Distributed Parallel Inference for High-Resolution Diffusion Models, Paper, Code

- Meta research: Training ImageNet in 1 Hour

- AI inference leaderboard

- Lepton Search, Code

- Perplexity

- 推荐的书:菊与刀

参考文章

- 贾扬清的个人网站

- 贾扬清:三个基础假设

- 贾扬清:ChatGPT,和聪明地设计 Infra

- Twitter 讨论:Are LLM APIs losing money?

- Does One Large Model Rule Them All?

欢迎关注M小姐的微信公众号,了解更多中美软件、AI与创业投资的干货内容!

M小姐研习录 (ID: MissMStudy)

欢迎在评论区留下你的思考,与听友们互动。喜欢 OnBoard! 的话,也可以点击打赏,请我们喝一杯咖啡!如果你用 Apple Podcasts 收听,也请给我们一个五星好评,这对我们非常重要。

OnBoard! 终于成立听友群啦!新年新气象,加入Onboard听友群,结识到高质量的听友们,我们还会组织线下主题聚会,开放实时旁听播客录制,嘉宾互动等新的尝试。添加任意一位小助手微信,onboard666, 或者 Nine_tunes, 发送你的姓名、公司和职位,小助手会拉你进群。期待你来!

18264

18264 32

32