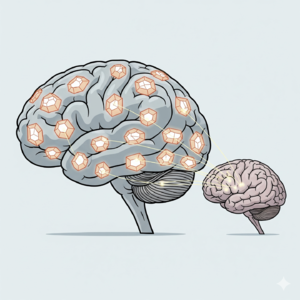

这篇论文深入探讨了大型语言模型(LLMs)的认知模式,通过网络框架将认知技能、LLM架构和数据集联系起来。文章主要研究了LLMs内部模块如何组织和协作以支持各种认知功能,例如记忆、执行功能、语言交流和社交认知。通过剪枝策略和社区检测算法,研究人员分析了技能在模型模块中的分布,发现LLMs表现出分布式而非严格局部化的学习动态,与鸟类和小型哺乳动物大脑的弱局部化架构有部分相似性。研究结果表明,虽然LLMs的模块存在与特定技能相关的社区结构,但针对性地微调这些模块并未带来显著的性能提升,这强调了LLMs中知识表示的分布式特性以及跨区域交互在模型认知能力中的重要作用。

Source: <arxiv.org>

3

3 0

0