Hello, 大家好,欢迎朋友们来到本源进化

今天我们从一个有点离谱的故事说起。

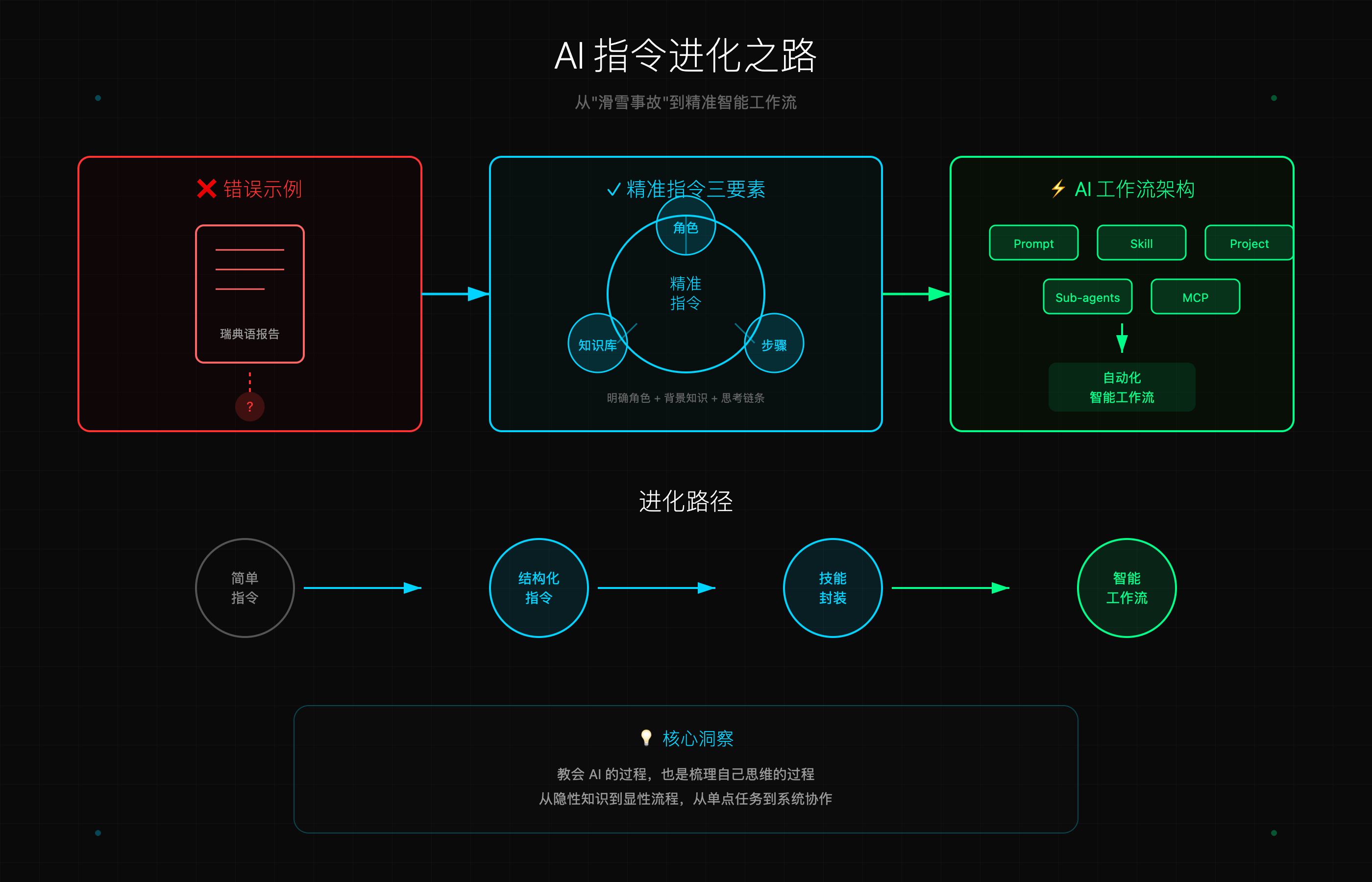

你把一份写得密密麻麻的瑞典语车祸报告,再加上一张司机随手画的、堪比抽象派的现场草图,交给一个顶尖 AI,让它判断事故责任。

结果它特别自信地回复:

“根据我的分析,这是一场滑雪事故。”

瞬间懵了——

问题真的是 AI 不够聪明吗?

还是我们一开始给它的指令和上下文就错了?

这就是今天的主题:

怎么给 AI 下“准话”,让它从爱瞎联想的助手,变成一个能理解、能执行复杂任务的靠谱伙伴。

接下来我们分两层看:

- 微观层面:一条指令,怎么从“滑雪事故”修到“精准定责”?

- 宏观层面:在此基础上,怎么搭出一整套可复用的AI 智能工作流,甚至是一个“AI 小团队”。

一、微观层面:一条好指令是怎样炼成的?

1. 场景还原:车祸理赔为什么变成了滑雪?

案例很简单:

- 一家瑞典保险公司,要处理一单车祸理赔;

- 手上只有两份材料:

一份是勾选式瑞典语车祸报告表;

一份是司机画的现场示意图(非常潦草)。

任务就一句话:

“请分析这些材料,判断哪辆车责任更大。”

第一次尝试很“直觉”:

把两张图丢给 AI,配上这句简单指令,就等结果。

最后变成了“滑雪事故”。

核心问题不在于 AI 脑子不行,而是——

在没有明确“这是车祸理赔场景”这个前提时,它会在自己的世界里“合理瞎猜”。

比如:

- 也许识别出表格里的一个地名,恰好是瑞典滑雪圣地;

- 也许把草图里的某些线条识别成了“雪道”。

对它来说,这一切是“自洽”的,但对业务来说是彻底错误。

这说明第一条铁律:

不给上下文,AI 就会用它自己的世界观给你编一个。

2. 第一步:先给 AI 一个“身份”和“工作准则”

要迭代这条指令,第一步不是写得更长,而是给它换一个“身份”。

我们在指令最前面加了一句:

“你是一名协助理赔员分析瑞典车祸报告的人工智能助手。”

这一步直接把它从“无限可能的任务空间”拉回到车祸理赔这个具体轨道。

然后再给它定工作准则:

“你的分析必须基于事实保持自信;如果信息不足,绝对不要猜测。”

结果立刻变了:

它不再提滑雪了,能识别出这是车祸场景,也能老老实实说:

“根据现有信息,我无法判断谁是过错方。”

不再乱说了,但问题是——

它太谨慎,帮不上忙。

3. 第二步:补上“专业知识库”(System Prompt)

为什么它还是下不了结论?

因为它看得懂勾选框的位置,却不知道每个勾选框什么意思。

对人类理赔员来说:

- 1 号框 = 停车;

- 12 号框 = 倒车;

- 看一眼就能在脑子里“自动翻译”。

但对 AI 来说,这些都是未知符号。

所以第二步,我们要做的就是:把“说明书”喂给它。

做法很简单:

把这张表格上所有复选框的含义,整理成一份固定的说明,作为 AI 的系统提示(System Prompt)/背景知识:

就好像先给侦探一张城市地图和一本交通规则手册,再让他去看案情。

这次再让它分析同样的两张图,它终于可以下出一个清晰结论:

“根据表格信息,B 车在倒车时,与正在停车的 A 车发生碰撞,因此 B 车在事故中负有责任。”

从“滑雪事故”到“精准定责”,靠的是:

先补身份,再补知识。

4. 第三步:告诉它“先看什么,再看什么”

很多人做到这里就停了,但真正的高手会多做一步——

把人类专家的“思考顺序”也教给 AI。

人类理赔员的习惯是:

- 先看表格这种结构化、确定性强的信息;

- 再拿这些确定的信息去解读草图这种模糊的、不确定的信息。

所以在最终版本的指令里,我们加上了清晰的步骤要求:

- “第一步:请先仔细分析表格,列出所有勾选框的内容及其含义;”

- “第二步:在完全理解表格信息的基础上,再去解读草图,并结合表格进行综合判断。”

也就是说,我们不仅告诉它知道什么(知识),还告诉它先看什么、后看什么(顺序)。

这一步,才是真正让 AI 接近“专家式推理”的关键。

小结:一条“手术刀级”指令的三要素

到这里,我们可以把**“好指令”**总结成三个要素:

- 角色设定:你是谁、在干什么场景里的专家?

- 背景知识:你手上有什么领域说明书、规则、定义?

- 思考步骤:你打算按什么顺序、用什么方式做判断?

当这三点都清楚了,一条指令才会像手术刀一样精准——

不是靠形容词堆砌,而是有结构、有边界、有方法。

二、宏观层面:从“一条 Prompt”到“一个 AI 团队”

接下来是第二个问题:

如果这是一个常年反复执行的复杂任务,难道每次都要手打一大段 prompt 吗?

显然不行。

所以我们需要从“写一条好指令”,升级到“搭一套好系统”。

你可以把一个高效的 AI 系统想象成一个由五块“能力积木”搭成的AI 团队:

- Prompt(提示词)

- Skill(技能)

- Project(项目)

- Sub-agent(子智能体)

- MCP(模型上下文协议)

1. Prompt:一次性的“工作邮件”

Prompt 就像你发给员工的一封临时工作邮件:

- 描述任务;

- 给一点上下文;

- 得到一次性结果。

它适合“临时问一句”的场景,但不适合承载整个长期流程。

2. Skill:标准作业流程(SOP)

当你发现自己总在复制粘贴同一大段复杂指令,比如那份车祸分析指令——

这就是该把它封装成 Skill(技能) 的信号。

Skill 是什么?

- 把一套成熟、专业的知识 + 流程固化下来;

- 变成一个可被 AI 随时调用的能力模块;

- 类似“公司 SOP 手册 + 自动执行”。

一旦做成 Skill,你不再需要每次都重新写那篇“小论文”。

3. Project:共享知识库与长期上下文

Project(项目)则是另一块积木。

你可以把它理解成一个项目空间 / 共享文件夹 / 知识库:

- 把市场报告、产品文档、会议纪要等都扔进来;

- 让这个项目中的所有对话,都可以共享这些背景。

一句话:

Project 管“知道什么”,让信息在任务内持续存在。

4. Sub-agents:不同分工的“AI 专家”

Sub-agents(子智能体)就是团队里的不同专家:

- 比如“市场研究员”子智能体,专门负责搜集外部数据;

- “技术分析师”子智能体,专门看代码、架构、技术路线;

- 你把不同的子任务派给不同的 agent,让他们各司其职。

这时,AI 不再是一个“什么都干一点的全能新人”,而像是:

有市场、有技术、有法务的专家小组。

5. MCP:你的“AI IT 部门”

最后是 MCP(模型上下文协议),可以简单理解为:

负责“接外部电、接外部水”的 IT 部门。

它的职责是:

- 帮 AI 打通到 Google Drive、数据库、代码库等外部系统的接口;

- 管理访问权限、工具调用;

- 让 AI 不只“在脑子里想”,还能查真正的数据、用真正的工具。

三、完整示例:搭一个“Q4 竞品分析 Robot”

我们用一个具体例子,把这五块积木串起来:

目标:搭一个“帮助你做第四季度竞品分析”的 AI Robot。

第一步:建 Project —— 先搭一个“知识场”

- 建一个项目:“Q4 竞品分析”;

- 把你已有的:

行业/竞品研究报告;

内部战略文档;

过往复盘材料;

全部上传到项目里。

这样,这个项目就有了自己的长期记忆和背景知识。

第二步:接数据源 —— 让它读到“最新现实”

通过 MCP:

- 授权它访问公司 Google 云盘、文档系统;

- 开启 Web 搜索权限,让它能看最新公开信息。

IT 部门等于帮它把“内网 + 外网”都打通了。

第三步:封装 Skill —— 把方法论变成工具

你把一套成熟的竞品分析方法论——比如:

- 如何划分赛道;

- 如何做 SWOT;

- 如何评估技术/产品/商业模式;

写成结构化流程,封装成一个叫:

Competitive Analysis 的 Skill之后,只要调用这个 Skill,它就会按这套流程稳定产出分析,而不是临场发挥。

第四步:配置 Sub-agents —— 市场 + 技术配合

设定两个子智能体:

- 市场研究员 Agent:擅长使用搜索工具、阅读报告,汇总外部情报;

- 技术分析师 Agent:擅长看 GitHub、技术文档、API 说明,判断技术路线与壁垒。

他们都可以访问 Project 的知识库,也都可以调用 Competitive Analysis Skill。

第五步:一句话下任务,后台自动跑流程

此时,作为负责人,你只需要给出一个非常简短的高层指令:

“请分析我们主要竞争对手最近上线的新功能,并找出我们的机会点。”

接下来,AI 团队会在“后台”自动运转:

- Project 提供背景;

- MCP 拉最新数据;

- 市场 Agent 抓外部信息;

- 技术 Agent 看代码与技术实现;

- 所有人都按

Competitive Analysis这套 Skill 的流程工作; - 最后把结论汇总成一份清晰报告给你。

你看到的是一份结果,背后则是一整套结构化的 AI 协作流程。

四、关键区分:Project vs Skill,本质差别只有一句话

很多人会把 Project 和 Skill 混在一起,这里用一句话帮你记住:

- Project(项目):

“这是你需要知道的背景知识。”

它是静态的共享知识库,像图书馆、文件夹、知识空间。 - Skill(技能):

“这是你该怎么做这件事的方法。”

它是动态的可执行流程,像 SOP + 工具箱。

一个管 “What(知道什么)”,一个管 “How(怎么做)”。

理解了这一点,你就真正从“写好 prompt 的工匠”,升级成了“设计 AI 团队结构的架构师”。

结尾思考:教会 AI 的同时,也在重构自己

我们最后回顾一下:

- 从一个把车祸分析成滑雪事故的错误开始,我们看到:

没有角色、没有上下文,AI 就会在自己的世界里“合理瞎编”。 - 通过角色设定 + 背景知识 + 思考步骤,我们学会了如何让一条指令像“手术刀”一样精准;

- 然后又通过 Prompt / Skill / Project / Sub-agent / MCP 五块积木,搭出了一个可以长期运转的AI 团队模型。

最后留给你一个小问题:

当你把自己的一项重复工作“技能化”,

或者把一项复杂任务“项目化”的时候,

你是不是也在被迫把脑子里那些模糊的、凭经验在跑的习惯和判断,

第一次摊开、说清楚、结构化?

也许,学会和 AI 高效合作的过程,本身就是一次

“把自己变得更清晰、更可复用”的过程。

4

4 0

0