第9课视频的主要内容: 聚焦多分类任务与损失函数的底层原理。重点介绍了如何利用 Softmax 函数将网络输出转化为分类分布参数。通过引入 KL 散度衡量分布间的不相似度,本课严谨地证明了最小化交叉熵损失与最大似然准则下的负对数似然在数学上是完全等价的。这为深度学习模型训练提供了坚实的概率论解释。

第9课完整讲义:zhuanlan.zhihu.com

00:00 开篇语

00:41 多分类任务

02:09 softmax函数将网络输出转化乘概率分布

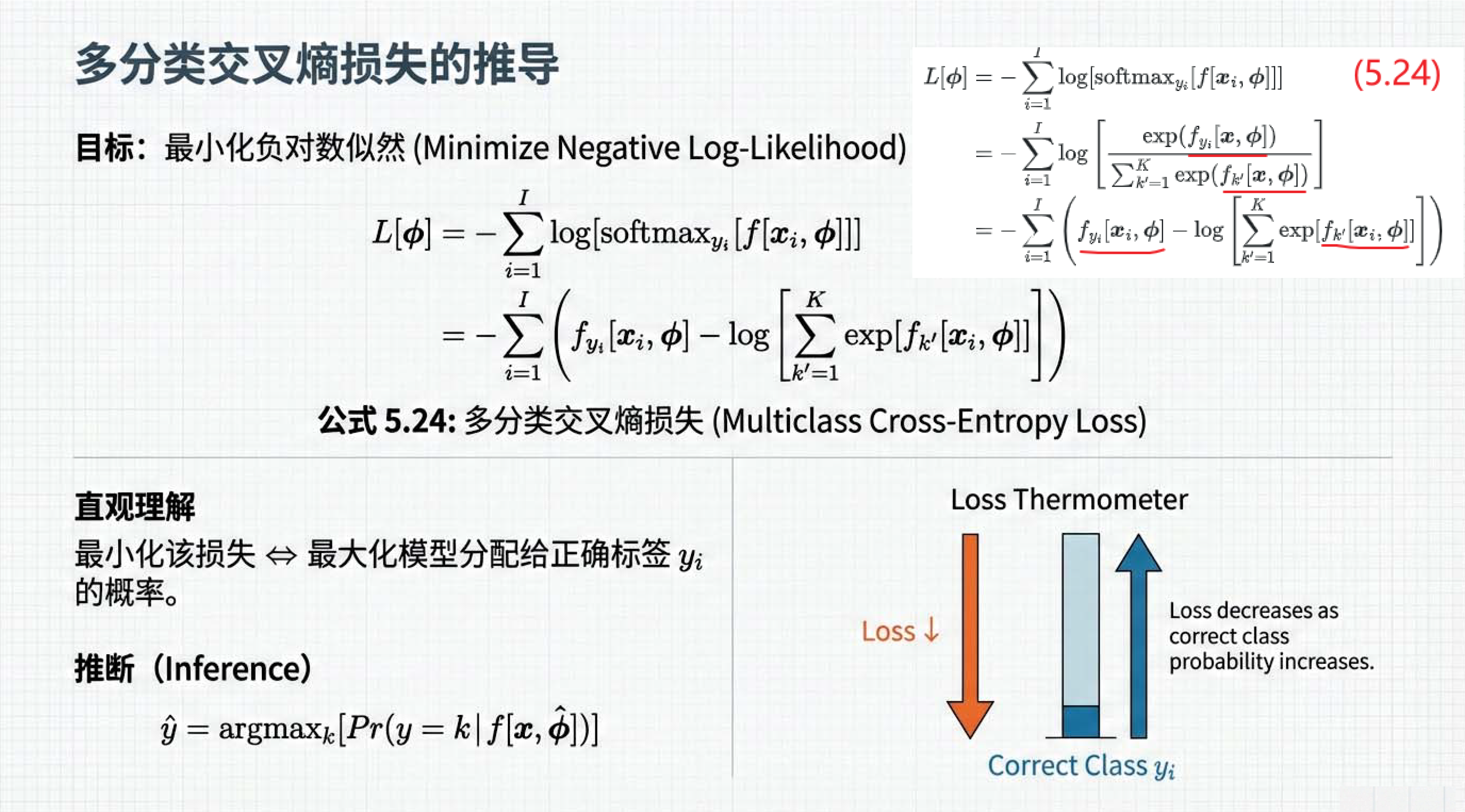

04:12 多分类交叉熵损失的推导

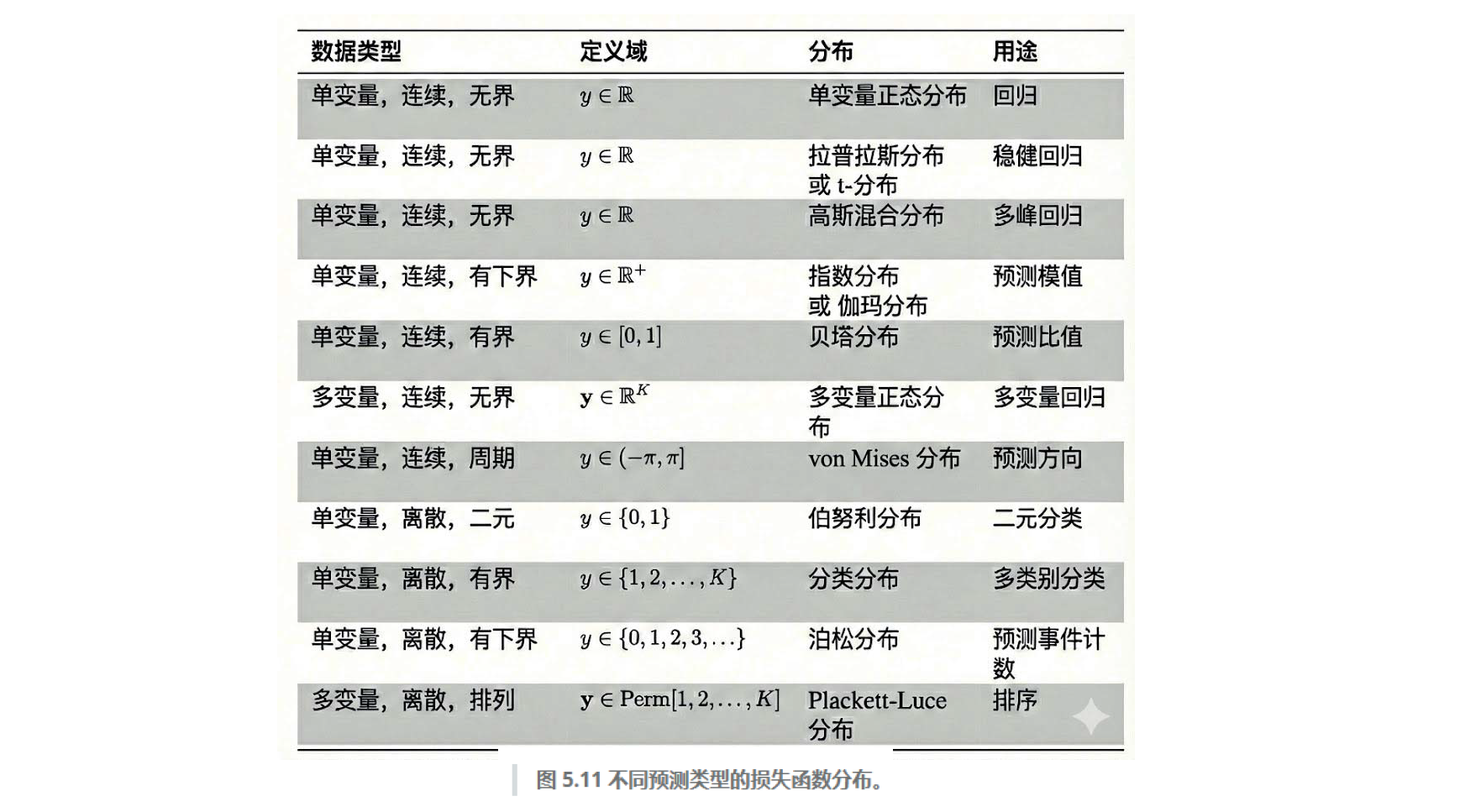

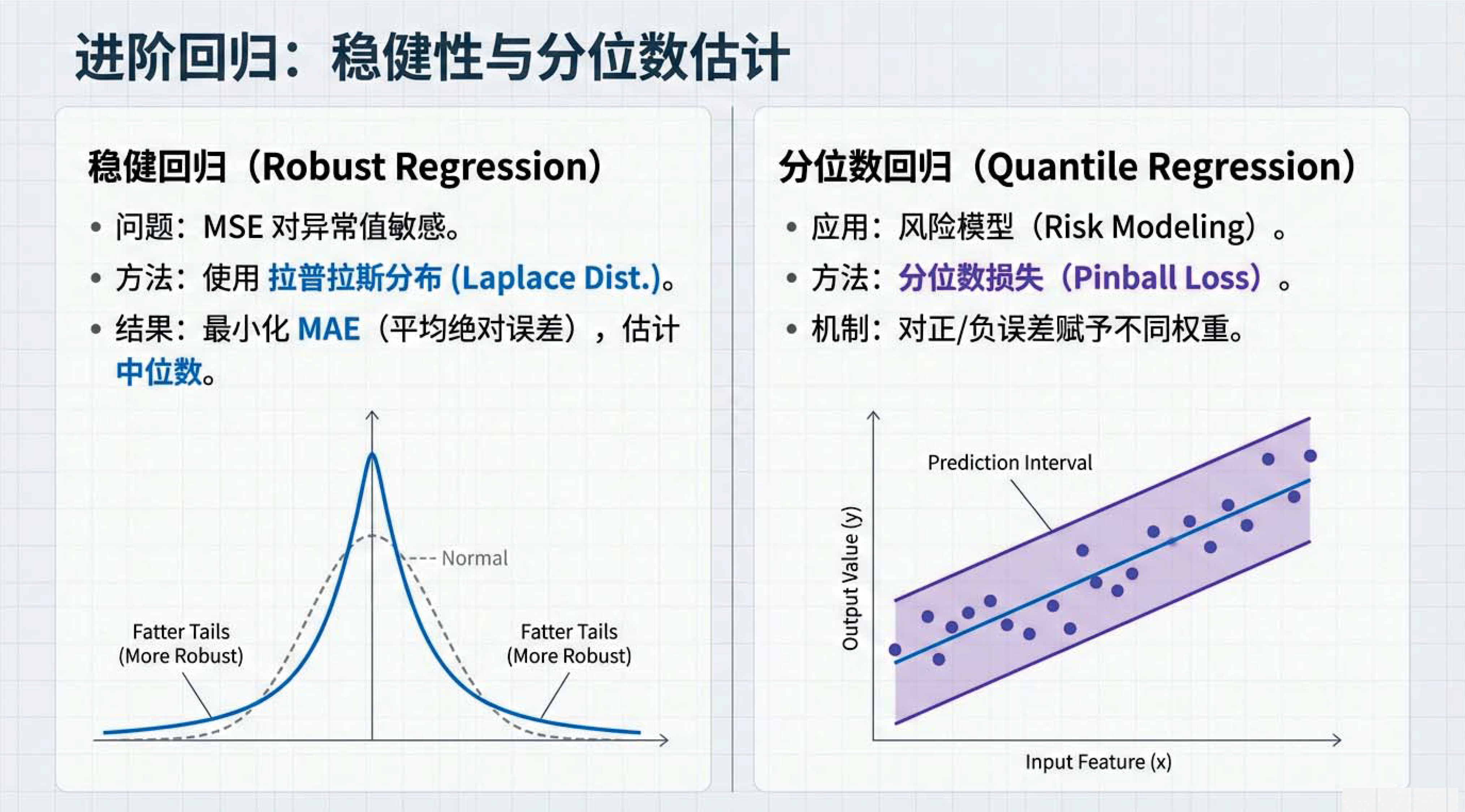

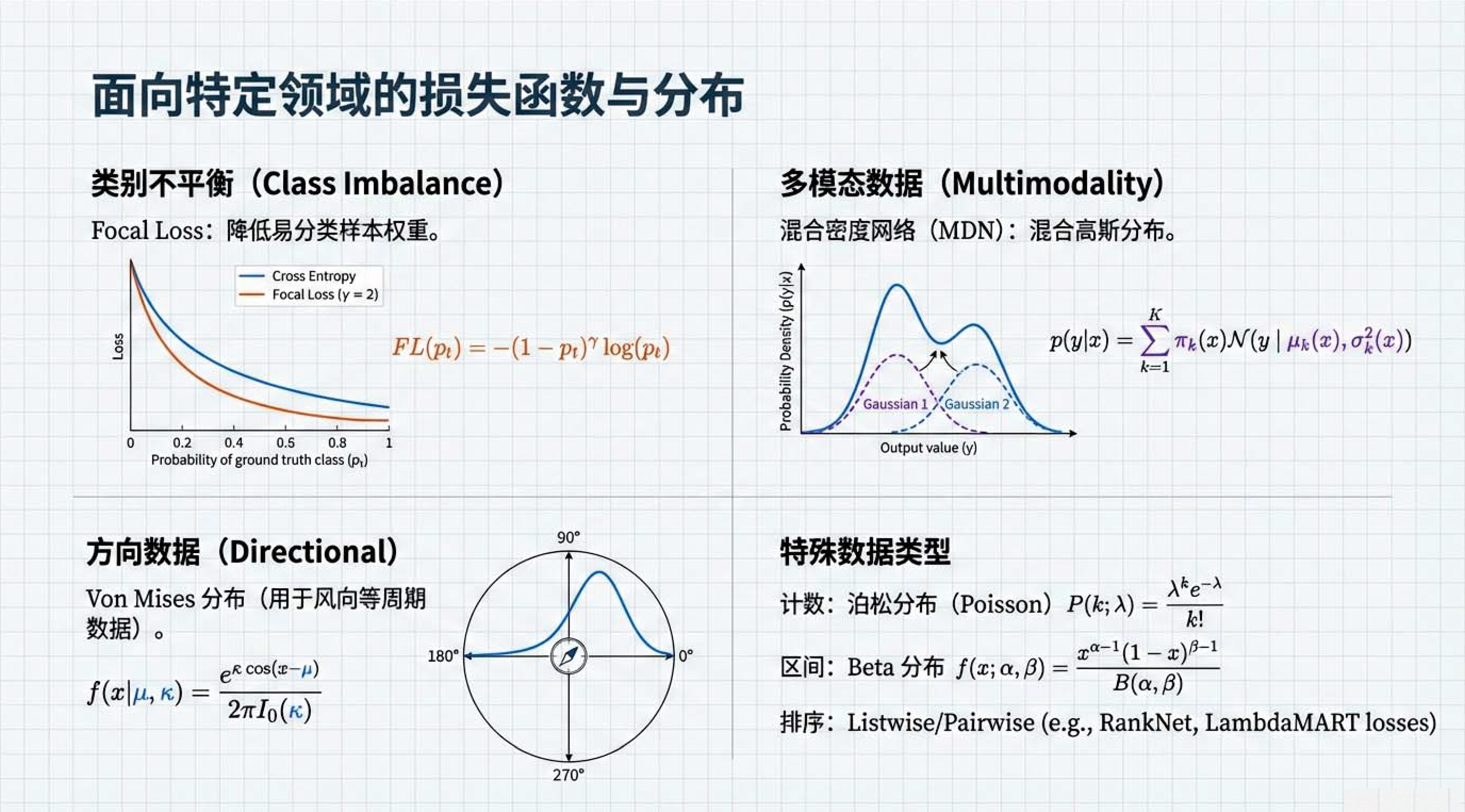

06:28 不同预测类型的损失函数分布

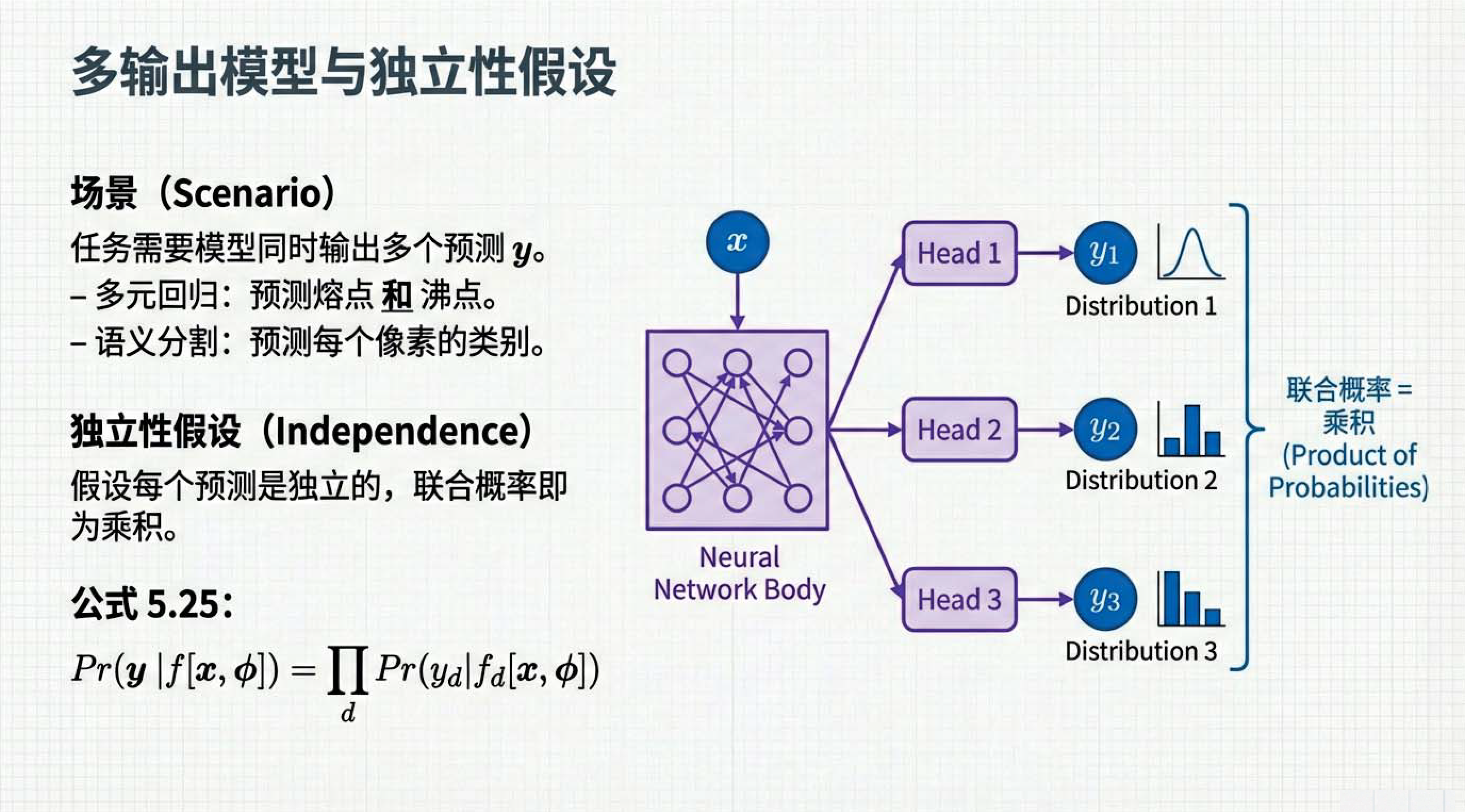

07:08 多输出模型与独立性假设

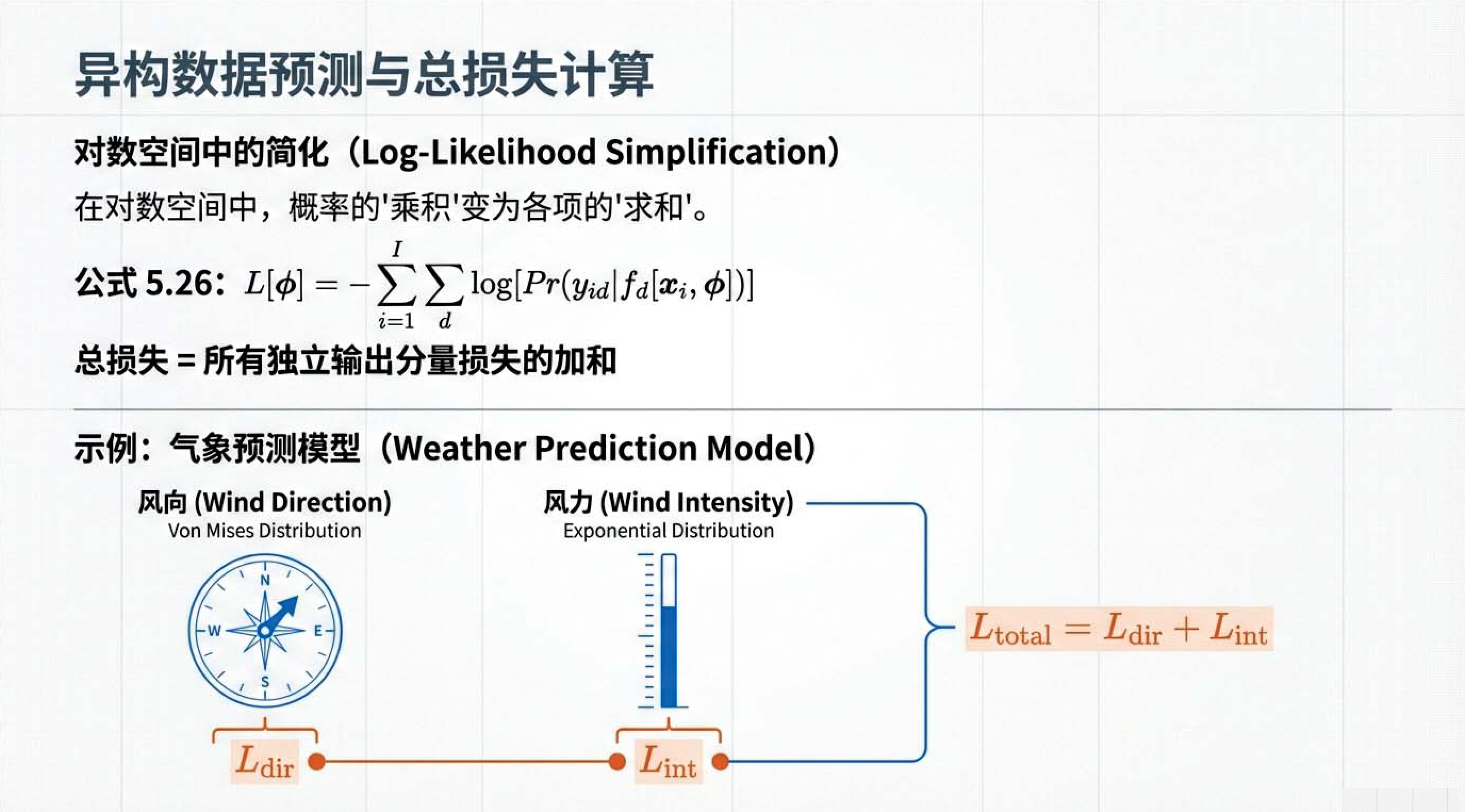

08:31 异构数据预测与总损失计算

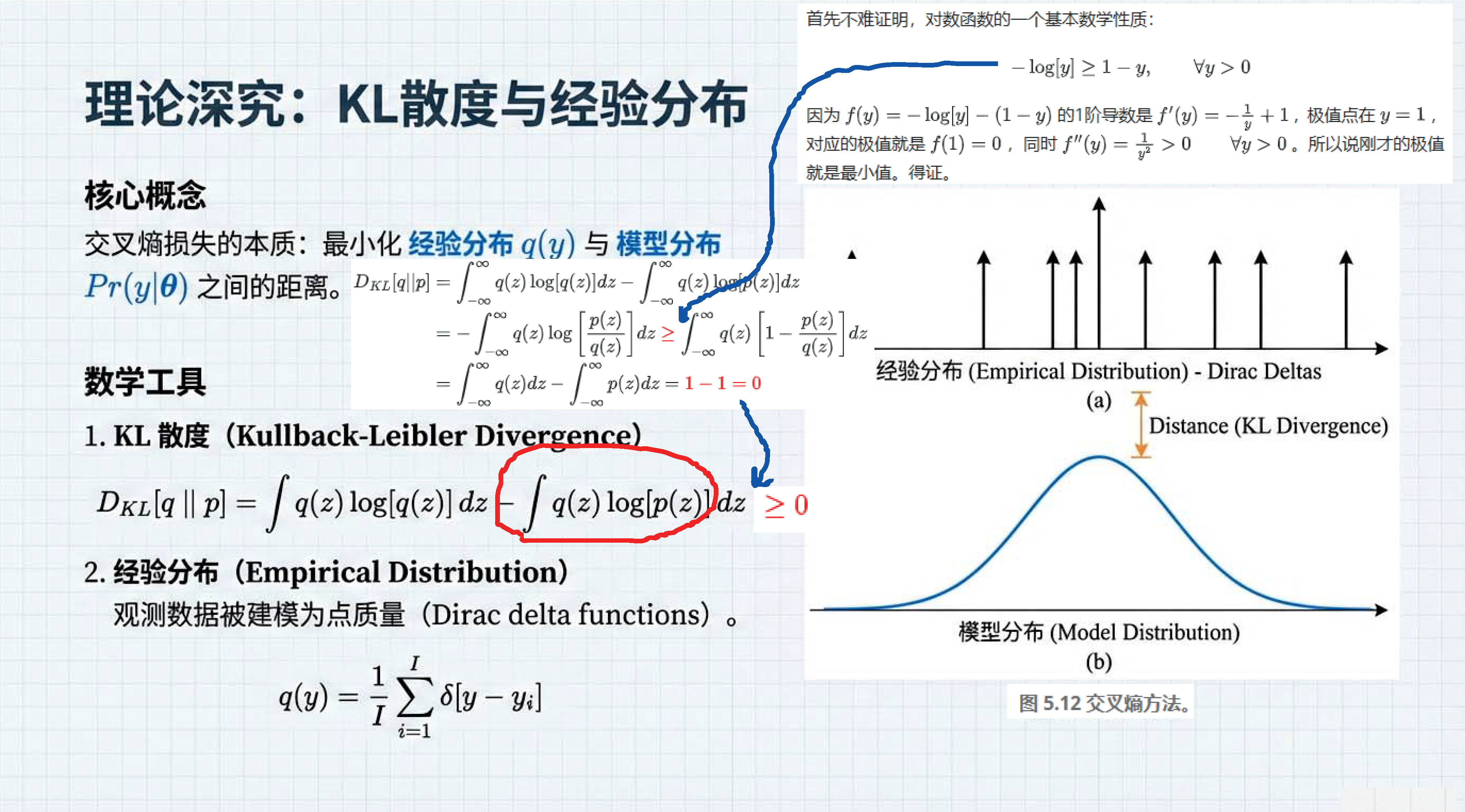

09:56 KL散度与经验分布

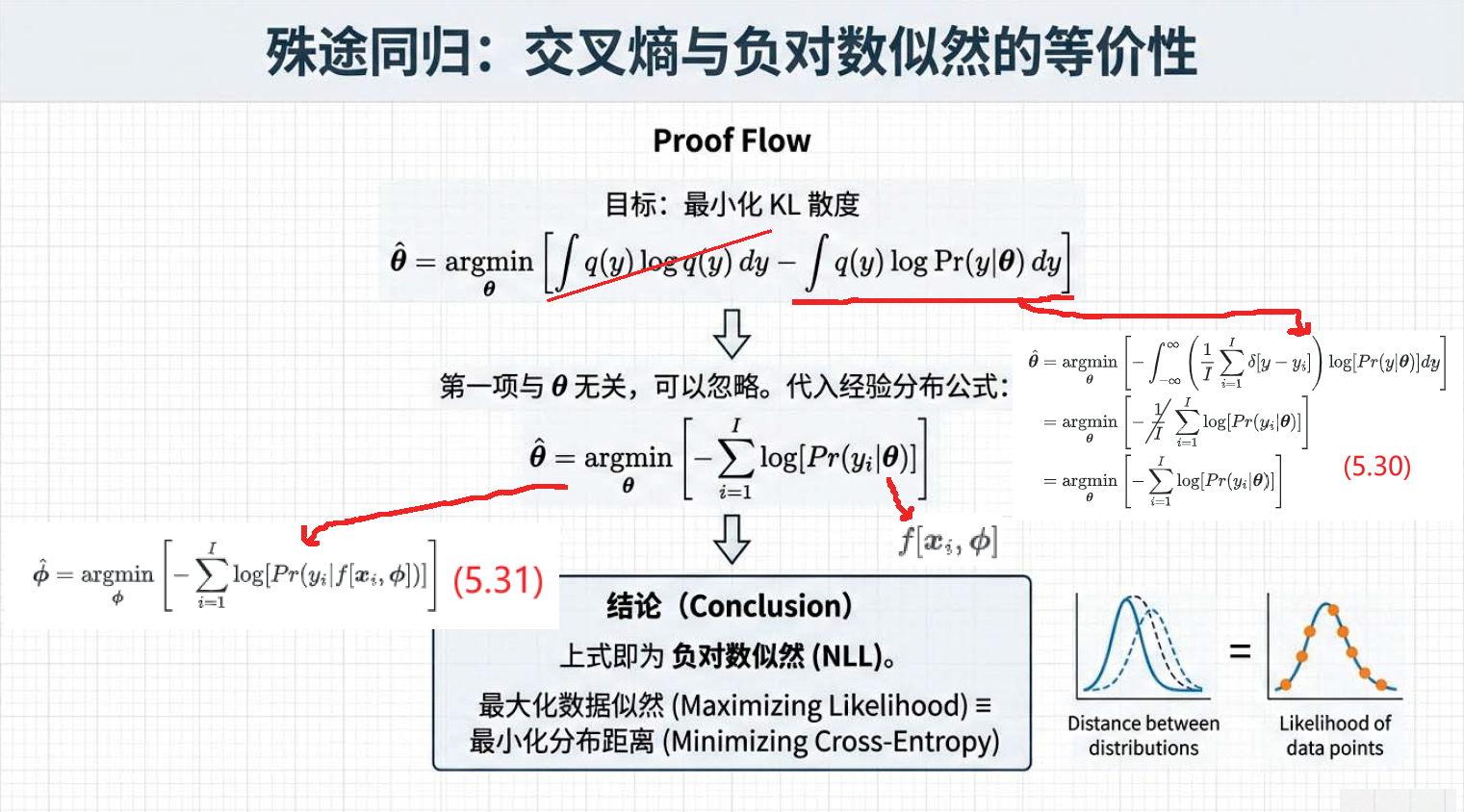

13:15 交叉熵与负对数似然的等价性

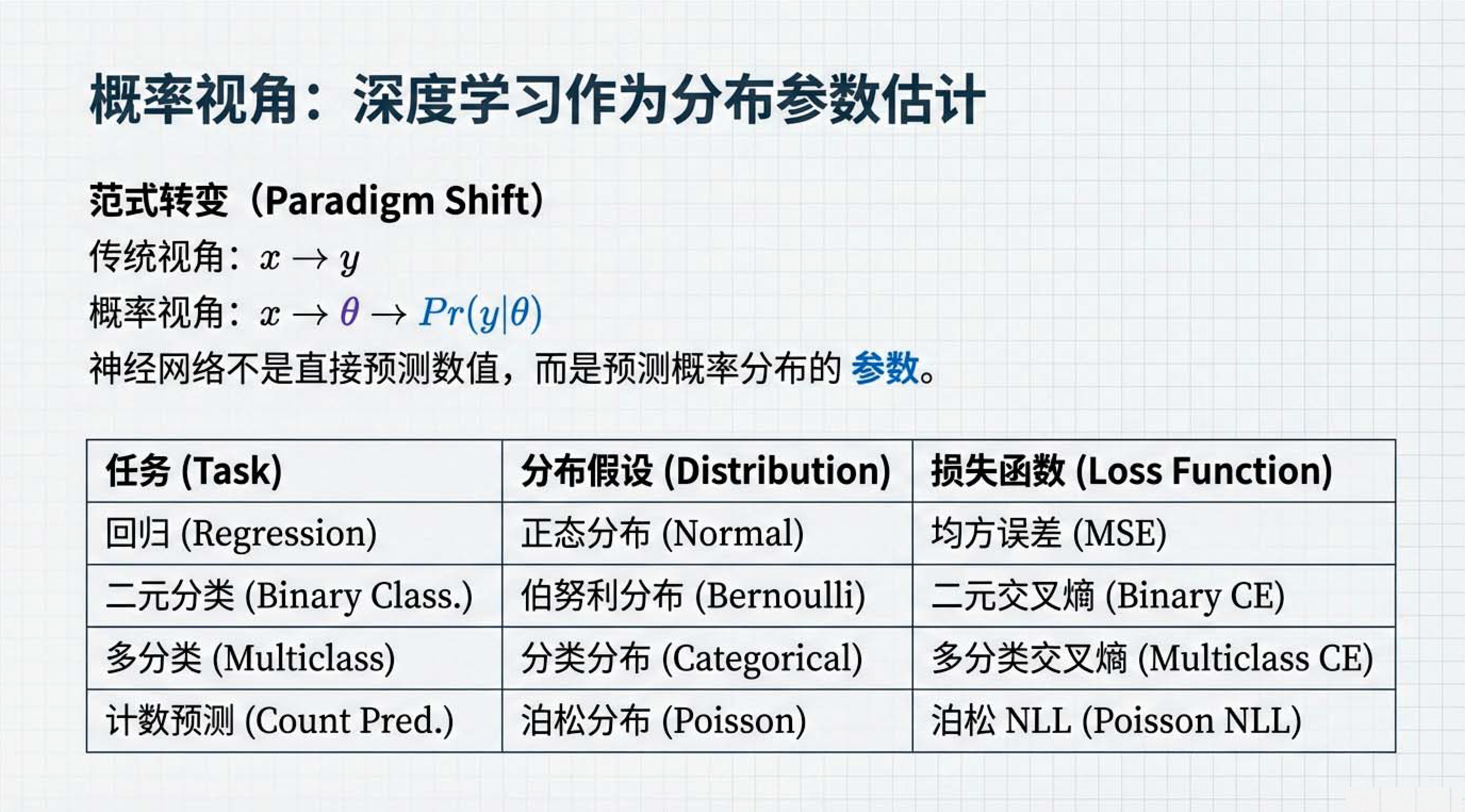

16:19 深度学作为分布参数估计

18:09 深度学作为分布参数估计

19:01 习题

19:35 结束语

9

9 0

0