Beta.FM | No.02 人工智能的逆袭:“神经网络”的尝试与进化

🎙️ 本期简介

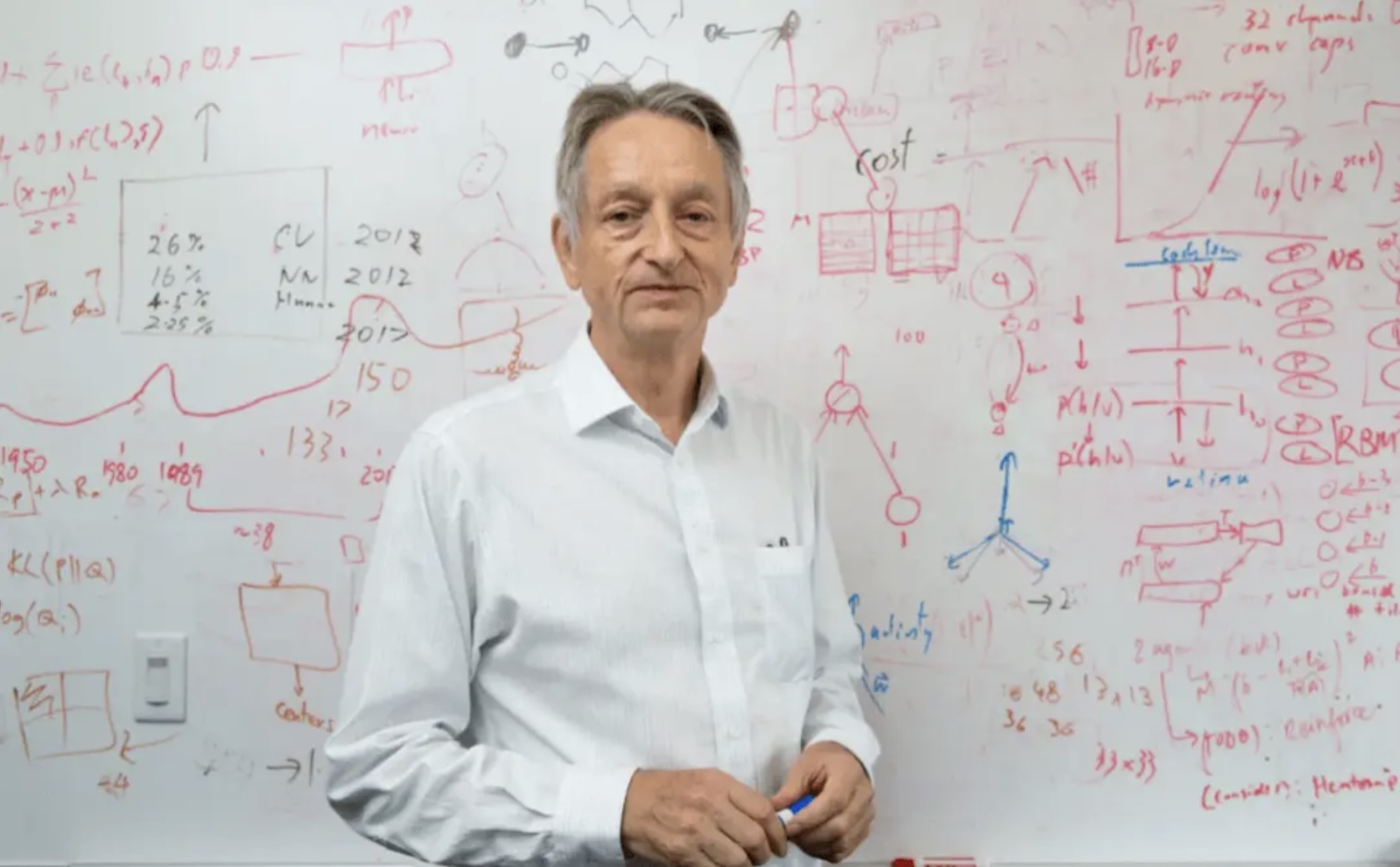

如果说 AI 的发展史是一座博物馆,那“神经网络”曾经是被扔在角落里吃灰的那个展品。长达三十年,它被主流科学界视为“疯子的呓语”。但有一个人——杰弗里·辛顿(Geoffrey Hinton),在没有光的冷板凳上独自守望,坚信模仿人脑是唯一的出路。本期 Beta.FM,我们不仅要聊这段充满偏见与孤独的历史,还要带你拆解那个改变世界的算法:反向传播。

⏳ 时间轴与内容大纲

* 00:01 欢迎回到 Beta.FM:今天我们要聊 AI 的“灵魂”——神经网络。

* 00:31 孤独的先知:杰弗里·辛顿(Geoffrey Hinton)和他的三十年冷板凳。

* 01:44 神经网络的本质:它不是焊接电线,而是成千上万个微小的“投票站”。

* 02:53 反向传播(Backpropagation):1986 年诞生的“后悔药”,让 AI 学会了复盘和纠错。

* 03:25 第一次寒冬:当理论太过超前,算力和数据成了它的阿喀琉斯之踵。

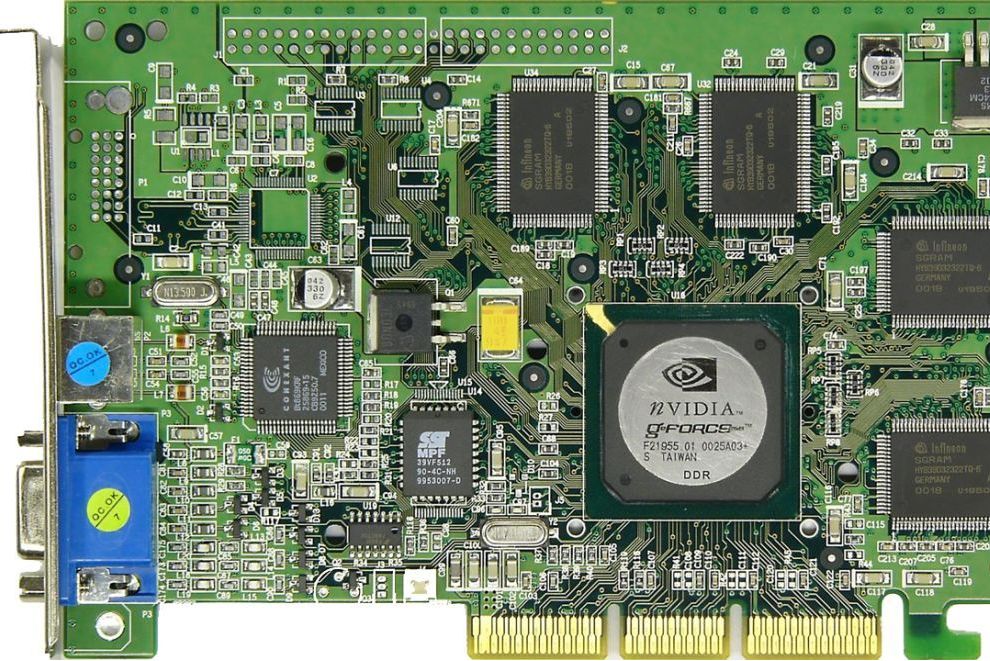

* 03:53 救星登场:没想到拯救 AI 的,竟然是打《魔兽世界》的游戏玩家和显卡(GPU)。

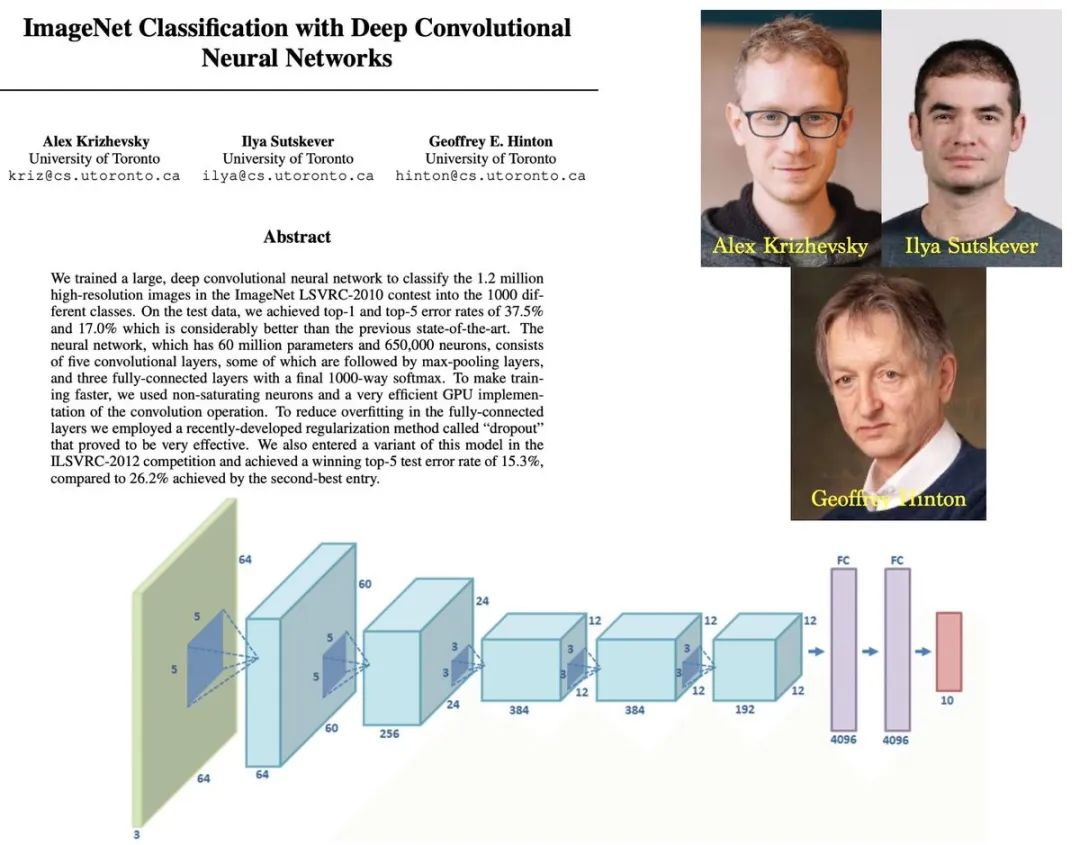

* 04:32 2012 ImageNet 奇迹:错误率从 25% 降到 15%,神经网络那一夜“封神”。

* 05:15 AI 的“顿悟”:没人教它什么是鼻子,它自己在深层网络里“看”到了。

* 06:25 尾声:如果大脑只是数学,那人与机器的界限究竟在哪里?

杰弗里·辛顿(Geoffrey Hinton)| 获得图灵奖、诺贝尔奖的“AI教父

神经网络示意图(Perceptron vs Deep Net)| 一张简单的手绘风格图,展示输入层、隐藏层和输出层的连接

*1986 年《自然》杂志封面或论文页 | 辛顿发表反向传播算法的里程碑论文

早期 NVIDIA 显卡 GeForce 256 | 正是它们意外点燃了 AI 的火种

2012 ImageNet 竞赛 | AlexNet 以15.3%的错误率夺冠

💡 核心金句 (Highlights)

> “神经网络就像一个在黑夜里修路的人,坚信只要数学方法对,这些冷冰冰的数字节点就能产生类似人类的‘直觉’。”

> “AI 不是被教会的,是它在无数次的失败和纠错中,自己‘进化’出了对世界的理解。”

> “深蓝是靠人类教的逻辑,而神经网络表现出的,是一种人类从未见过的、自发形成的‘理解力’。”

>

📚 延伸阅读

* Geoffrey Hinton 的访谈:关于深度学习革命的回忆录。

* AlexNet 论文:《ImageNet Classification with Deep Convolutional Neural Networks》(2012)。

* 科普推荐:3Blue1Brown 的神经网络数学原理解析视频。

🎵 本期节目 BGM

* 开场曲:[Set You Free - Isak Danielson]

* 结尾曲:[Fallen Star - Elaine Kim]

25

25 0

0