Beta.FM | No.03 当AI开始理解我们:“自注意力”机制与“大语言模型”

🎙️ 本期简介

在《圣经》故事中,上帝变乱了人类的口音,以此阻止巴别塔的落成。几千年来,语言一直是机器无法逾越的高墙——直到 2017 年,谷歌的几位研究员发表了一篇足以载入史册的论文:《Attention Is All You Need》。

为什么以前的 AI 总是“读了后面忘前面”?为什么 ChatGPT 突然间能像诗人一样写作?本期 Beta.FM,我们聊聊那个重塑了 AI 灵魂的架构——Transformer,以及智能是如何在海量数据的压缩中,像水蒸气一样“涌现”出来的。

⏳ 时间轴与内容大纲

00:23 欢迎来到 Beta.FM:语言是人类最后的堡垒。

01:49 AI 的健忘症—长距离依赖:早期的 RNN 就像记忆只有七秒的金鱼。

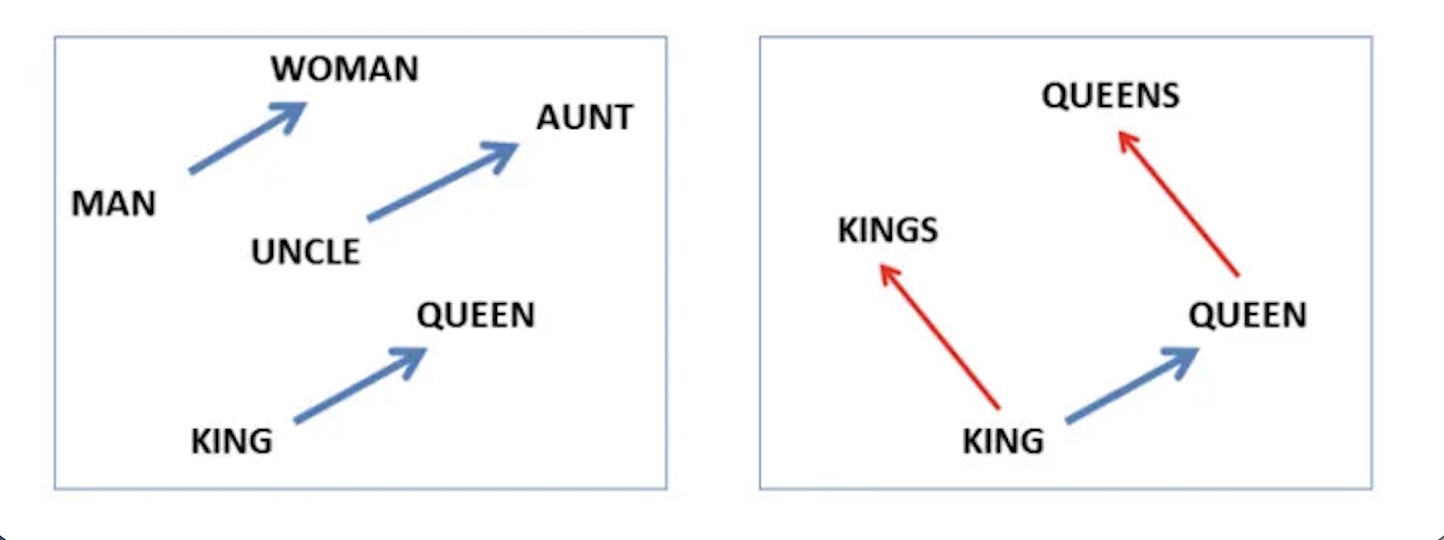

03:02 单词的地图:国王 - 男人 + 女人 = 女王?词嵌入(Word Embedding)的神奇坐标。

04:30 自注意力机制(Self-Attention):不再逐字阅读,而是开启“上帝视角”扫视全场。

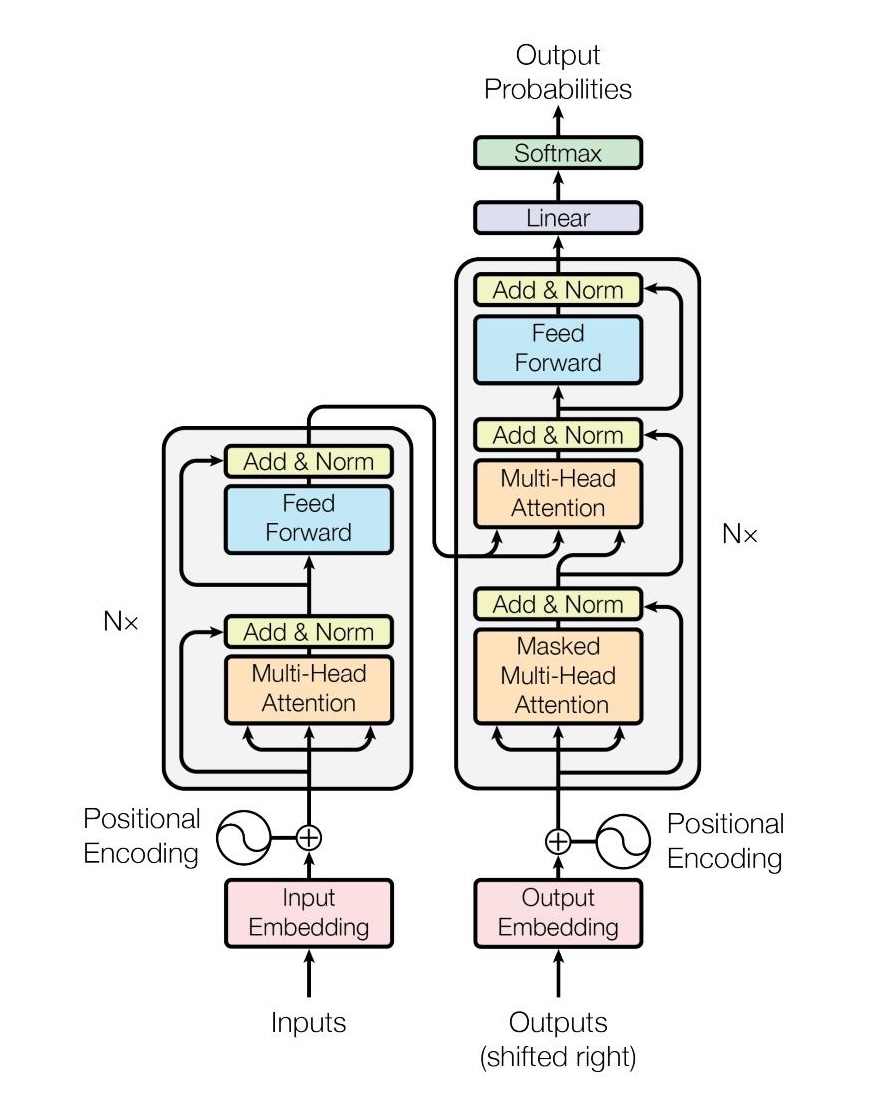

06:37 Transformer 诞生:那篇标题“极其嚣张”的论文如何改变了世界。

07:09 猜字谜的奇迹:GPT 并没有在学习知识,它只是在疯狂地猜“下一个字”。

07:45 涌现(Emergence)时刻:当数据足够多,智能就像水蒸气一样蒸腾而出。

09:28 尾声:我们造出了自己也无法完全解释的“黑盒子”。

《巴别塔》名画(老彼得·勃鲁盖尔)| 象征人类语言破碎的起点

Transformer 架构图 | 出自 2017 年论文原文,充满工业美学的方块连接图

向量空间示意图:展示“King”与“Queen”的数学逻辑

大规模服务器阵列 | 训练时消耗的巨大算力,是智能的物理根基

💡 核心金句 (Highlights)

“语言不是数学,语言里全是‘坑’。”

“智能,本质上就是对海量数据的极致压缩。当它玩通了‘猜字游戏’,智能就涌现了。”

“现在的 AI 不再是鹦鹉学舌,它是在无数次复盘中,内化了人类文明的逻辑。”

📚 延伸阅读

论文原文:Attention Is All You Need (Google Brain, 2017)

神话背景:圣经《创世记》第11章关于巴别塔的记载

技术科普:Jay Alammar 的博文 The Illustrated Transformer

🎵 本期 BGM

开场曲:[Set You Free - Isak Danielson]

结尾曲:[Fallen Star - Elaine Kim]

8

8 0

0