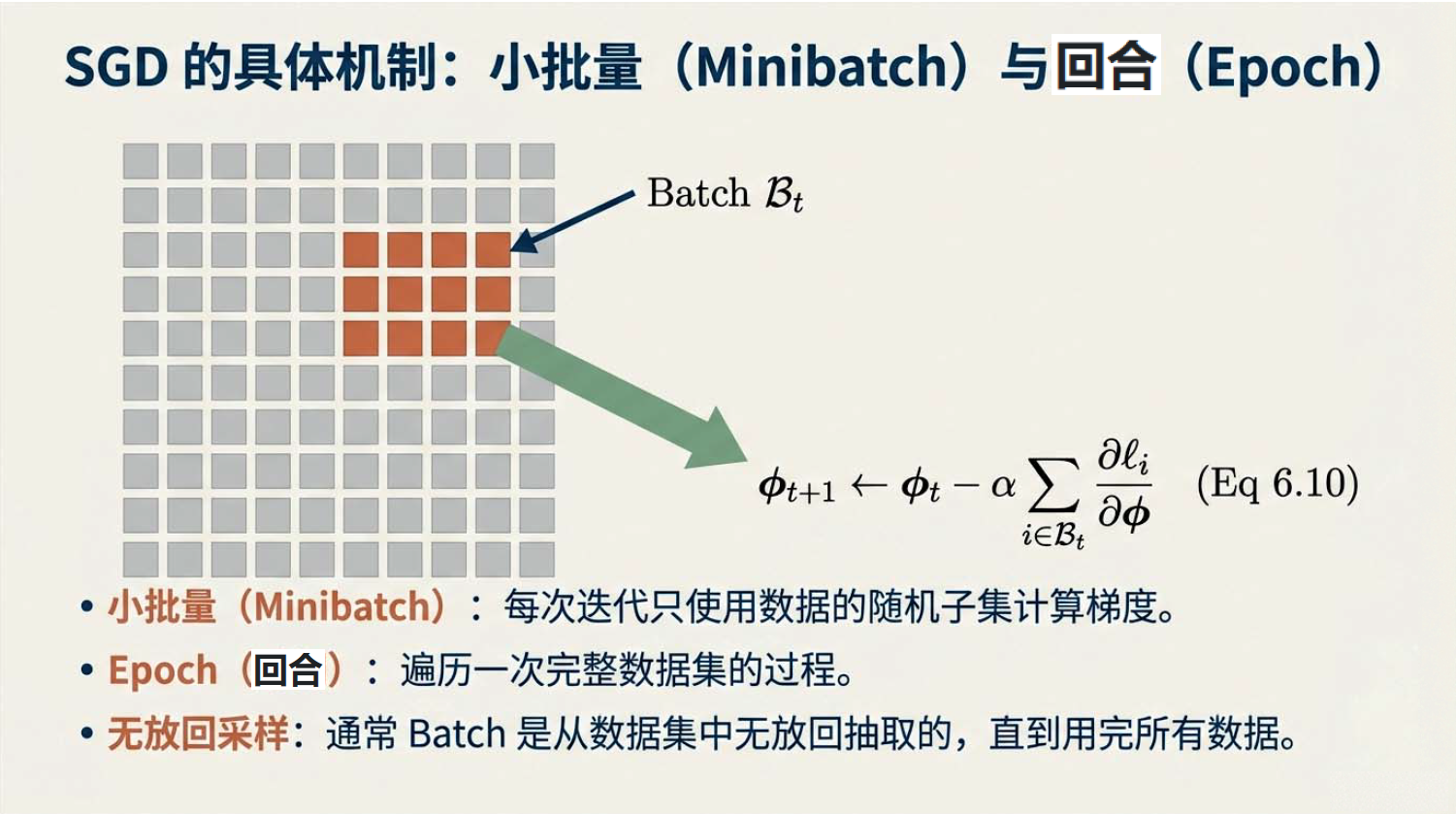

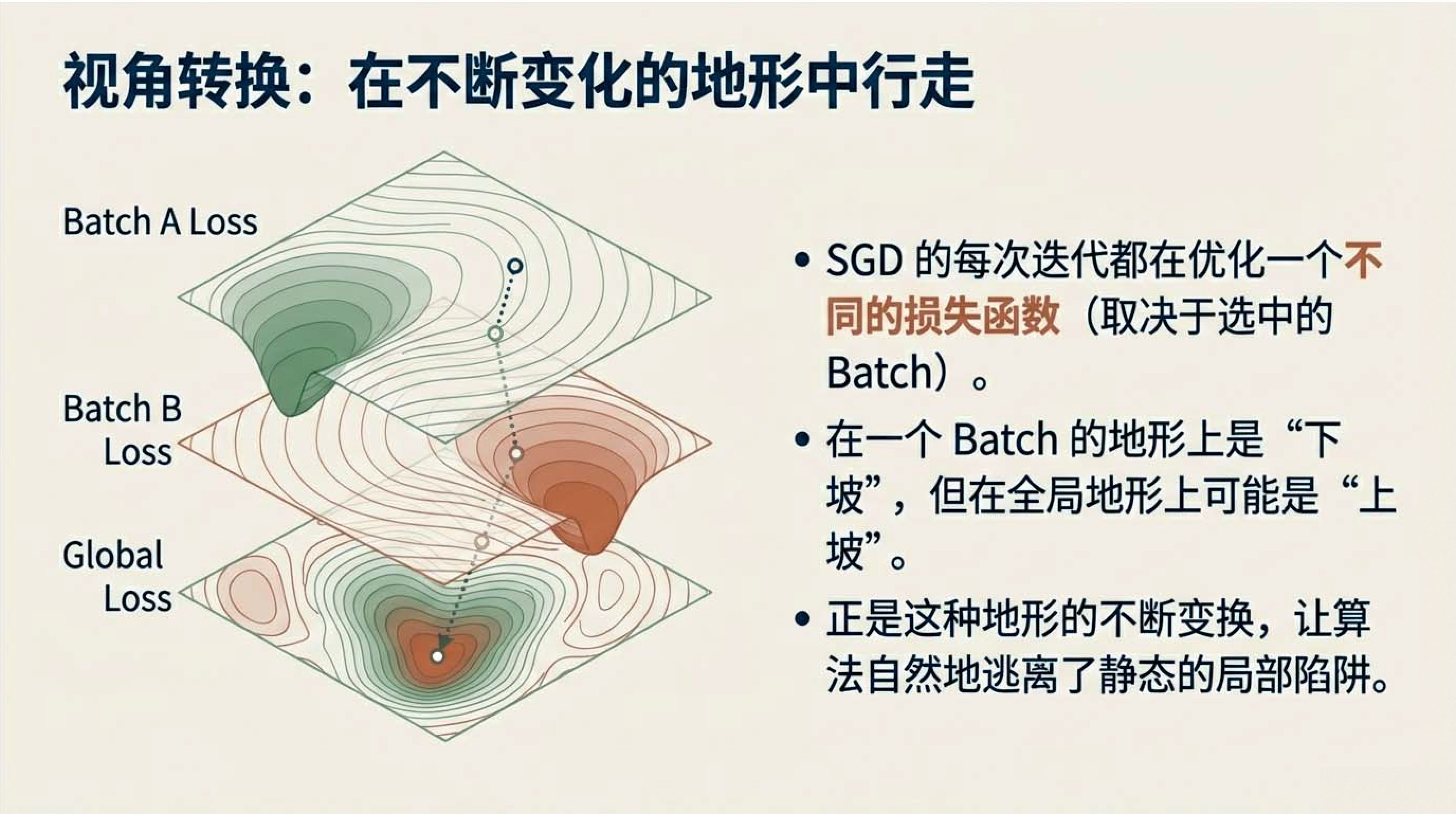

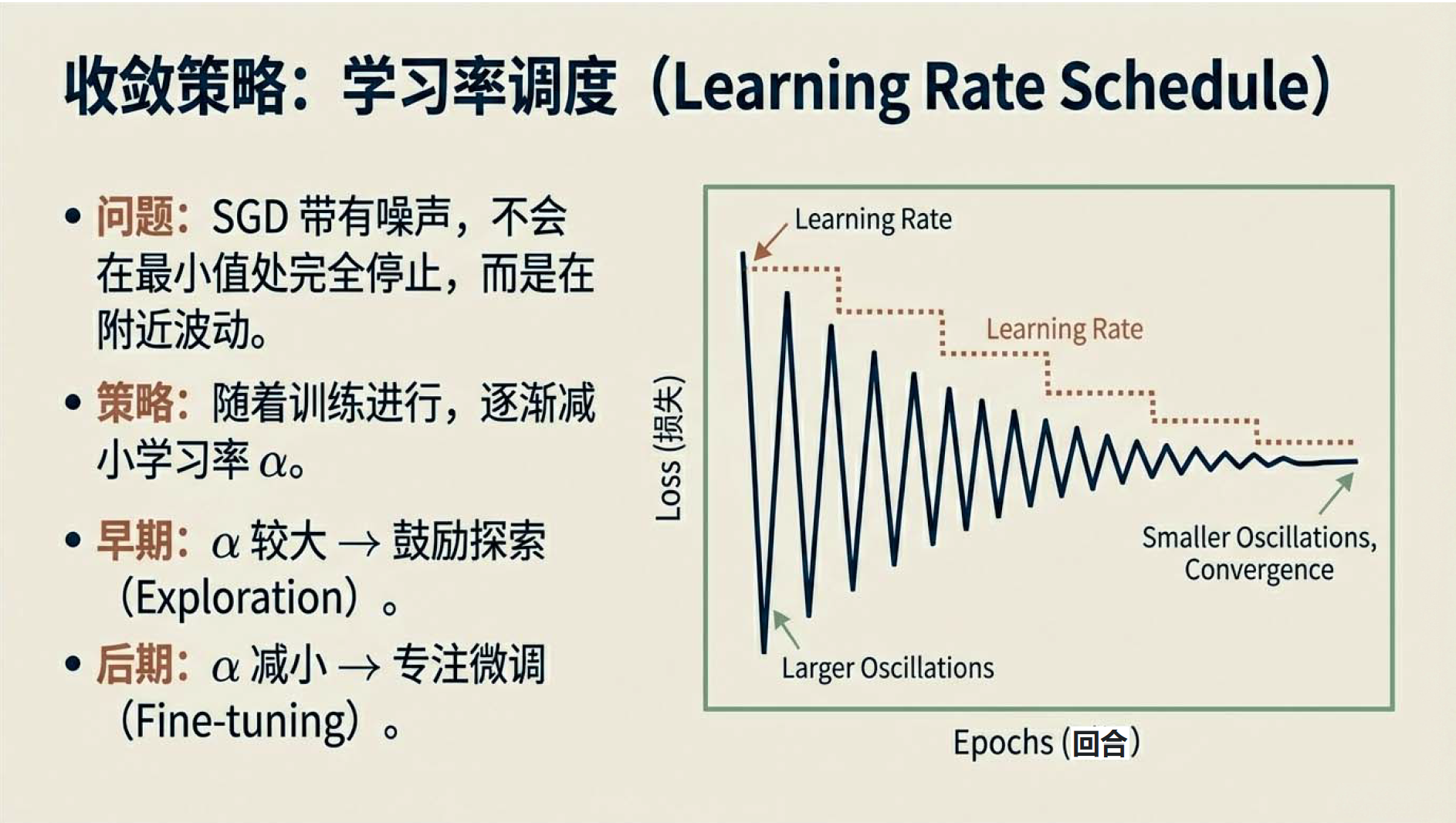

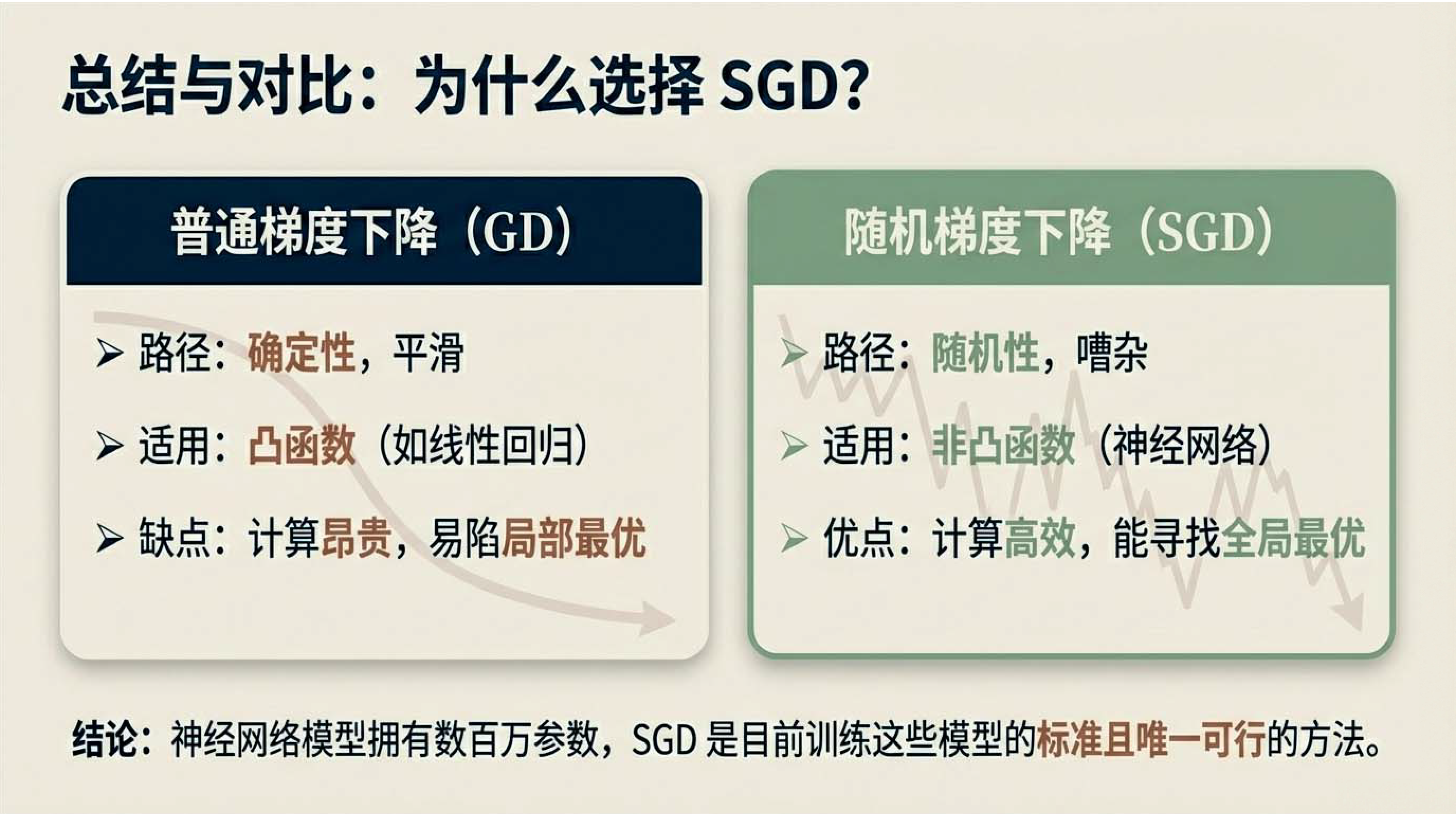

本课讲解模型拟合,即通过迭代优化寻找使损失函数最小化的参数。核心算法是梯度下降:通过计算损失关于参数的梯度,并沿“下坡”方向迭代更新。针对非凸损失函数中的局部最小值和鞍点,引入随机梯度下降(SGD),利用小批量数据的随机性提升搜索能力。

第10课完整讲义:zhuanlan.zhihu.com

00:00 开篇语

01:01 拟合 或训练的核心目标

02:42 梯度下降法

06:27 梯度下降法

07:50 梯度下降法

08:17 陷阱:局部最小值和鞍点

10:07 引入噪音的随机梯度下降

10:35 batch 和 epoch

12:46 在不断变化的损失函数

13:31 随机梯度下降的核心特性

15:04 学习率调度

15:45 结束语

5

5 0

0