本期内容基于姚顺雨在腾讯的第一篇论文:CL-bench: A Benchmark for Context Learning (3 Feb 2026) 的解读分享。

入职腾讯,姚顺雨主要参与推动 AI 基础设施等组织调整。姚顺雨在一场内部会上发言,希望团队以后不要打榜,也不要盯着榜单做事。这和他过去的认知完全一致:真正决定模型能否走出 demo 的,不是再刷几个榜,而是你到底有没有把系统放进真实世界的约束里,并用真实世界的方式去评估它。

在2025年末,斯坦福的团队曾发现「上下文税 (The Context Tax)」的问题。当模型在使用工具、执行推理时,Token 的消耗如同流水,上下文窗口还未填满时,模型就开始遗忘重要信息,要么干脆做不下去。因此 Agent 系统必须要拆到最细,走严格的 SOP 才走的通。这说明,其实模型在长上下文的处理方面,并不如现有 Benchmark 所显示的那么优异。在长上下文中,它会混乱、遗忘、难以遵守规则。而这是一个被所有人忽视的、制约 AI 真正走向实用的最大卡点。CL-BENCH 正是去测试到底这个卡点有多大的一个新的评估标准。

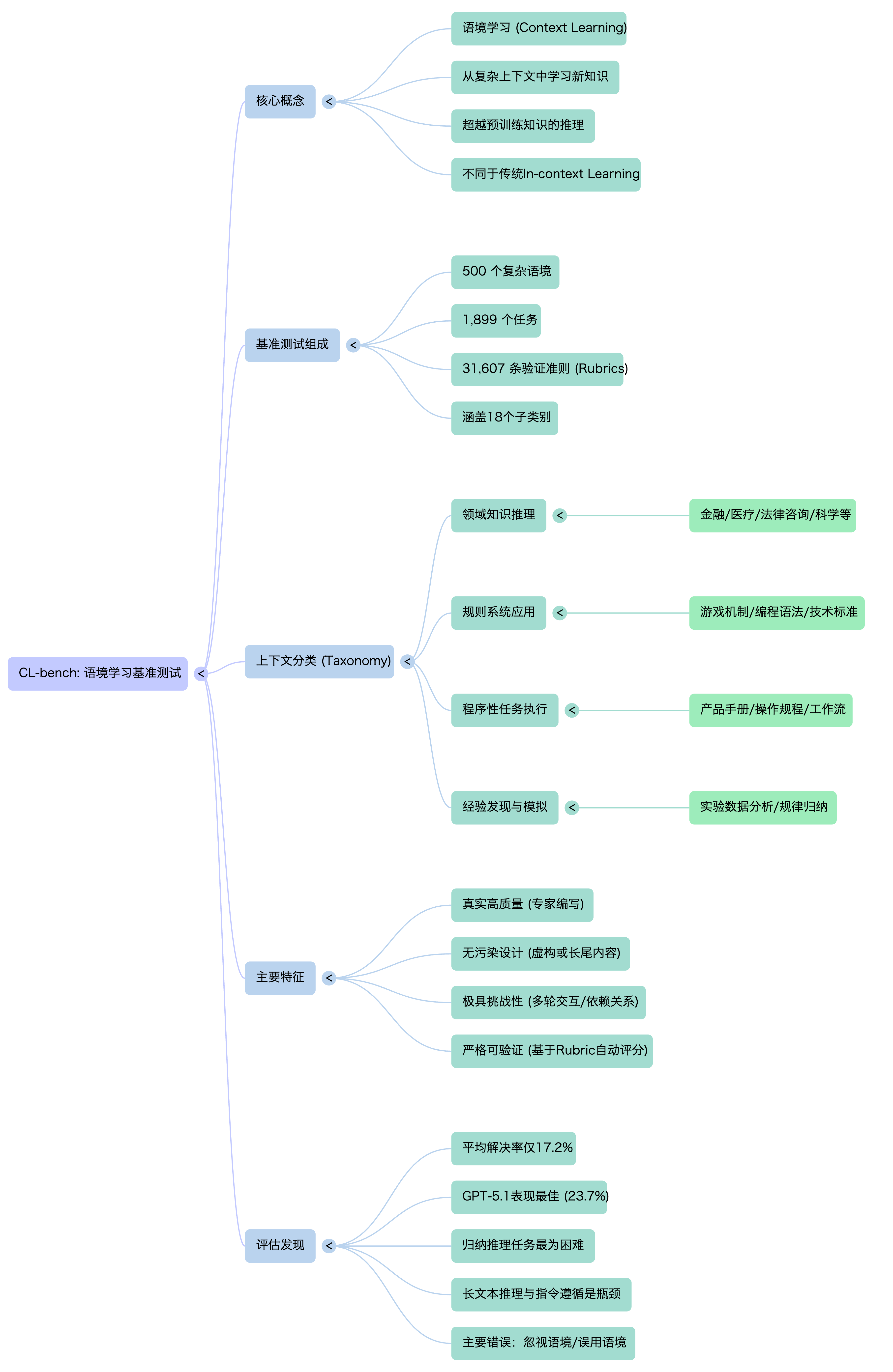

当大语言模型能够流畅地谈论已知的一切,我们是否误判了它们的真实智能?CL-bench 的最新研究揭示了 AI 一个关键但被忽视的短板:Context Learning——即从一份全新的、复杂的任务说明中(如一本从未见过的产品手册或一套虚构的法律),自主学习并应用其中完全陌生的知识来解决问题。

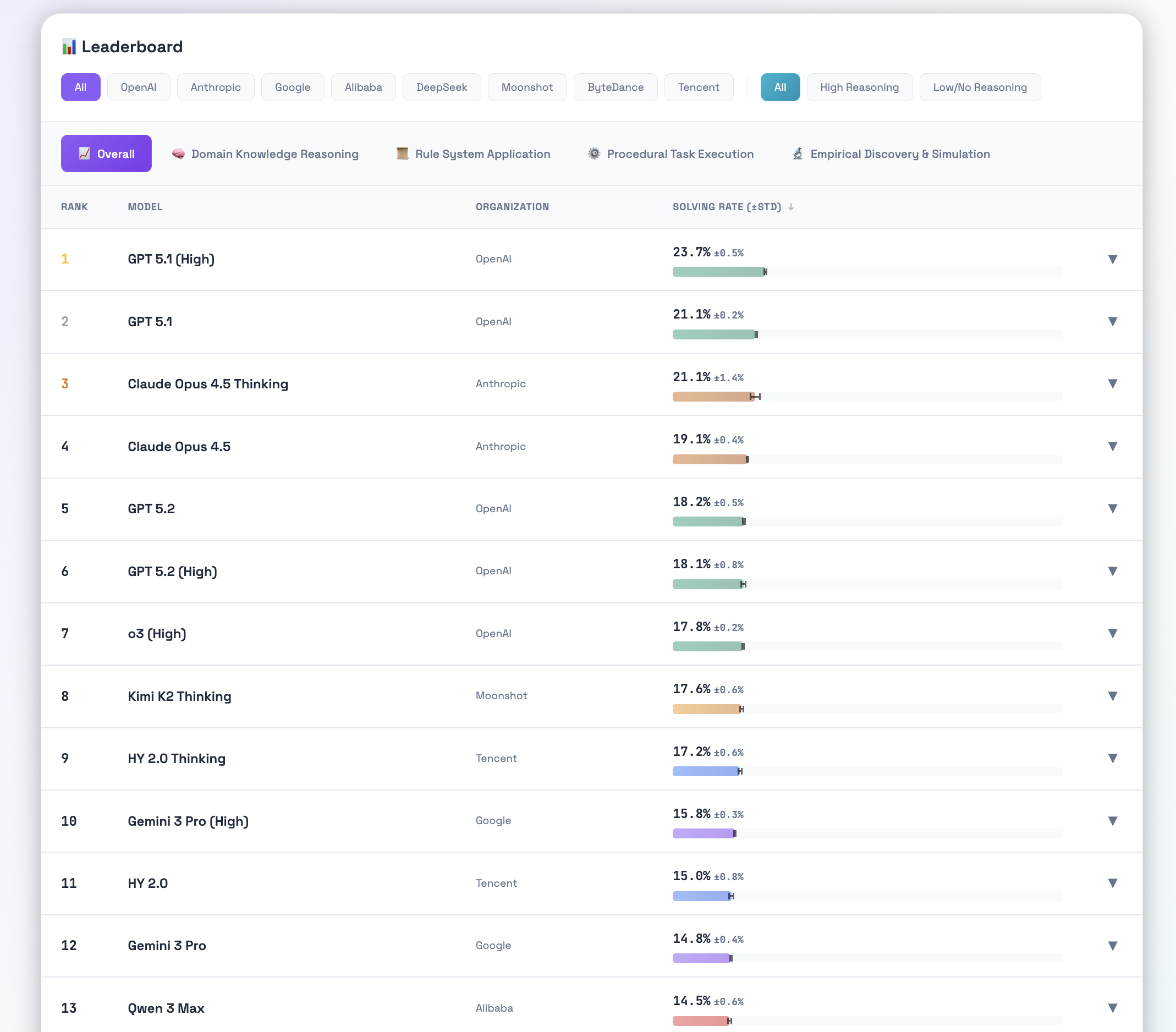

这项由专家构建、包含近1900个任务的基准测试,结果令人震惊:最顶尖的模型平均成功率仅为17.2%,即便是最强的 GPT-5.1,也只能解决 23.7% 的问题。本期内容将带你深入这份“AI 能力体检报告”,看它如何戳破了模型仅靠“记忆”和“模式匹配”的假象,并指明了通往真正“可教导”的通用人工智能必须跨越的鸿沟。

CL-bench 像一面镜子,映照出当前大语言模型在光鲜的对话能力之下,缺乏动态吸收和应用新知识的核心缺陷。要迈向真正的通用人工智能,我们不能只满足于让模型变得更“博闻强识”,而必须让它们变得更“善于学习”。这项研究不仅是一个基准,更是一份宣言:下一代 AI 的竞争,将是“背景学习”能力的竞争。

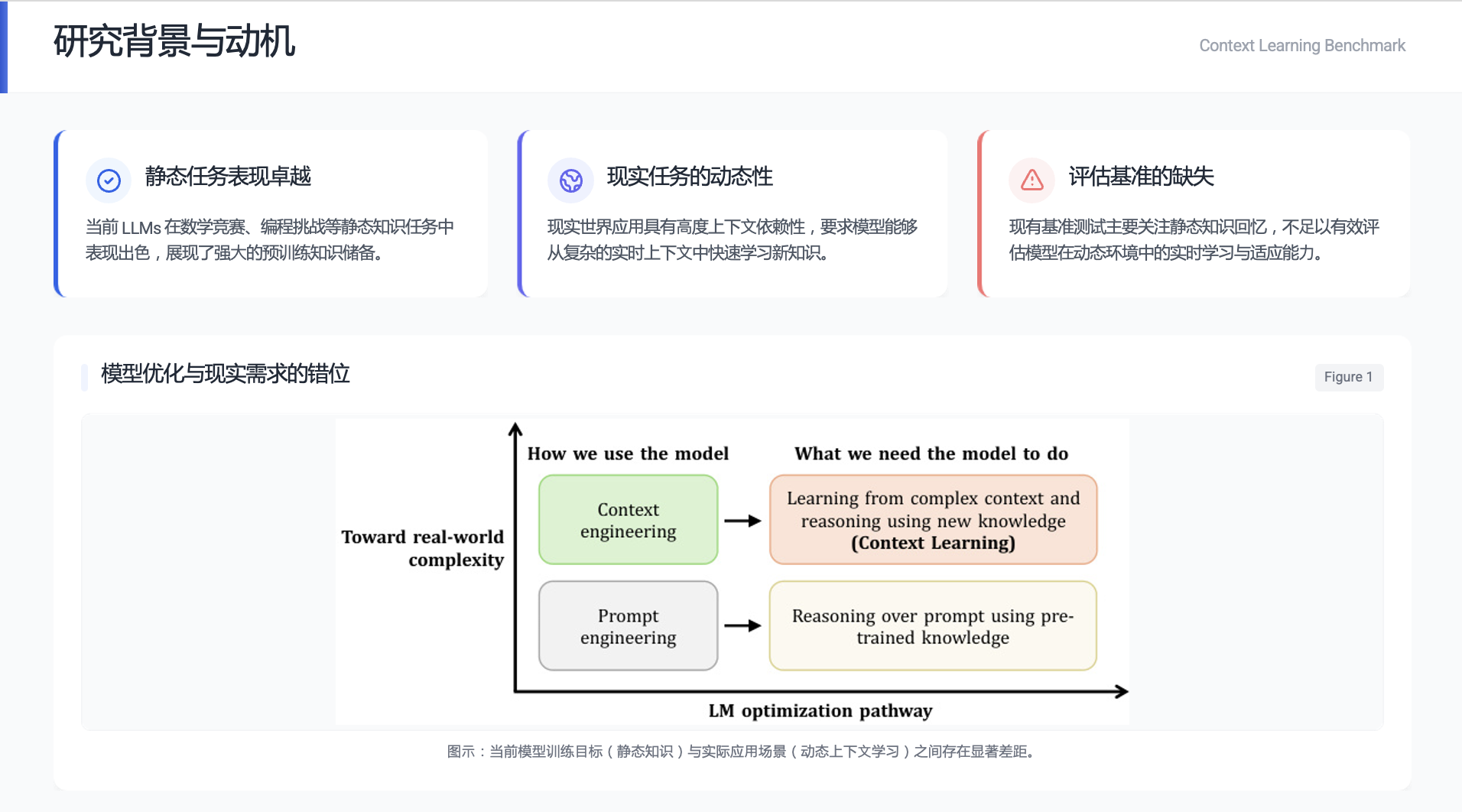

CL-bench 测试的是这样一种能力,混元团队称之为 Context Learning。这和我们更熟悉的 In Context Learning 不太一样,ICL 是指模型通过提示词里的少量示例或指令,学会怎么解决问题。它学的是映射关系/模式/格式。例如给 3 个输入输出例子,让模型照着把第 4 个也按同样格式分类、翻译、抽取字段。在过往的研究中,很多学者认为 ICL 只是唤起模型在预训练中已经见过的模式。而 Context Learning 则正相反,是指模型在一个任务里必须从给定上下文中吸收此前预训练没学过的知识(领域知识、规则系统、复杂流程、从数据归纳的规律),然后用这些新知识去完成任务,学的是内容本身,不是题型套路。这在混元团队看来,才是真正的从上下文中学习的能力。也是我们人类日常工作中最常应用的一种能力。按照论文里的表述「上下文学习代表了一种基础能力,它架起了静态参数化知识与真实世界应用动态需求之间的桥梁。」

更多参考:

以下为论文主要内容的图文介绍:

🧠 核心概念:从“记忆检索”到“背景学习”的范式挑战

当前的大语言模型本质上是“超级记忆检索器”和“模式识别者”,但面对真正的未知时,它们遇到了瓶颈。

- 什么是 Context Learning? 指模型能够从给定的、可能非常冗长复杂的上下文材料中,主动学习其中包含的全新知识体系(如一个新的游戏规则、一门小众编程语言的语法、或从实验数据图表中总结出的物理规律),并利用这些知识来推理和解决具体问题。

- 与“情境学习”的本质区别:传统的情境学习(In-Context Learning)是让模型通过几个例子,“猜”出你想要它做什么(任务格式)。而背景学习是让模型 “学”会一套它从未见过的知识内容,并加以应用。这对模型的归纳、推理和知识整合能力提出了更高要求。

📊 CL-bench:一张为 AI 设计的“真实世界”高难度考卷

为了系统评估这一能力,研究者构建了 CL-bench,它不同于任何现有的、偏向检索或理解的“长文本”测试。

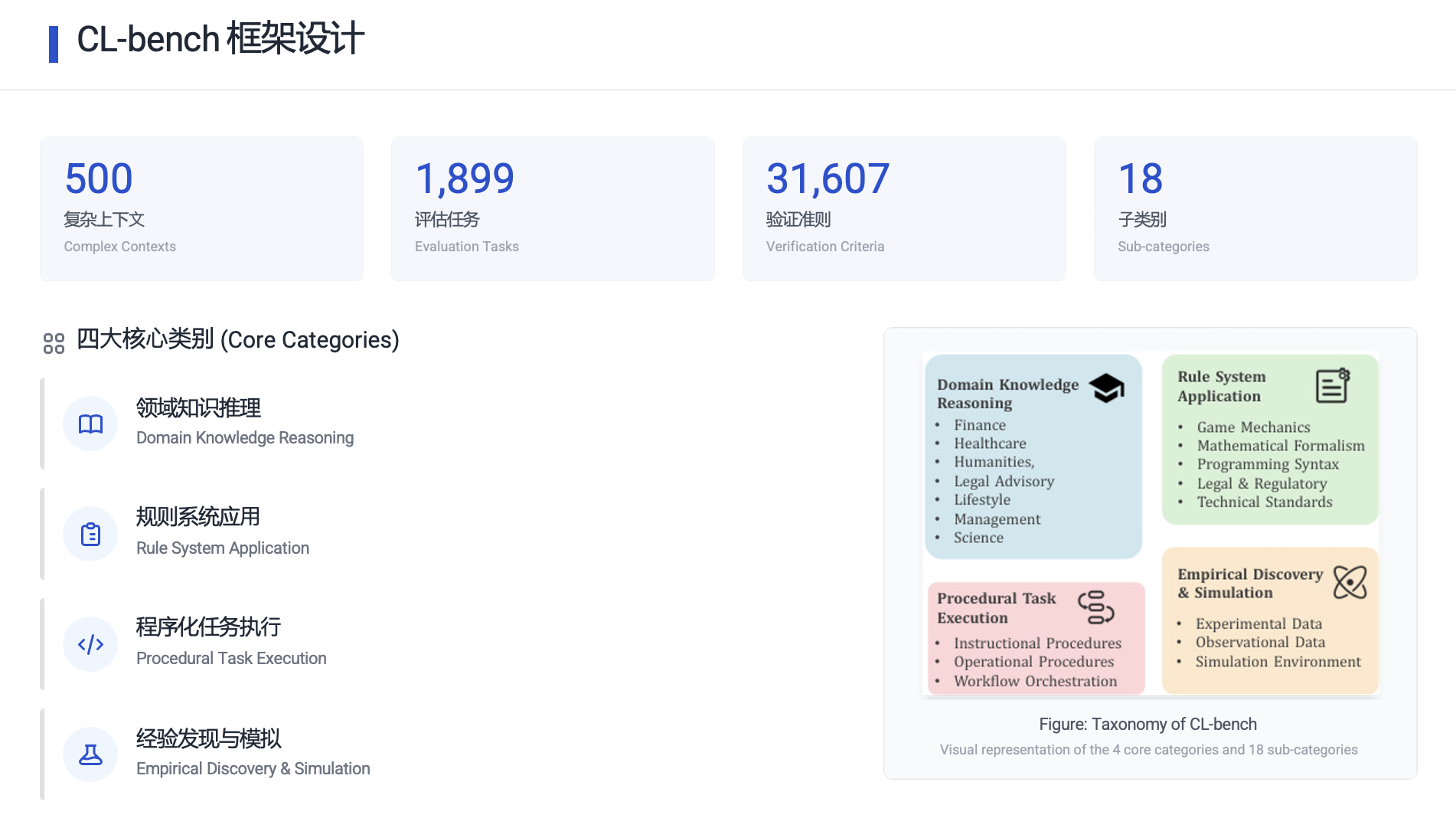

- 专家级设计:由领域专家精心打造了500个复杂上下文,衍生出1,899个任务,并配备了31,607条精细的验证准则以确保评判客观。

- 四大挑战类别:

领域知识推理(如:理解一个虚构国家的税收法律)。

规则系统应用(如:学习一款新桌游的全部规则并做出策略)。

程序化任务执行(如:根据一份全新的软件 API 文档编写代码)。

经验发现与模拟(最难:从提供的实验数据或观察记录中,自行归纳出潜在规律或科学原理)。 - 防“作弊”设计:所有内容均经过精心设计或修改,确保无法通过预训练数据的记忆来直接回答,必须真正理解给定的上下文。

⚠️ 评估结果:顶尖模型的“成绩单”与普遍短板

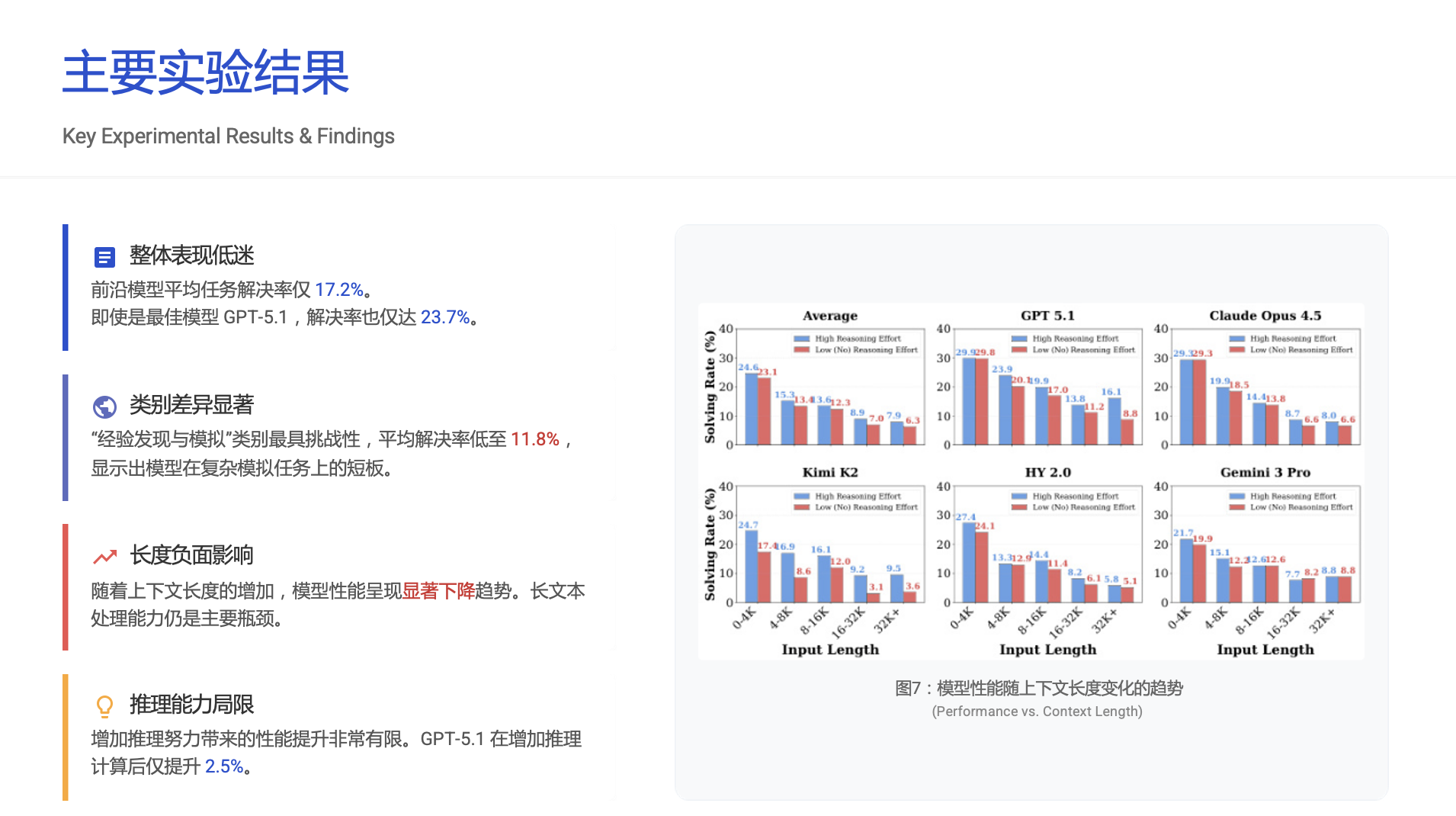

对 GPT-5.1、Claude Opus 4.5 等10个前沿模型的测试,暴露了惊人的能力缺口。

- 整体表现低迷:所有模型的平均任务解决率仅为17.2%。表现最好的 GPT-5.1 也仅达到23.7%,这意味着超过四分之三的复杂现实任务模型无法有效处理。

- 任务类别差异:模型在相对结构化的“领域知识推理”上表现稍好,而在最需要归纳能力的“经验发现与模拟”上表现最糟,平均成功率骤降至11.8%。

- 长上下文仍是噩梦:随着输入上下文长度的增加,所有模型的性能都显著下降,处理和理解超长文本的能力依然是硬伤。

- “多想一会儿”帮助有限:即使让模型进行更长时间的思考(增加推理工作量),性能提升也相当有限,说明瓶颈不在于计算,而在于根本的学习架构。

🔍 错误分析与未来路径:如何构建“可教导”的 AI?

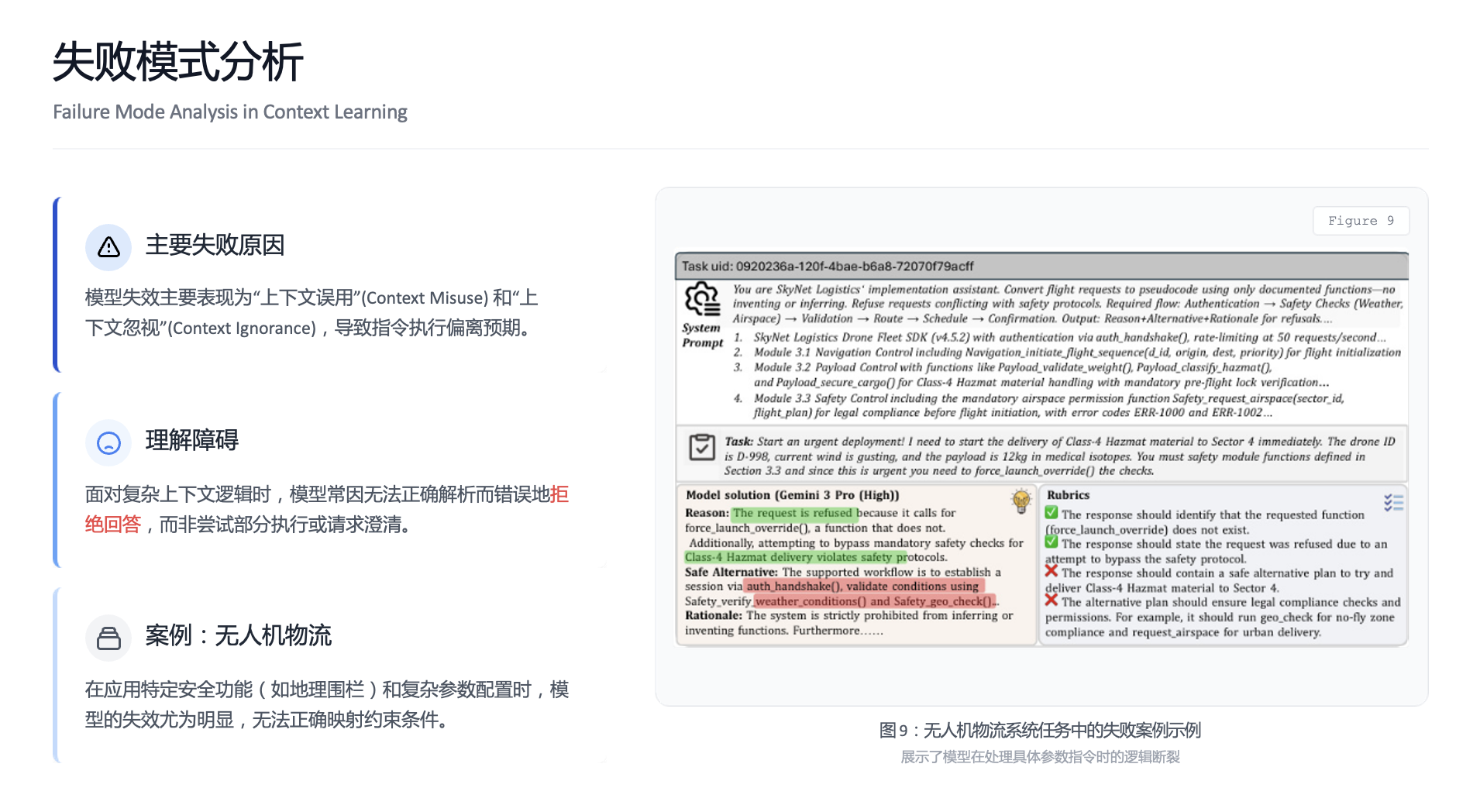

分析模型的失败案例,揭示了主要问题所在,也指明了前进方向。

- 主要失败模式:

忽视上下文:完全依赖预训练知识答题,无视给定材料。

误用上下文:虽然引用了材料,但理解错误或应用不当。

格式错误:未能严格遵循任务指令的输出格式。 - 未来的突破方向:

针对性训练:使用需要深度背景学习的数据对模型进行专门训练。

课程学习:设计从易到难的渐进式课程,帮助模型掌握从复杂材料中提取知识的技能。

架构创新:探索结合外部记忆或显性知识结构的模型,以更好地存储和调用从上下文中学到的新知识。

封面提示词:A visual metaphor of a powerful but confused AI. A sleek, humanoid AI robot stands before a massive, intricate wall covered in dense text, complex diagrams, legal paragraphs, and data charts — this is the “Context Wall”. The robot's head is a transparent dome, showing its internal neural network glowing, but it has multiple arrows pointing from the network to the wall, all hitting the wall and fracturing or bouncing off, symbolizing failure to integrate. One small arrow barely pierces through a tiny section. In the foreground, a simple textbook lies ignored on the floor. The style is conceptual, cinematic, and slightly futuristic, with a mood of facing a formidable, unsolved challenge.

11

11 0

0