说话人1: 哈喽大家好,今天咱们来聊一个特别有意思的游戏技术,就是能做出伪3D效果的光线投射引擎,这玩意儿我小时候玩老游戏的时候就特别好奇,明明感觉是3D,但后来才知道其实全是2D计算出来的。

说话人2: 对啊,我之前也听过这个词,但一直没搞明白到底是怎么回事,它真的不用3D建模吗?

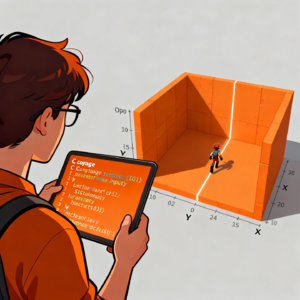

说话人1: 哎这就是关键了,李坚毅博士整理的内容里说,它本质就是用2D的计算逻辑来模拟3D的视觉效果,你想啊,咱们平时玩的正经3D游戏,得先建个3D模型,然后经过渲染管线一堆复杂步骤,但光线投射不一样,它就靠发射射线、检测碰撞这几步,就能造出沉浸式的3D世界,是不是特别神奇?

说话人2: 这么说的话,那它的计算量应该特别小吧?难怪早期硬件都能跑得动。

说话人1: 没错,而且李博士还提到了具体的计算逻辑,就拿最基础的网格地图来说,经典的是8×8的布局,每个网格是64个单位的立方体,这个尺寸设定特别讲究,既能保证视觉效果,又不会让计算量太大,你算一下,8×8总共才64个网格,每个网格就存0或者1两个数值,0是空的,1是墙,用数组一存就搞定了,开发者用个for循环就能把地图渲染出来,这比3D建模简单多了。

说话人2: 哦,原来地图是这么做出来的,那玩家怎么在里面移动啊?还有视角旋转又是怎么实现的?

说话人1: 玩家就是射线的发射源,首先得初始化他的坐标和运动属性,比如X、Y坐标定在网格里的初始位置,还要设移动速度和视角角度这些变量,然后所有操作都放在主循环里,保证实时响应。就拿移动来说吧,当你按W键的时候,玩家就沿当前视角方向的X、Y坐标同步增加,按S键就减少,这里面还得用到三角函数来计算移动的方向,比如cos和sin函数来算X、Y的增量,对吧?

说话人2: 对哦,我上学的时候学过三角函数,但没想到游戏里用得这么直接。那视角旋转呢?是不是也得用三角函数?

说话人1: 没错,李博士说视角旋转的核心就是用sin、cos和圆周率π来算的,首先得定义一个视角角度变量pa,初始角度设为0,每次旋转就加或者减0.1个弧度,这样旋转起来就很平滑。然后用pdx=cos(pa)×速度,pdy=sin(pa)×速度来算视角方向的X、Y增量,这样玩家前后移动的时候就跟着视角方向走了。而且角度还得限制在0到2π之间,转一圈就回到原来的角度,不会乱。

说话人2: 原来如此,那射线发射和碰撞检测又是怎么回事?这应该是整个引擎的核心吧?

说话人1: 必须是啊,李坚毅博士整理的内容里把这部分拆解得特别清楚,首先经典的引擎会发射60条射线,覆盖左右各30度的视野,总共60度的可视角度,这个数量刚好平衡了视觉效果和计算量。射线发射出去之后,要分别检测水平和垂直的网格线,就拿水平网格线检测来说,首先得算正切值的倒数aTan=1/tan(ra),ra是射线角度,这个是计算坐标的核心系数。

说话人2: 等一下,为什么要算正切值的倒数啊?

说话人1: 因为射线是从玩家位置发射出去的,要找它和水平网格线的交点,用正切的倒数就能快速算出X坐标的变化量。然后根据射线是向上还是向下发射,确定初始的Y坐标,再用aTan算出对应的X坐标。之后每次更新交点坐标的时候,Y方向的偏移量固定是64个单位,和网格尺寸一样,X方向就是64乘以aTan,根据射线方向调整正负。然后每次把坐标除以64,找到对应的网格,看是不是1,如果是1就说明撞到墙了,就停止检测记录坐标。

说话人2: 哦,原来是这样,那垂直网格线检测是不是逻辑差不多?

说话人1: 对,就是把X和Y互换一下,然后根据射线向左还是向右来调整初始坐标和偏移量的正负,而且水平检测用绿色射线,垂直用红色,方便调试。这里面还有个优化点,就是要保证检测的坐标在0到数组大小之间,不然会数组越界导致程序崩溃,还得设个最大检查深度,防止射线一直检测不停,造成死循环。

说话人2: 那碰撞之后怎么把2D的计算结果变成3D的画面呢?

说话人1: 这就到了关键的一步了,就是根据射线和墙体的距离来绘制垂直线段,核心逻辑就是近大远小,距离越近,线段越高,越远就越矮。比如60条射线就画60条垂直线段,拼起来就是3D的墙体画面了。不过这里面有个问题,就是鱼眼效应,视野边缘的墙体会扭曲拉伸,你知道为什么吗?

说话人2: 是不是因为射线的实际距离和视觉上的垂直距离不一样啊?

说话人1: 没错,李博士说就是这个原因,视野边缘的射线距离更远,导致画面变形,校正的方法就是用角度差的余弦值来修正,计算玩家视角和每条射线方向的角度差,把实际距离乘以这个余弦值,得到校正后的距离,再用这个距离来画线段,就能消除鱼眼效应了,画面就平整多了。

说话人2: 这个校正方法还挺巧妙的,那它的光照效果是怎么做的呢?总不能真的搞个光照模型吧?

说话人1: 不用不用,它的光照特别简单,就是靠颜色亮度来模拟,比如检测到射线击中的是垂直面就设成亮白色,水平面设成浅灰色,用颜色的明暗差异来做出光照和阴影的感觉,既简单又有效,完全不用复杂的光照模型,这也是它效率高的原因之一。

说话人2: 哦,这样啊,那它还能做哪些拓展功能啊?总不能一直都是白墙黑地吧?

说话人1: 李博士提到了好几种拓展方向,比如纹理映射,给墙体贴个图片,就不用单一的颜色了,这样游戏世界就逼真多了;还有动画效果,加个门或者敌人,结合碰撞检测就能做出互动动画;还能加音效系统,比如撞到墙的时候响一声,移动的时候有脚步声,提升沉浸感;甚至还能切换视角,比如改成90度或者120度的视野,适配不同的游戏需求。

说话人2: 这么看来,它的拓展性还挺强的,而且还能移植到GBA那种嵌入式设备上?

说话人1: 对呀,李坚毅博士整理的内容里说,它的轻量性就是最大的优势,移植的时候只要适配一下设备的窗口尺寸和分辨率,优化一下代码减少不必要的计算,再把OpenGL换成设备的图形库就行,在GBA上都能流畅运行,这也是为什么现在独立游戏开发者特别喜欢用它,成本低,效果又好。

说话人2: 那开发这个引擎难不难啊?是不是得特别懂编程?

说话人1: 其实入门不难,只要掌握C语言和OpenGL的基础用法,再加上三角函数、勾股定理这些初中数学知识就行。你想啊,步骤都是固定的,先做游戏世界的网格地图,再初始化玩家角色,然后写射线发射和碰撞检测的逻辑,最后把计算结果渲染成3D画面,一步步来就行,而且调试的时候还能看到红绿射线,很容易找到问题。

说话人2: 听起来好像真的可以试试,那它除了做游戏,还有别的应用场景吗?

说话人1: 当然有了,李博士说它的核心射线检测逻辑还能用到VR、AR还有路径规划这些领域,比如VR里的空间定位,AR里的平面检测,还有无人机的避障,其实原理都差不多,都是发射射线检测碰撞,是不是没想到它的应用范围这么广?

说话人2: 对啊,原来一个游戏引擎的技术还能用到这么多地方,这也太实用了。

说话人1: 没错,而且它从1992年的《德军总部3D》就开始用了,到现在三十多年了,还在被独立开发者们用着,足以说明它的生命力有多强。你想啊,现在很多复古风格的独立游戏,都是用光线投射引擎做的,既有怀旧感,又不用太复杂的技术,成本低,效果还到位。

说话人2: 我突然想到,以前玩的那些老FPS游戏,比如《毁灭战士》,是不是也是用的类似的技术?

说话人1: 对呀,早期的FPS游戏很多都是用光线投射或者类似的伪3D技术做的,因为当时的硬件根本跑不动真3D,而光线投射刚好能在有限的硬件条件下做出3D的视觉效果,这才让FPS游戏火了起来,可以说它是早期3D游戏的功臣之一了。

说话人2: 原来是这样,那它和现在的真3D引擎比起来,优势和劣势都有哪些啊?

说话人1: 优势就是轻量、高效,开发成本低,对硬件要求不高,适合做复古游戏或者快速原型;劣势嘛,就是视觉效果肯定不如真3D引擎,比如不能做复杂的曲面模型,不能实现复杂的光照和阴影,还有视野范围也比较有限,一般都是60度或者90度,不过对于复古游戏来说,这些都不是问题,反而成了特色。

说话人2: 没错,复古游戏追求的就是那种怀旧的感觉,光线投射引擎刚好能完美匹配这种需求。

说话人1: 而且李博士还提到,它的学习价值特别高,尤其是对新手开发者来说,通过开发一个光线投射引擎,能学到C语言编程、图形学基础、逻辑优化这些东西,这些都是游戏开发的核心技能,学会了之后再去学真3D引擎就容易多了,相当于一个很好的入门实践项目。

说话人2: 这么看来,它不仅是个游戏技术,还是个很好的学习工具啊。

说话人1: 对啊,我觉得现在很多新手开发者都可以试试这个,既能做出看得见的成果,又能学到实实在在的知识,比光看书强多了。而且现在开发环境也很方便,Dev C和OpenGL都是免费的,安装起来也简单,很快就能搭建好环境开始写代码。

说话人2: 听起来真的挺吸引人的,我都有点想试试了。

说话人1: 哈哈,感兴趣就去试试嘛,李坚毅博士整理的内容里把每个步骤都讲得很清楚,从地图制作到玩家移动,再到射线检测和3D渲染,一步步来肯定能做出来。而且做完基础版本之后,还可以自己加一些拓展功能,比如贴个纹理,加个敌人,做个简单的关卡,成就感肯定特别强。

说话人2: 好啊,等有空我就去研究研究,今天聊了这么多,我终于明白光线投射引擎到底是怎么回事了,原来这么神奇的3D效果,背后居然是这么巧妙的2D计算。

说话人1: 没错,这就是技术的魅力所在,用最简单的逻辑实现最惊艳的效果,而且它还能一直沿用至今,说明经典的技术永远不会过时。今天咱们就聊到这儿,希望大家听完之后对光线投射引擎有了更深的了解,要是你也做过相关的游戏或者有什么想法,欢迎来评论区和我们交流。

光线投射引擎超有趣

11分钟 · 4·

4· 0

0

4

4 0

0