Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。

如果你有自己的论文要解读,或者推荐论文,请留言。

今天的主题是:

Extending the Context of Pretrained LLMs by Dropping Their Positional Embeddings

Summary

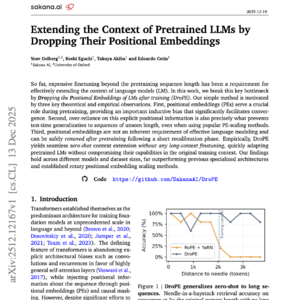

迄今为止,要有效扩展语言模型(LM)的上下文长度,通常需要进行超出预训练序列长度范围的高成本微调。在本研究中,我们通过在训练完成后移除语言模型中的位置嵌入(Dropping the Positional Embeddings,简称 DroPE),突破了这一关键瓶颈。

该方法虽简单,却建立在三个重要的理论与实证观察之上。首先,位置嵌入(Positional Embeddings, PEs)在预训练阶段发挥着关键作用,作为一种重要的归纳偏置,能够显著促进模型收敛。其次,模型对这种显式位置信息的过度依赖,恰恰成为其在测试阶段无法泛化到未见序列长度的根本原因,即便采用主流的位置嵌入缩放方法亦难以解决这一问题。第三,位置嵌入并非高效语言建模的内在必要条件,在完成预训练后,经过一个简短的再校准阶段,便可以安全移除,而不会破坏模型能力。

在实证层面,DroPE 方法无需进行任何长上下文微调,即可实现无缝的零样本上下文扩展;同时,它能够快速适配预训练语言模型,而不会削弱其在原始训练上下文范围内的性能。实验结果表明,该方法在不同模型规模与数据规模条件下均表现稳健,显著优于以往的专用架构设计以及成熟的旋转位置嵌入(Rotary Positional Embedding)缩放方法。

原文链接:arxiv.org

0

0 0

0