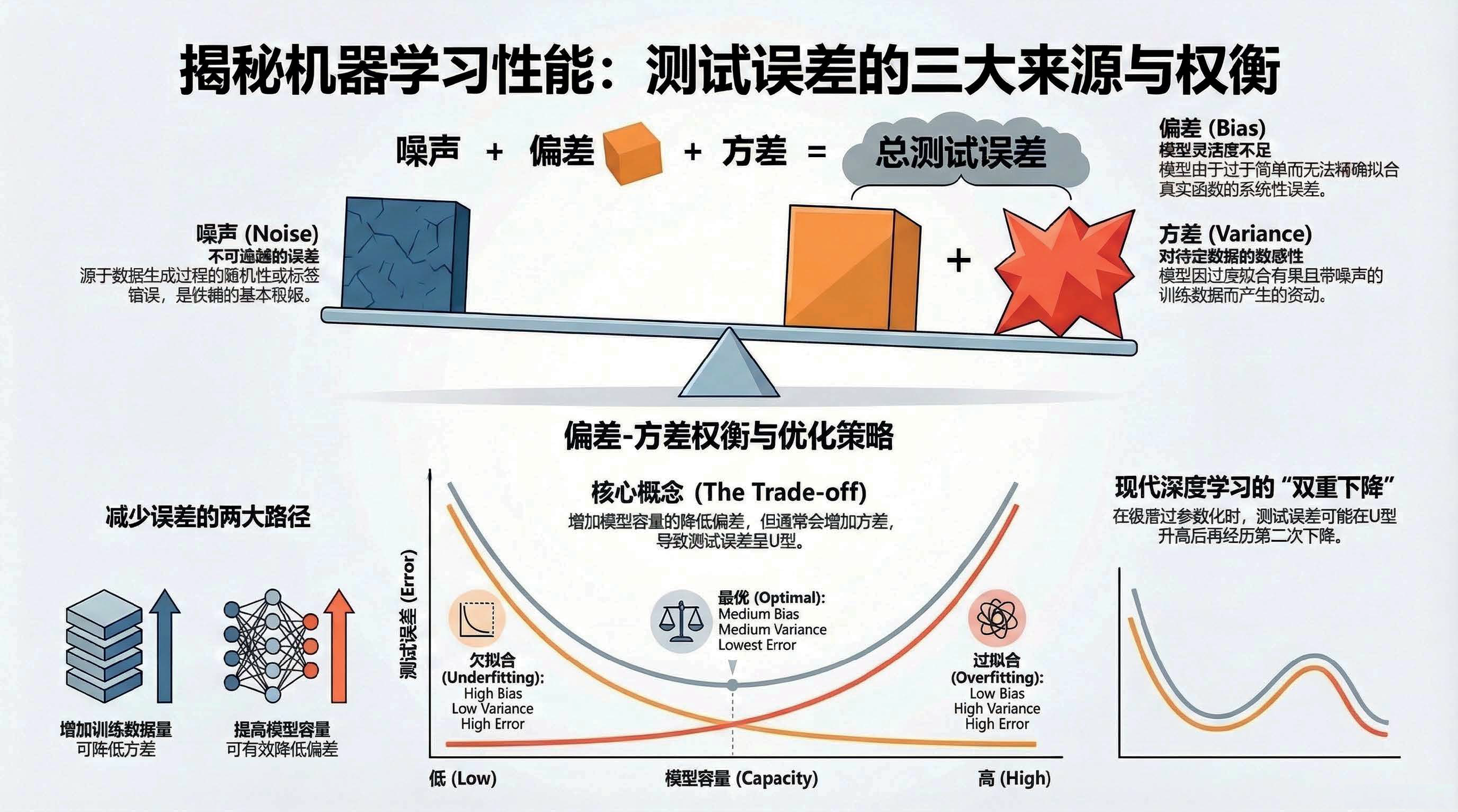

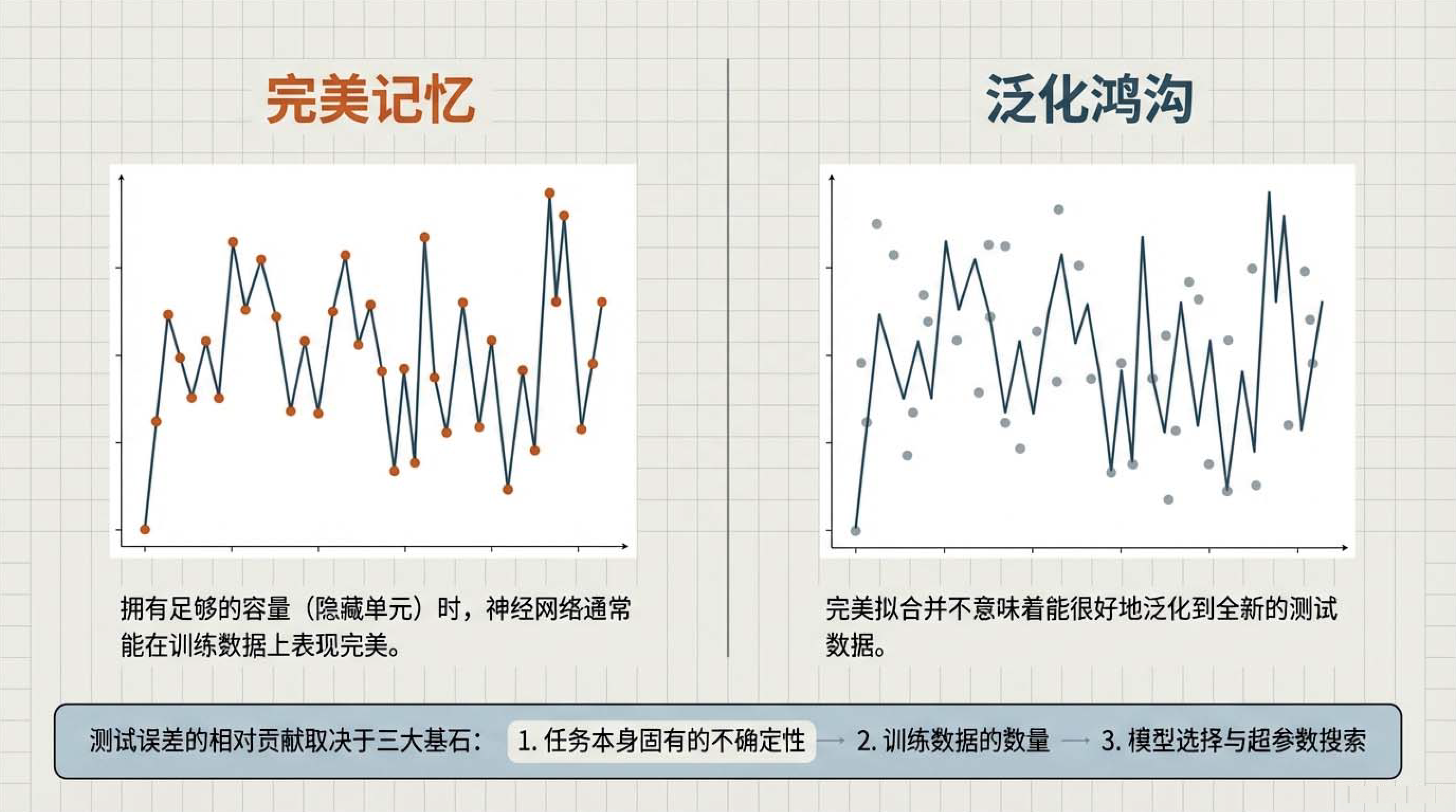

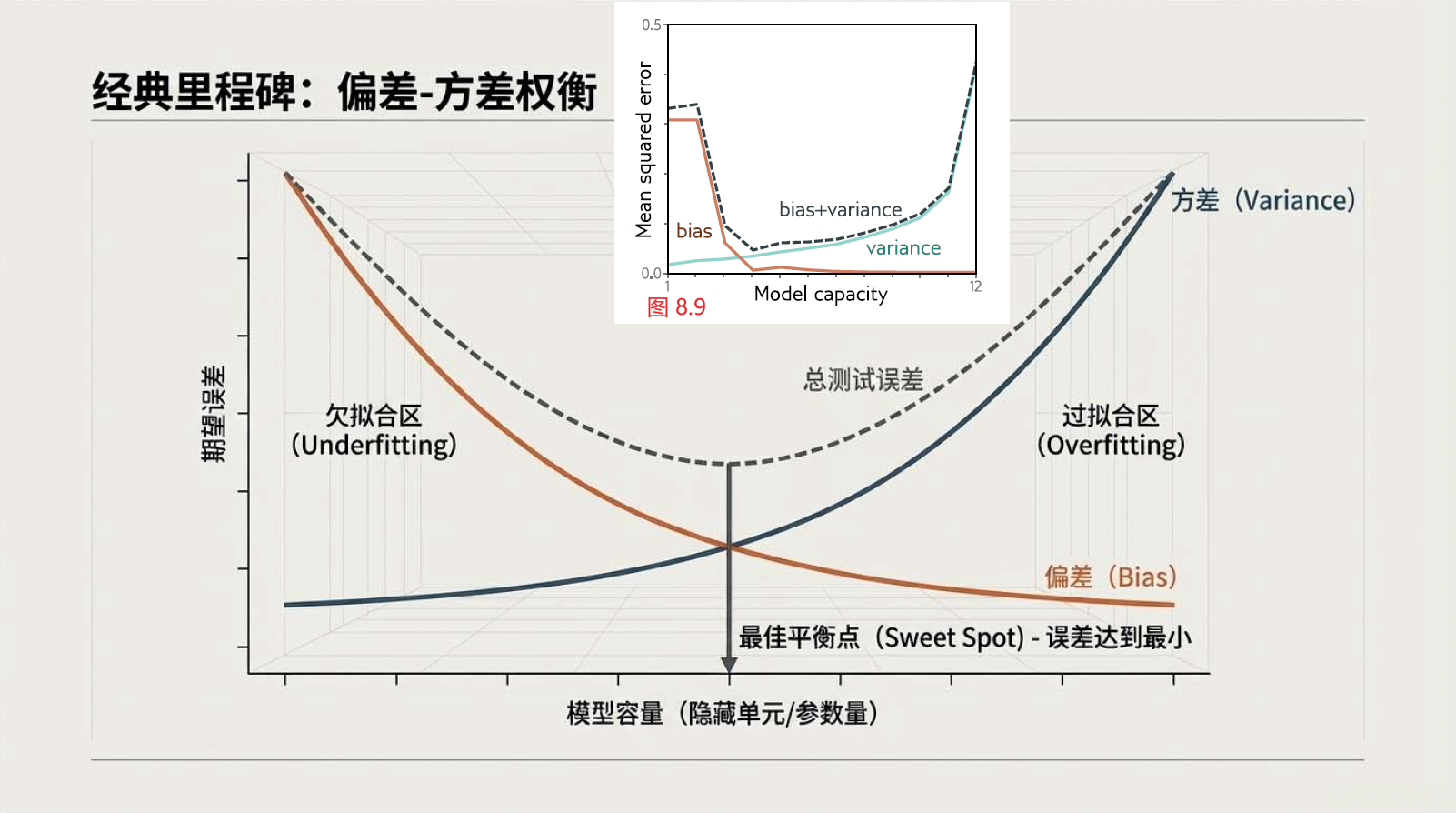

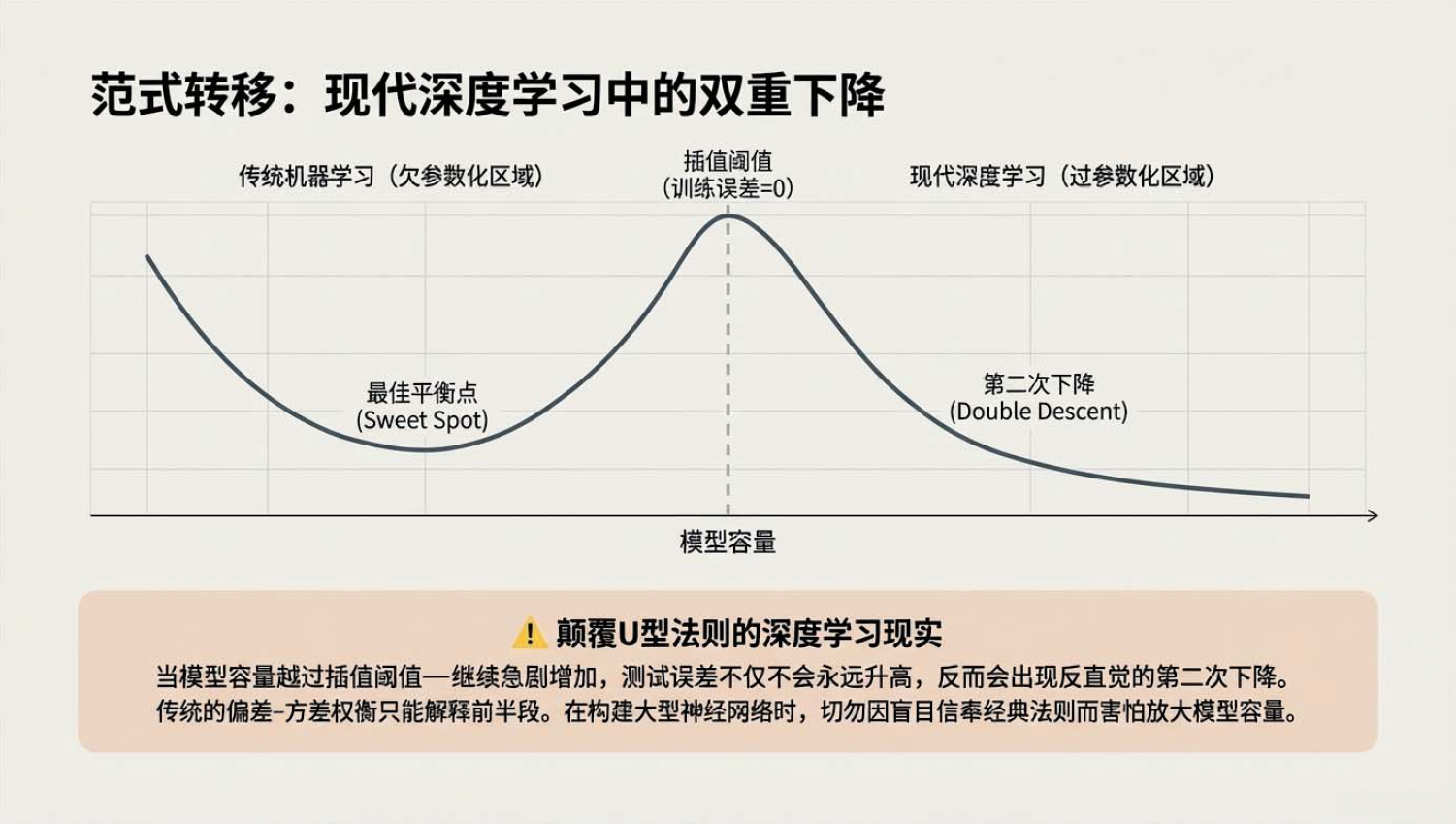

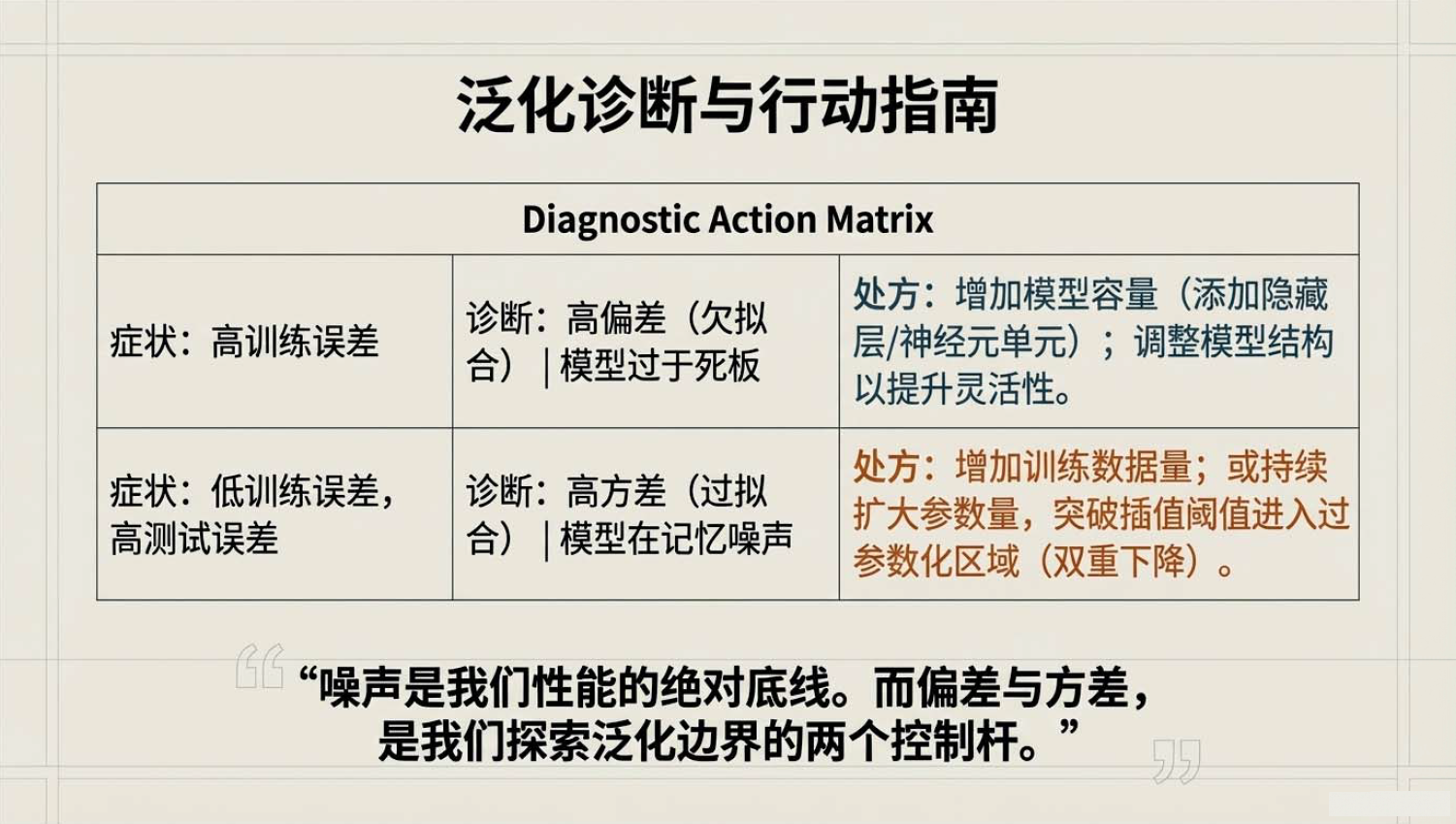

训练误差归零并不代表大功告成,往往只是模型“死记硬背”而已,。本章将直面深度学习的核心矛盾:如何让模型从有限的经验中提炼规律,而非迷失在噪声的丛林里,?我们将拆解误差的三重本质——噪声、偏差与方差,重新审视容量增加带来的“偏差-方差权衡”, 预告现代模型将会出现“双重下降”实现性能的二次飞跃。

第14课完整讲义:zhuanlan.zhihu.com

00:00 开篇语

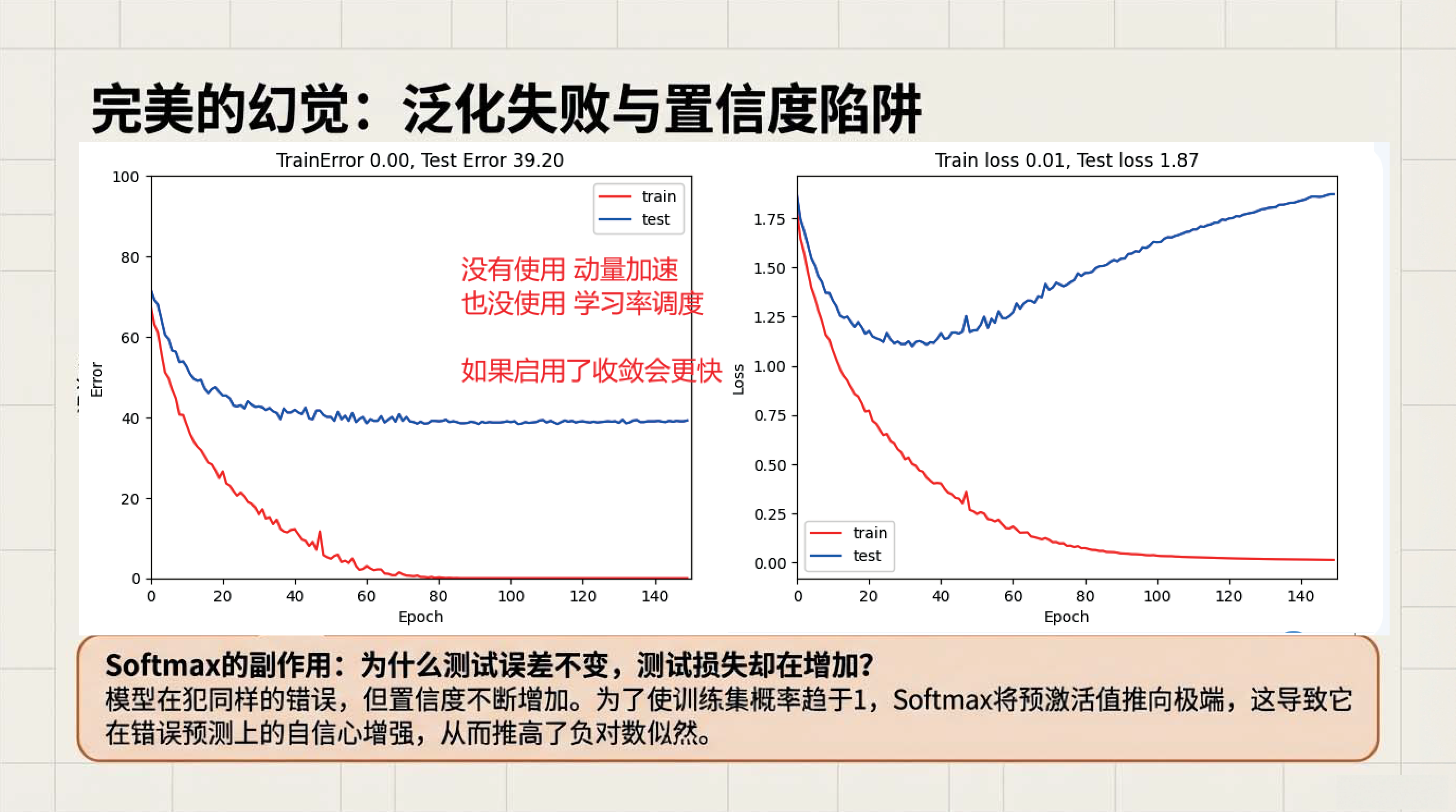

00:44 完美记忆和泛化鸿沟

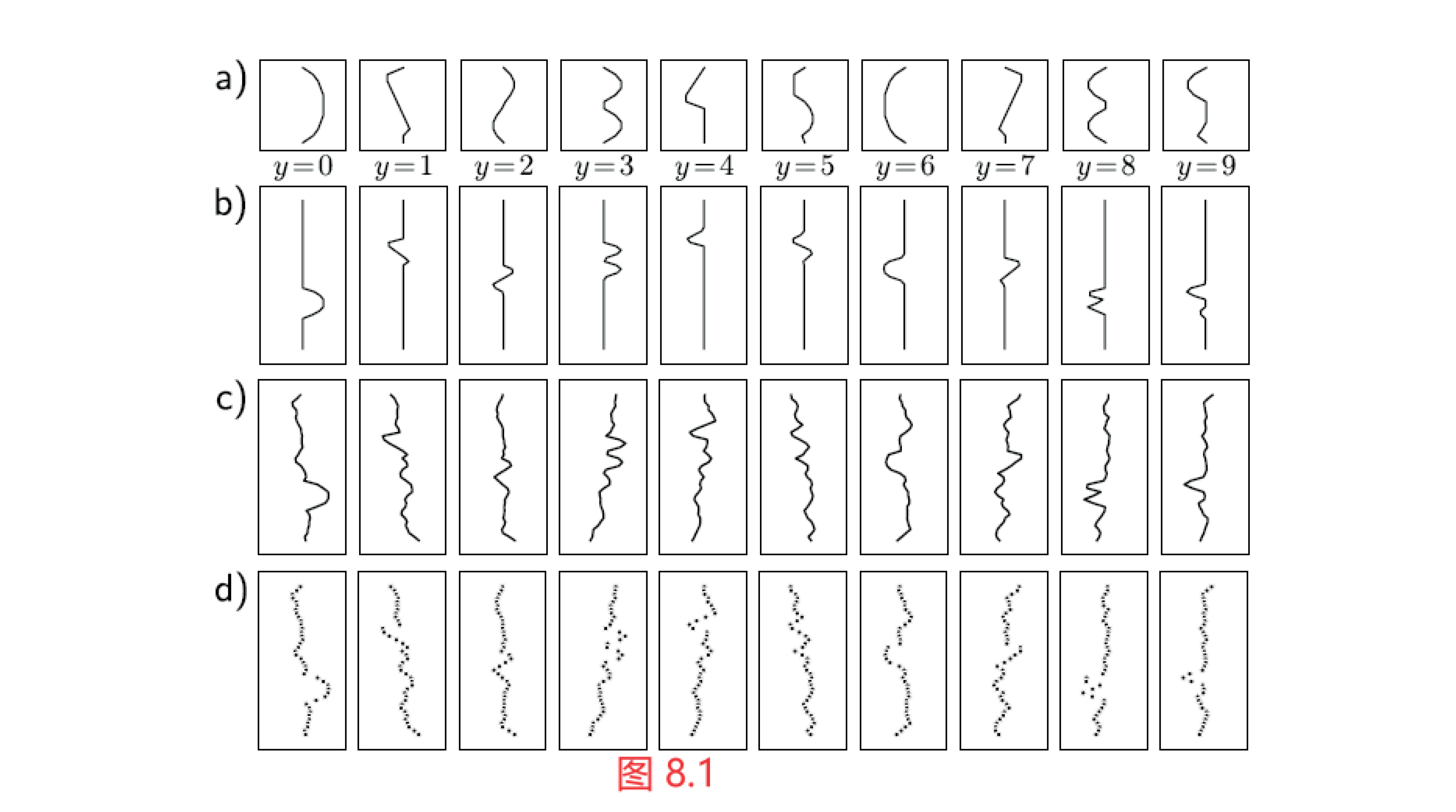

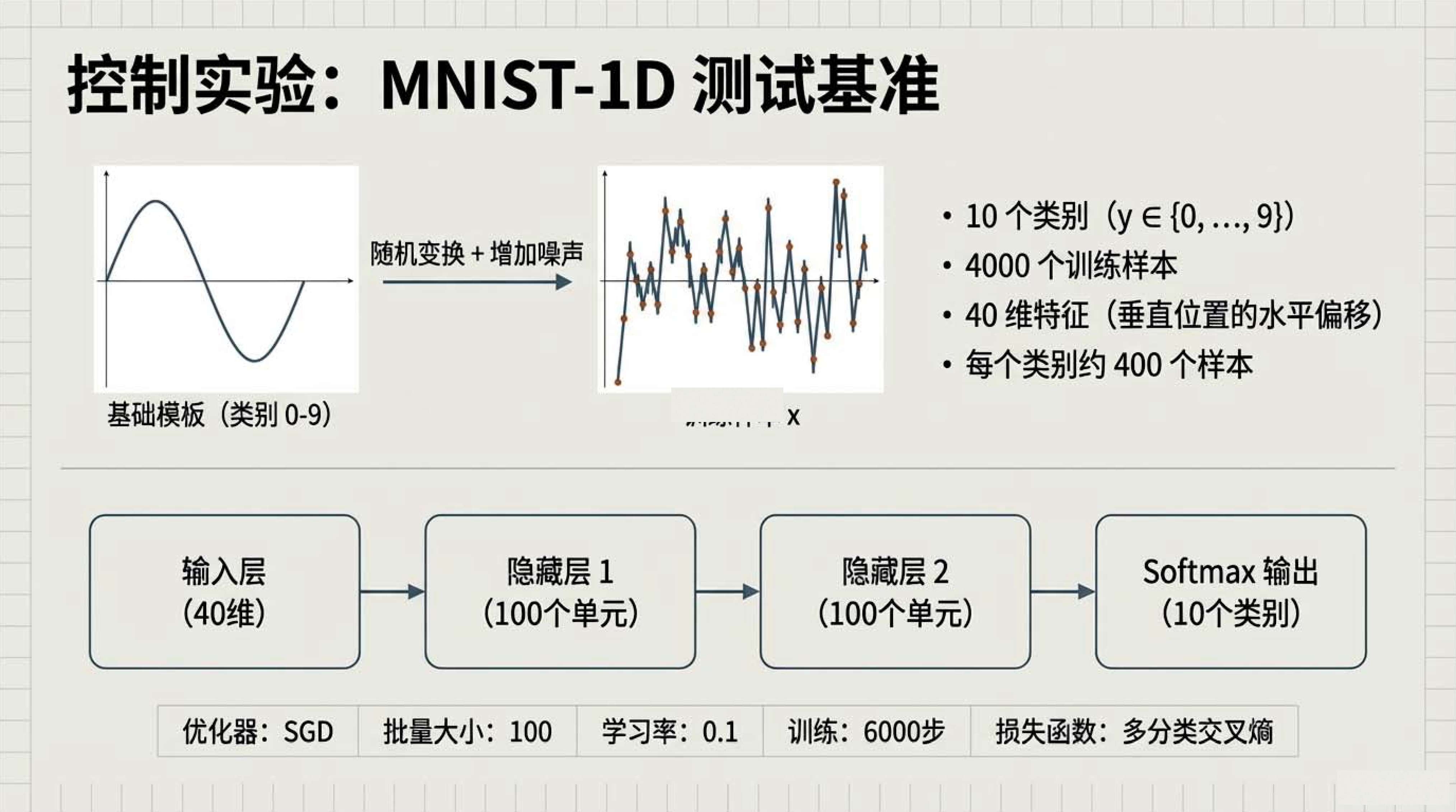

02:10 MNIST-1D 基准测试

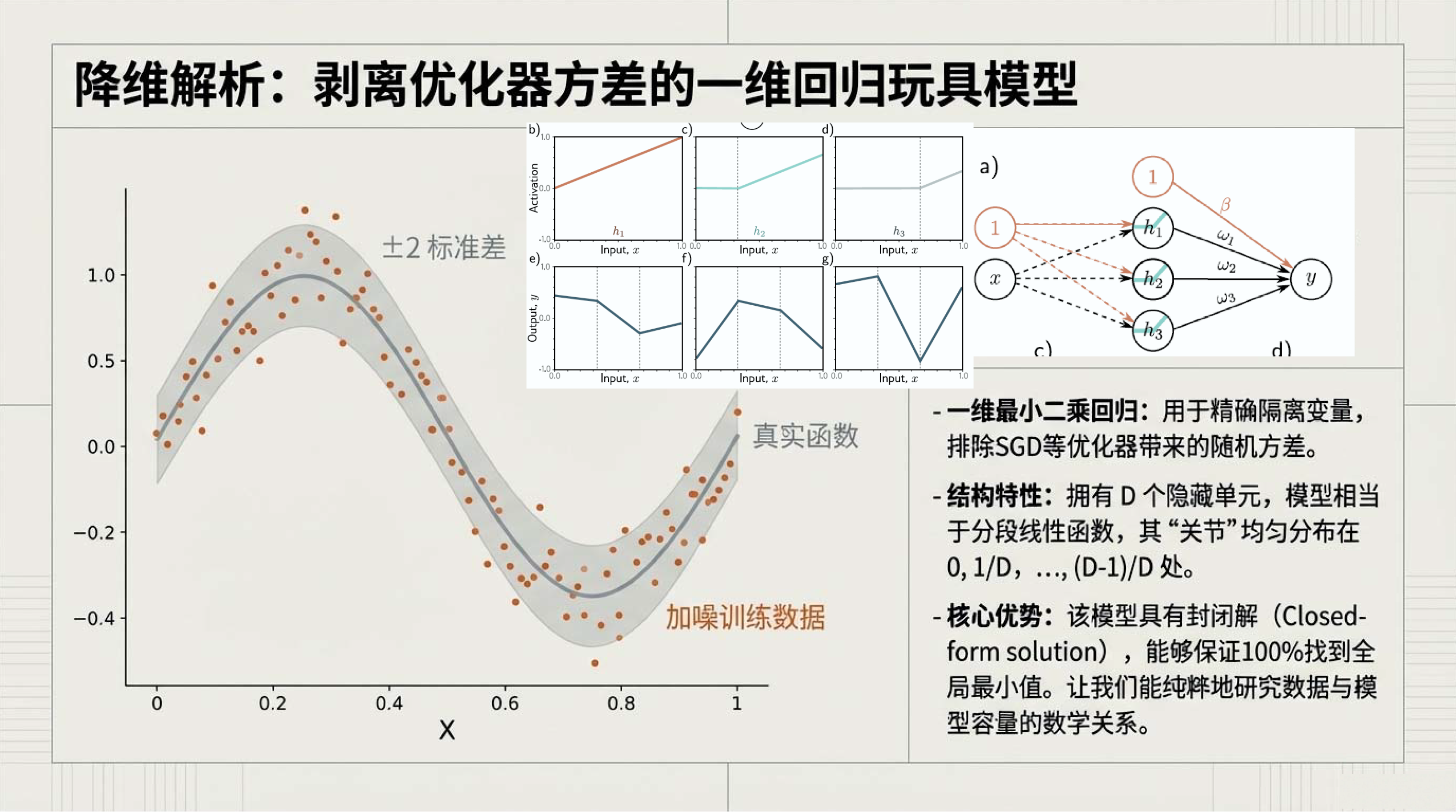

06:17 一维回归玩具模型

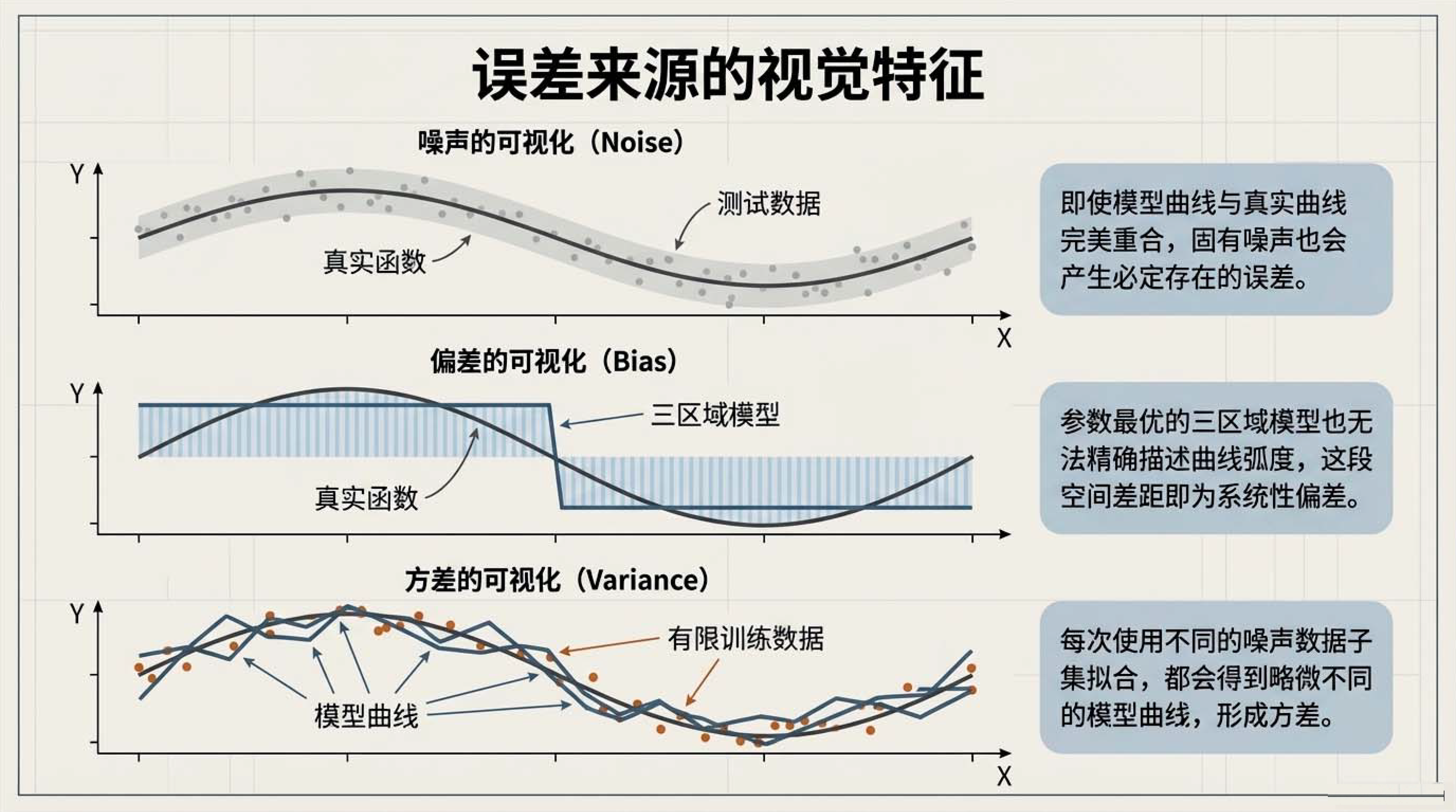

07:51 三种误差

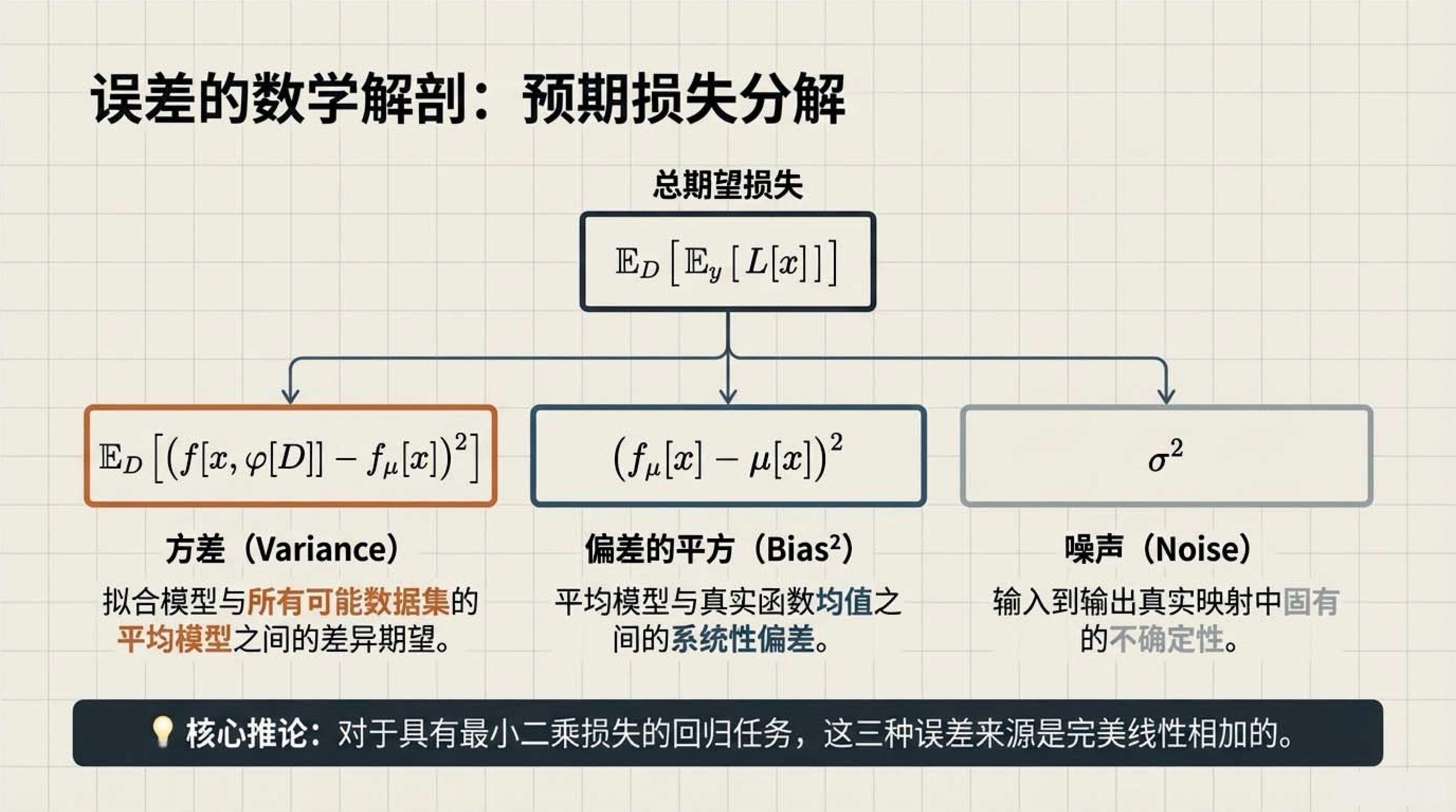

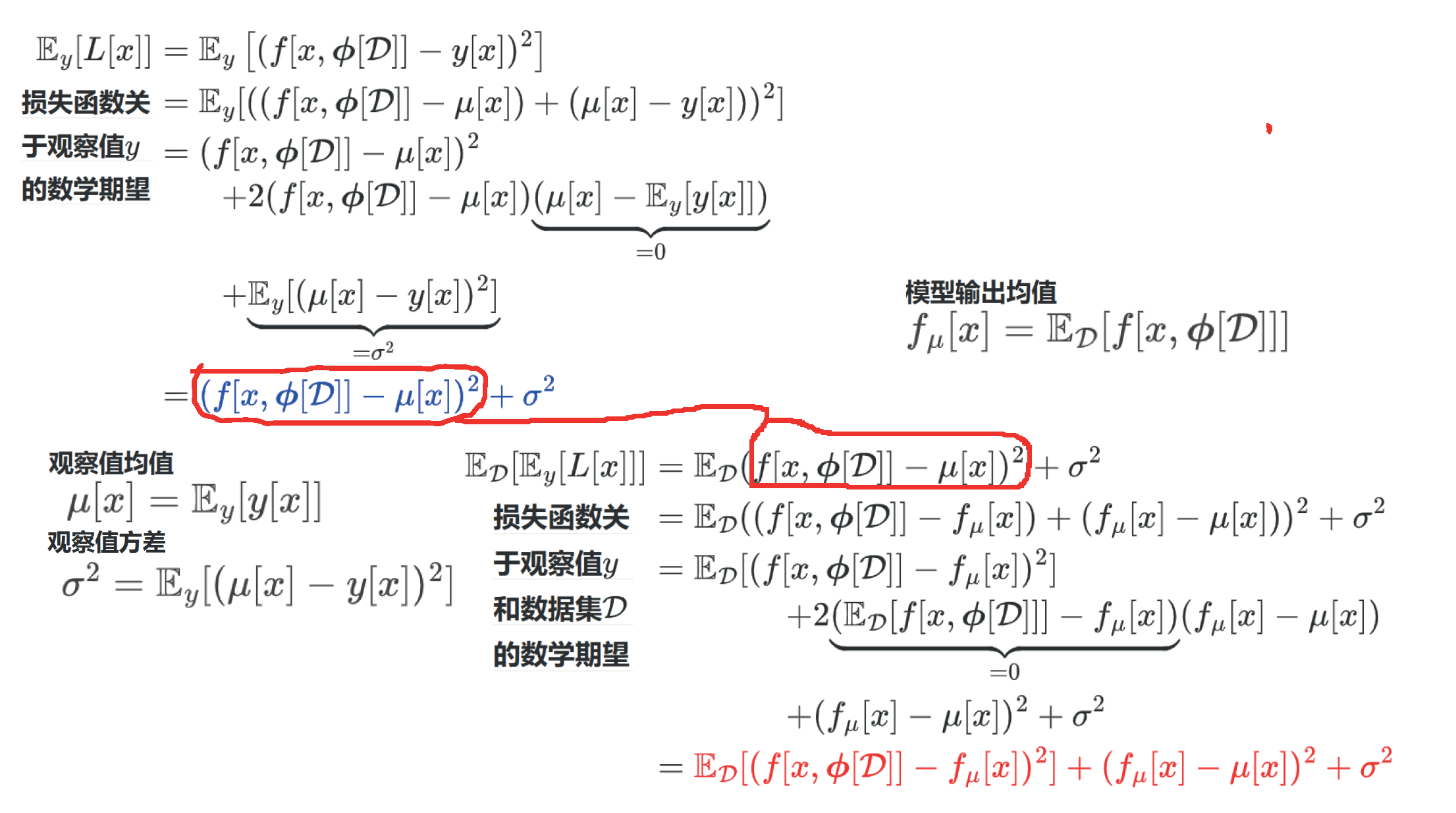

10:22 损失期望的分解

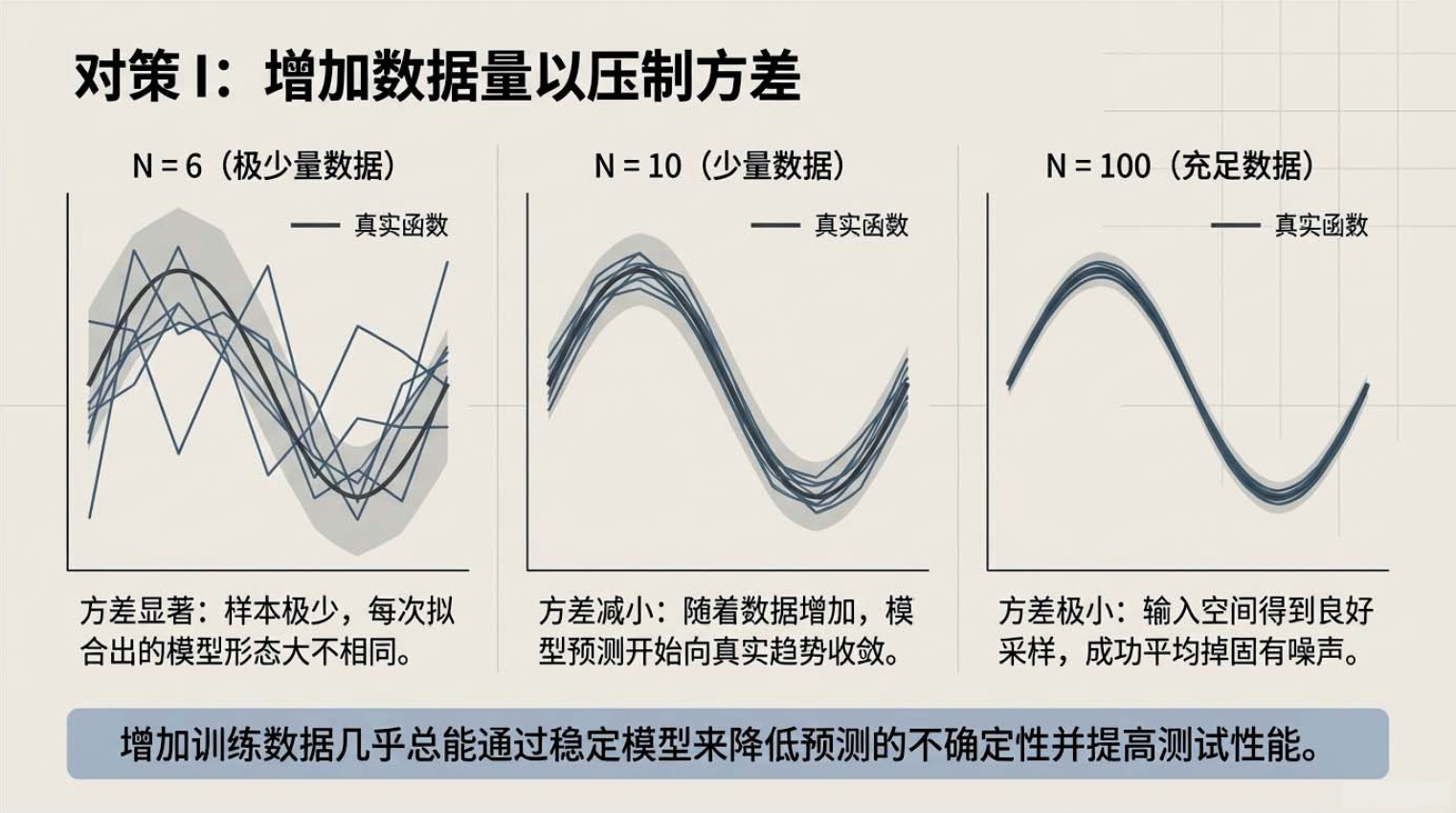

14:46 增加数据量压制方差

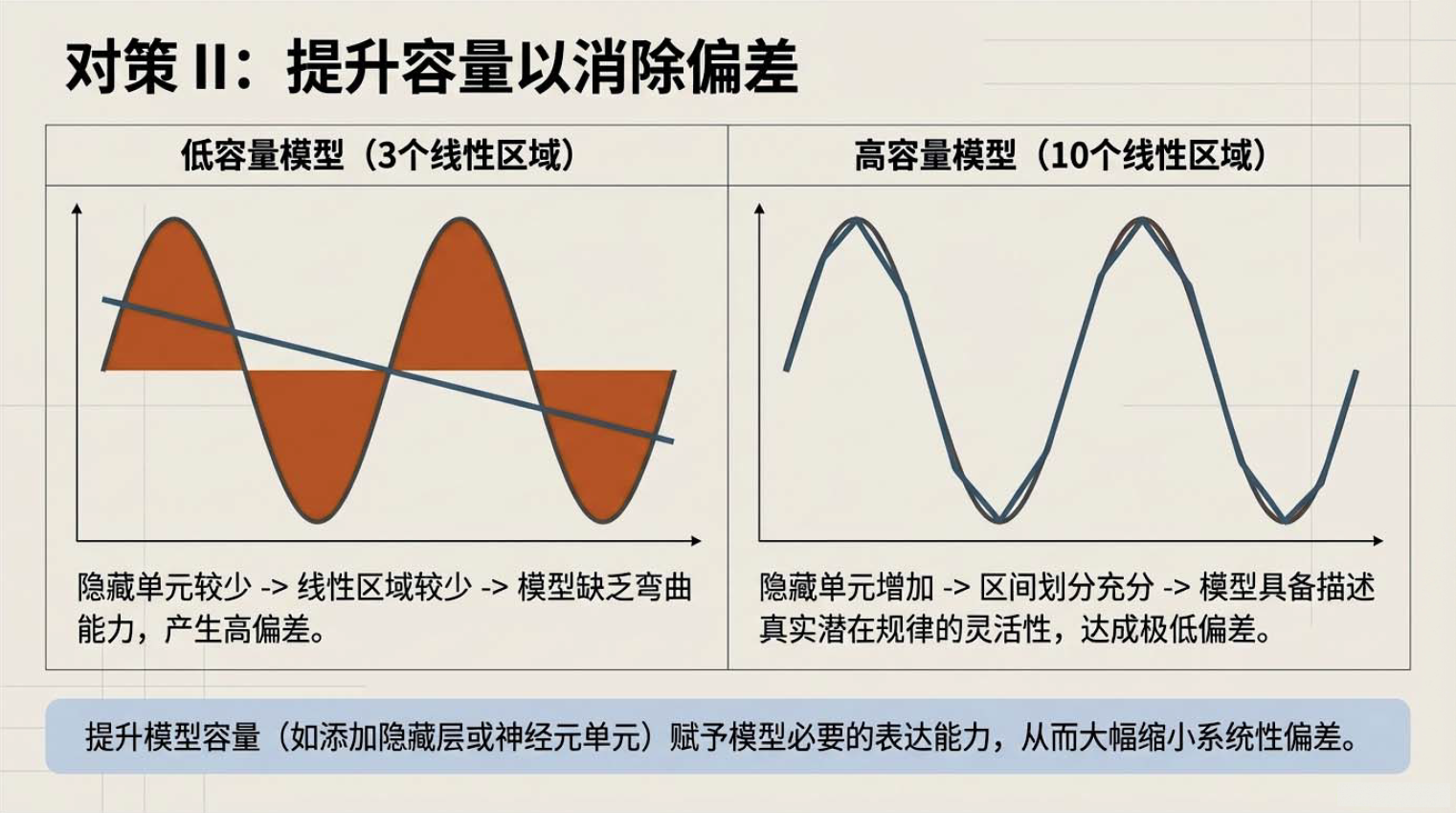

15:41 提升容量消除偏差

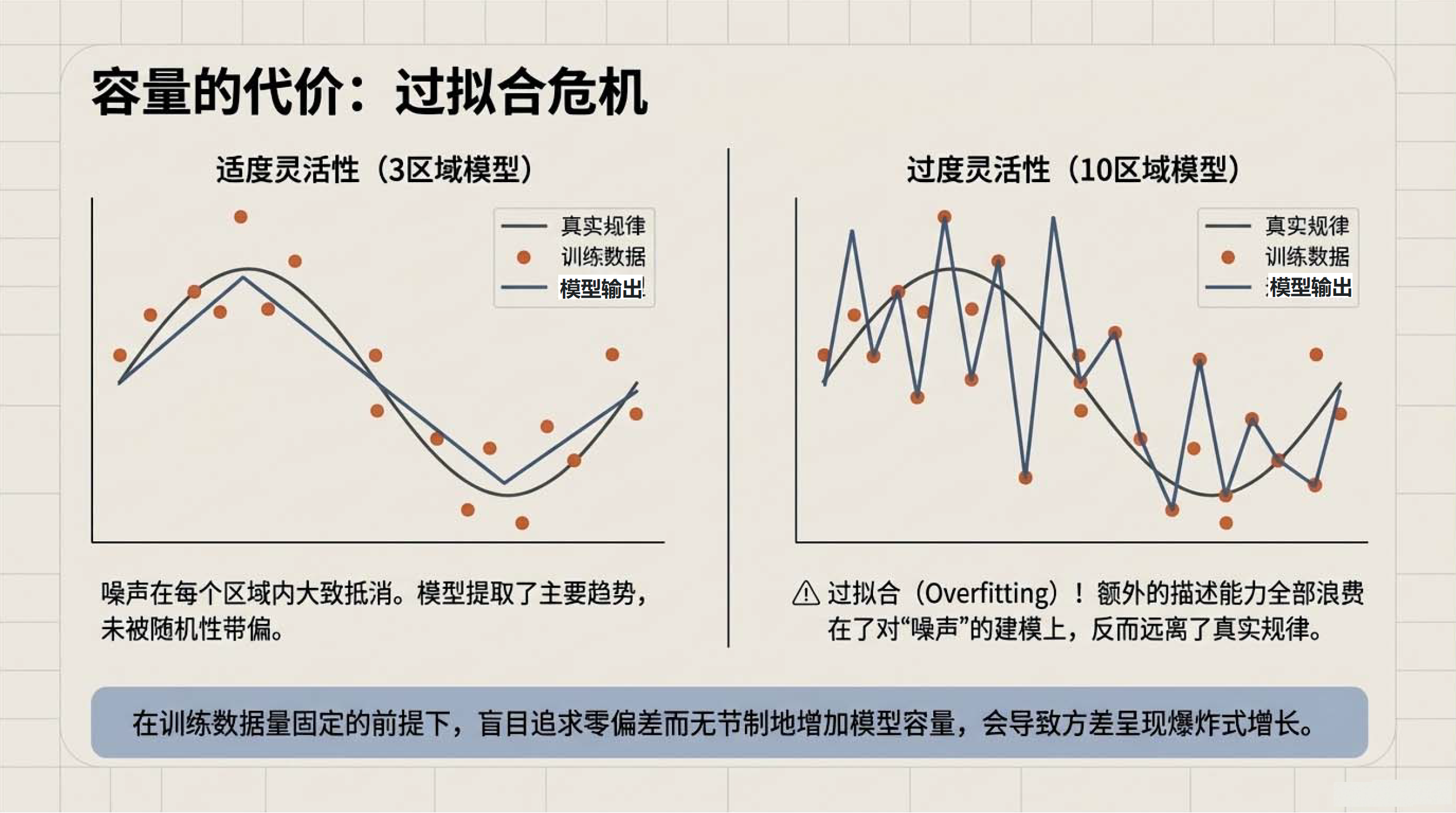

16:39 过拟合危机和偏差方差权衡

19:03 结束语

10

10 0

0