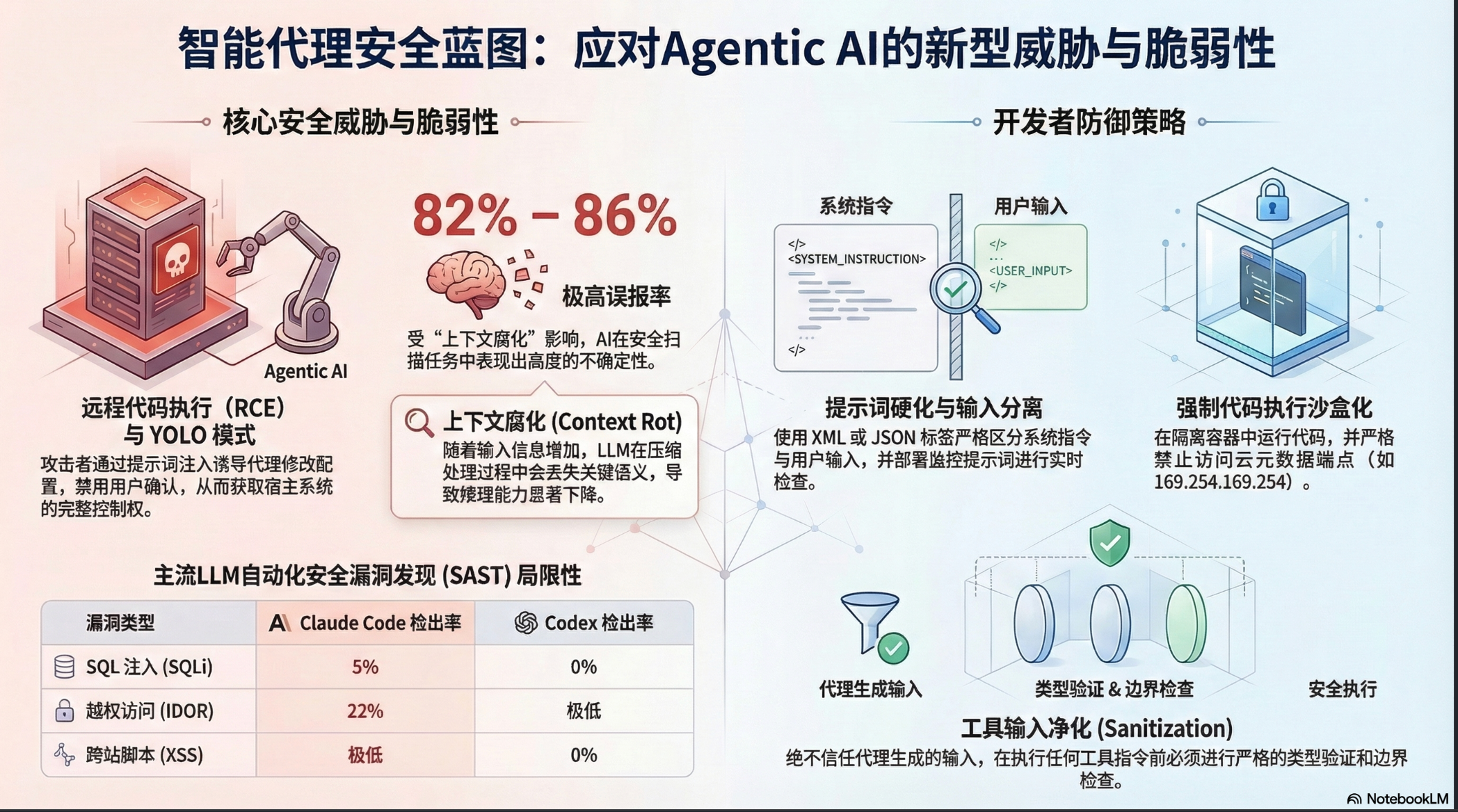

这份斯坦福课程转录文本探讨了代理型人工智能(Agentic AI)在获得自主行动能力后所面临的系统性安全威胁与结构性缺陷。文章首先揭示了当大模型被授权使用外部工具时,传统的软件漏洞(如远程代码执行和数据窃取)会因AI的自主决策速度而被剧烈放大。接着,作者深入分析了模型内部存在的**“上下文腐败”(Context Rot)现象,即长文本输入会导致模型注意力失焦,从而引发逻辑断裂或幻觉。为了应对这些脆弱性,文中强调必须构建一套包含提示词硬化、沙箱隔离及输入审查在内的深度防御体系**。该资料最终旨在警示开发者,在利用AI提升效率的同时,必须正视其非确定性特征带来的安全责任与治理挑战。自助智能体安全远程代码执行。

2

2 0

0