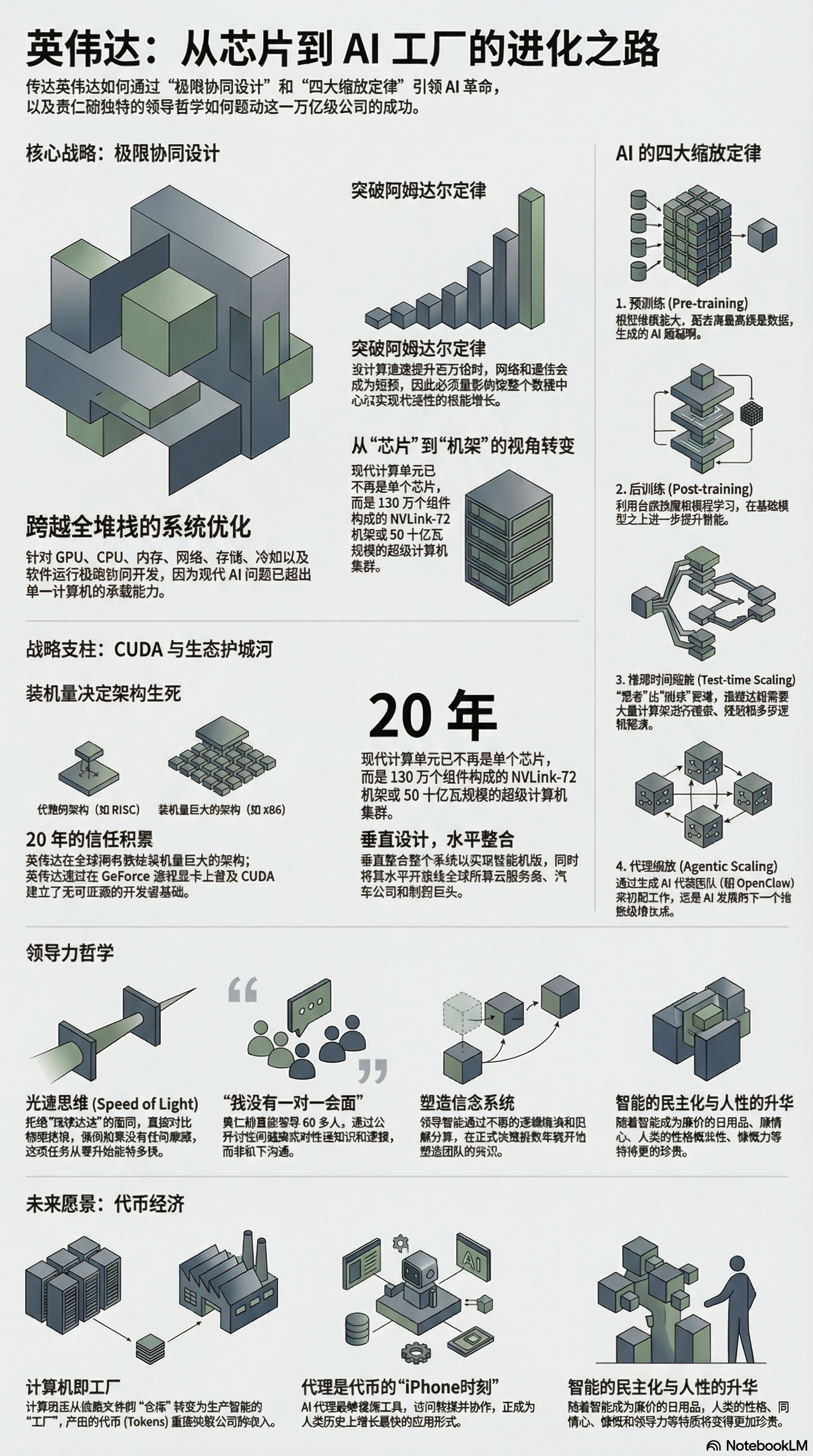

这份文本摘录自 Lex Fridman 对英伟达(NVIDIA)首席执行官黄仁勋的采访,深入探讨了该公司在 AI 革命中的核心角色。黄仁勋解释了英伟达如何从单一的芯片制造转向极端协同设计,通过整合硬件、软件和数据中心架构来超越传统的计算限制。他详细回顾了将 CUDA 引入消费级显卡的豪赌,这一决策虽曾带来财务危机,但最终为现代深度学习奠定了基础。对话还涵盖了 AI 缩放法则的演进,包括合成数据的使用、推理能力的提升以及代理式 AI(Agentic AI)的兴起。此外,黄仁勋分享了其“光速”第一性原理的领导哲学,并讨论了全球供应链、能源效率以及 AI 对未来就业市场的积极重塑。综上所述,这些材料展现了英伟达如何通过前瞻性的工程布局和生态构建,将自身打造为驱动全球智能化的**“AI 工厂”**。

黄仁勋预测的 AI 四大规模定律(Scaling Laws)分别是:

- 预训练扩展定律 (Pre-training scaling law):模型的规模越大,投入的高质量训练数据越多,最终训练出的 AI 就越聪明。

- 后训练扩展定律 (Post-training scaling law):随着 AI 能够结合基础事实(ground truth)生成海量的合成数据,后训练阶段的数据规模将持续扩大。这意味着模型训练不再受限于人类生成的数据量,而是越来越受限于计算能力(Compute),因为未来绝大多数用于训练的数据都将是合成的。

- 测试时扩展定律 (Test time scaling law / 推理扩展):与预训练阶段的“阅读和记忆”不同,推理(Inference)本质上是更复杂的“思考”过程,涉及到推理、分解问题、规划和搜索。因此,测试时阶段的扩展是极其依赖密集计算的。

- 智能体扩展定律 (Agentic scaling law):这被黄仁勋称为“AI的乘法效应”。在测试阶段,具有主体性的 AI(智能体)不仅会去检索数据库、使用工具,还能快速派生出大量的子智能体(sub-agents),从而组建庞大的数字工作团队。

这四个定律并不是孤立的,智能体系统在运行中会创造出大量优质的新数据和新经验,这些数据随后会被输送回预训练阶段进行记忆和泛化,再进入后训练阶段进行微调,从而形成一个不断自我强化的闭环,而推动这一切智能持续扩展的唯一核心就是计算能力 (Compute)。

根据提供的访谈资料,黄仁勋(Jensen Huang)在管理英伟达(NVIDIA)的过程中,展现出了极具独创性的领导哲学,以及对人才培养和未来工作形态的深刻洞察。以下是核心要点:

一、 独特的领导与组织哲学

1. 极致扁平化与“极限协同设计” (Extreme Co-design)黄仁勋拥有大约60名直接下属,但他从不进行传统的一对一会议(One-on-ones)。他的做法是将问题直接抛给整个管理团队,让所有人共同攻克。在讨论如散热、网络或电源分配等具体组件时,所有专家都在场旁听并随时提出跨领域的意见。他认为公司的组织架构不应是千篇一律的层级式,而应服务于公司产出的产品和所处的环境。

2. 潜移默化地塑造团队信念 (Shaping Belief Systems)黄仁勋不赞成传统的“突然宣布重大战略”的领导方式。相反,当他捕捉到新趋势时,他会通过每天与员工、管理层和董事会的持续沟通,一步步向他们分享外部信息、新发现和工程突破,以此来“塑造他们的信念系统”。因此,当他最终宣布重大决策(如全面转向深度学习或收购Mellanox)时,团队往往已经达成了100%的共识,甚至会觉得“你怎么花了这么长时间才决定”。

3. “光速”法则与第一性原理 (Speed of Light & First Principles)黄仁勋推崇一种被称为“光速”的思考方法,即凡事都要从第一性原理出发,思考物理学允许的极限在哪里,并以此作为衡量一切的标准(包括内存速度、成本、制造周期等)。他不喜欢仅仅在现状基础上做“渐进式改进”(continuous improvement),而是要求团队将问题清零,探究在当前条件下从头开始到底能做到多快多好。

4. 系统性遗忘与孩童般的心态 (Systematic Forgetting & Resilience)在面对巨大的压力、不确定性和失败时,黄仁勋的策略是将问题拆解,并迅速与团队分担压力。他强调领导者需要具备**“系统性遗忘”(systematic forgetting)的能力,即迅速放下过去的挫折、尴尬和羞辱,将注意力集中在下一个目标上。同时,他面对巨大挑战时总会抱有一种“这能有多难?”(How hard can it be?)**的孩童般的心态,不去过度预想前路的痛苦,从而保持前进的勇气和韧性。

5. 极度的公开透明与谦逊黄仁勋习惯于在众人面前公开进行推理和思考,他认为这是一种展示谦逊的方式。他向团队展示自己得出结论的每一步逻辑,并允许员工不认同他的推理步骤。这种允许思想碰撞的文化,使得公司能够集思广益,共同寻找最佳路径。

二、 对人才培养与未来工作的看法

1. 最好的继任计划是持续的知识传递黄仁勋明确表示自己不相信传统的“继任计划”(succession planning)。他认为,关心公司未来的最佳方式,是每天尽可能快地将自己的知识、信息、洞察和经验传递给身边的每一个人。他在公司的每一个会议都是“推理会议”,目的是不断赋能员工,提升周围所有人的能力。

2. 区分工作的“目的”与“任务” (Purpose vs. Tasks)面对人工智能带来的失业焦虑,黄仁勋向人才传递了一个关键观念:工作的目的(purpose)和完成工作所使用的任务/工具(tasks/tools)是两回事。例如,软件工程师的任务是写代码,但其目的是解决问题、创新和团队协作。AI可以自动化编程任务(通过自然语言说明生成代码),但不仅不会淘汰工程师,反而会让每一个懂AI的人(无论是木匠、水管工还是会计师)都成为更高级的架构师和问题解决者。

3. 强烈呼吁全面掌握 AI 工具在人才培养和招聘导向上,黄仁勋非常明确:如果要在不懂AI的人和精通使用AI的人之间做选择,他一定会雇佣精通AI的人。他建议所有的大学生和各行各业的专业人士都必须成为使用AI的专家,因为AI能够极大提升个体的生产力和艺术创造力。

4. “智力”将商品化,但“人性”才是超级能力在AI时代,黄仁勋认为“智力”(intelligence)——即感知、理解、推理和规划的系统能力——最终将成为一种可获得的商品。相反,真正的“超能力”(superhuman powers)是属于“人性”(humanity)的特质:品格、同理心、慷慨、承受痛苦的毅力以及决心。他鼓励人们不要因为AI的普及而感到焦虑,因为AI只是工具,而人类独有的精神和人性之美将被进一步彰显和庆祝。

英伟达的**“极致协同设计”(Extreme Co-design)**是其从单一芯片设计向机架级(rack scale)甚至数据中心级系统设计演进的核心战略,也是推动当前AI革命的关键引擎。

为什么需要“极致协同设计”?

随着AI模型规模的指数级增长,计算问题已经无法被塞进一台计算机并由单个GPU来加速。当需要将工作负载分配到成千上万台计算机上以实现百万倍的加速时,单纯提升计算速度是不够的。

根据阿姆达尔定律(Amdahl's Law),如果计算部分只占总工作负载的50%,即使将计算速度提升一百万倍,总工作负载的提升也仅有两倍。此外,由于摩尔定律和登纳德缩放定律(Dennard scaling)已经放缓,单靠芯片工艺升级的红利正在消失。因此,必须对网络、数据分片、流水线拆分等所有干扰效率的环节进行分布式计算的联合攻坚。

极致协同设计涵盖什么?

极致协同设计旨在对整个计算和软件堆栈进行全面优化:

- 硬件架构全方位覆盖: 远超单纯的GPU设计,如今的优化涵盖了GPU、CPU、内存、网络、存储、电源、散热、机架(rack)、计算单元(pod)乃至整个数据中心。

- 软硬件的深度融合: 优化不仅停留在硬件物理层,更横跨了从底层架构到芯片、系统、系统软件,一直到最上层的算法和应用程序。

英伟达是如何实施的?

黄仁勋构建了一套独特的企业运作和工程设计模式来实现这一战略:

- 全局视角的集体攻坚: 黄仁勋拥有60多名直接下属,涵盖了内存、CPU、光学网络、GPU、架构和算法等领域的顶尖专家。他不进行一对一会议,而是将问题抛给整个管理团队共同解决。在讨论诸如“散热”这类具体问题时,负责电源或内存的专家也会旁听并提出意见,确保任何单点设计都能完美契合整个系统的复杂需求。

- 基于“光速”(Speed of Light)的第一性原理: 在工程设计中,英伟达的每一个环节都会与“光速”(代表物理学能达到的极限)进行对比测试,包括内存速度、计算能力、功耗和成本等。在明确了系统追求高吞吐量或低延迟的物理极限后,团队从全局出发做出合理的妥协和权衡,确保系统不仅复杂,还能兼顾“尽可能简单”的原则。

- 前瞻性预测与软硬协同适配: AI算法大约每六个月就会发生一次重大变革,而硬件系统的开发周期长达三年。英伟达通过与全球顶尖AI实验室合作,预判未来两三年的技术走向。例如,为了应对“混合专家模型(MoE)”的大规模推理需求,他们设计了将整个计算域无缝连接的NVLink 72架构;而为了迎接未来“AI智能体(Agents)”高频调用工具的需求,他们又迅速推出了内置存储加速器和Vera CPU的Vera Rubin机架。

极致协同设计如何推动AI革命?

- 实现算力的百万倍跨越: 在过去十年中,如果仅遵循摩尔定律,计算能力大概只能提升100倍。而通过极致协同设计,英伟达成功将计算规模和性能提升了100万倍。

- 突破能耗瓶颈,大幅降低AI使用成本: 生成式AI推理阶段(让AI思考和推理)需要极其密集的计算,能耗是主要制约因素。极致协同设计每年能够将“每瓦每秒生成的Token数量”(tokens per second per watt)提升数个数量级。这使得尽管超级计算机的造价在上升,但生成Token的单价却以每年十倍的速度在暴降。

- 催生“AI工厂”时代的到来: 协同设计使得英伟达创造出了世界上最复杂的计算机系统(例如单个Vera Rubin pod就包含1200万亿个晶体管和60 EFLOPS算力)。这直接推动了计算机的本质发生转变:从过去基于检索的“数据仓库”,演变为能够实时生成高价值智能(Tokens)的“AI工厂”,彻底改变了千行百业的生产力模式。

在英伟达的工程哲学中,“光速”(Speed of Light)原则不仅是一个口号,而是一种自三十年前沿用至今的思维方式和系统设计方法论。黄仁勋通过以下几个核心层面,利用这一原则来推动“极致协同设计”和系统优化:

1. 重新定义“光速”:将物理极限作为唯一标尺在英伟达,“光速”并不单指速度,它是黄仁勋用来指代**“物理学允许的极限”(physical limits)**的代名词。基于第一性原理,英伟达的团队在开展任何工作之前,都会强制要求自己思考事物的物理极限在哪里。他们会将方方面面的指标与这个“光速”进行对比测试,这不仅包括内存速度、计算速度和功耗,甚至还延伸到了成本、时间、研发精力、所需人员数量以及制造周期等运营指标。

2. 探究单点极限,再做全局妥协系统设计往往充满了矛盾与取舍,例如一个追求极低延迟的系统和一个追求极高吞吐量的系统,其底层架构是截然不同的。英伟达的做法是:首先分别找出实现高吞吐量和低延迟各自对应的“光速”(理论极限)在哪里,随后在考虑整个系统时,基于这些极限做出明智的妥协和权衡。

3. 摒弃“渐进式改进”,要求问题清零黄仁勋明确表示,他不喜欢传统的“持续改进”(continuous improvement)模式。例如,如果当前完成一项任务需要74天,传统的做法可能是努力将其缩短到72天。而在“光速”原则下,他要求团队将问题清零,回到第一性原理思考:如果完全从头开始构建,物理学允许的最短时间是多少?

0

0 0

0