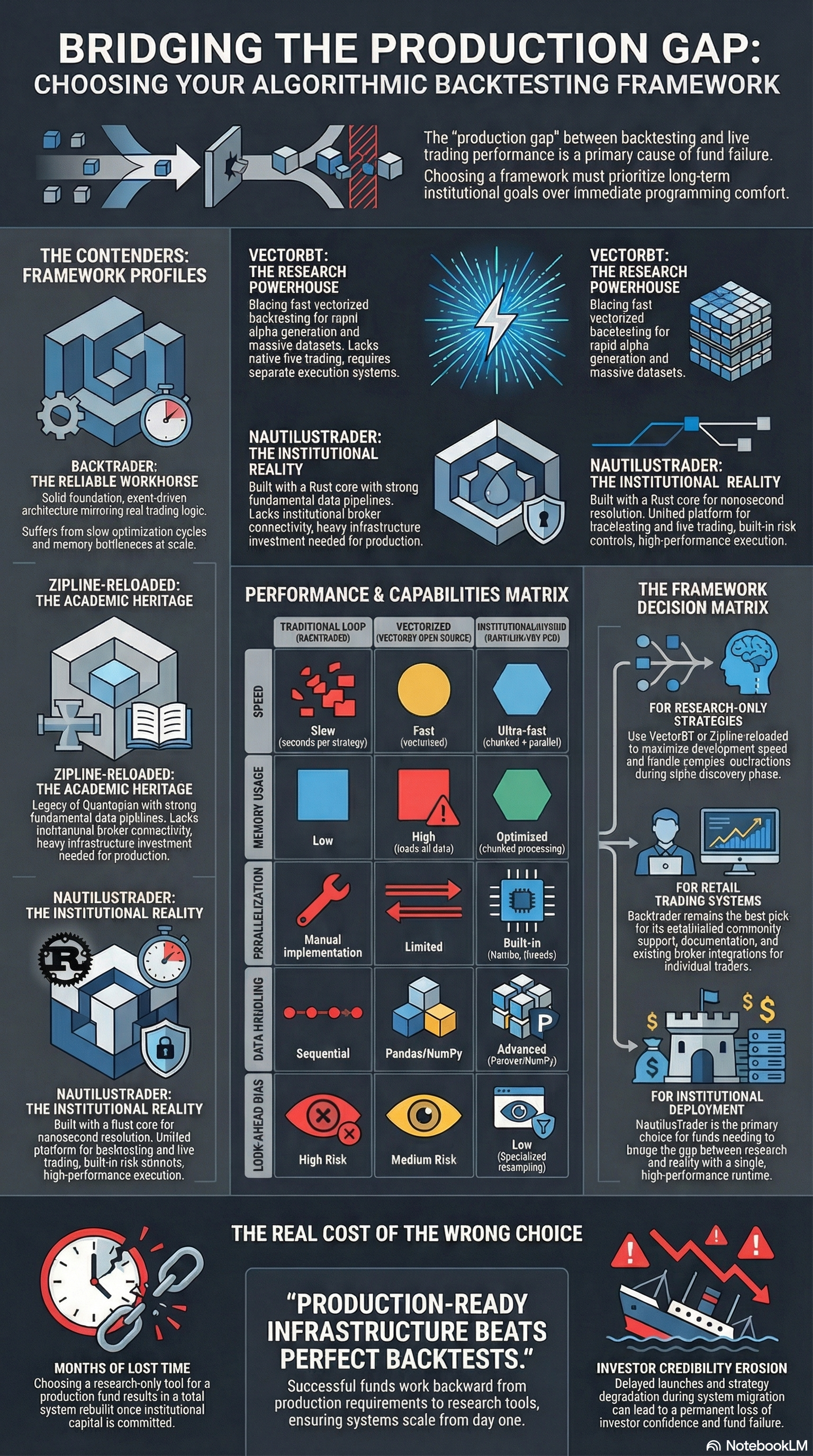

这些资源共同构成了量化交易框架与机器学习策略的综合指南,涵盖了从理论研究到实盘部署的全过程。文中对比了 Backtrader、VectorBT 和 NautilusTrader 等主流回测引擎,分析了它们在执行速度、事件驱动逻辑及机构级性能方面的优劣。通过对 Zipline 与 Backtesting.py 的实例分析,探讨了回测中常见的幸存者偏差、未来函数以及佣金设置对结果一致性的影响。此外,相关书籍摘录详细介绍了如何利用 Python 进行特征工程、情绪分析及深度学习建模,以挖掘市场Alpha信号。针对资金管理,素材还讨论了投资组合优化与风险控制在弥合模拟回测与真实交易差距中的关键作用。总之,这些资料旨在帮助交易者构建高效、稳定且具备生产力的自动化交易系统。

Backtrader

- 优点:成熟可靠且社区庞大:作为一个久经考验的成熟框架,它拥有详尽的文档和庞大的社区支持,遇到问题很容易在网上找到解决方案。

真实的事件驱动架构:其逻辑设计能够真实反映实际交易过程中的事件驱动逻辑。

券商集成度高:提供良好的零售和机构级平台集成,支持对接如 Interactive Brokers 等平台进行实盘交易。

灵活性极佳:允许用户自定义交易逻辑,且能够轻松接入CSV、Pandas DataFrame以及Yahoo Finance等多种在线和离线数据源。 - 缺点:性能与速度瓶颈:纯Python架构导致复杂策略的执行性能受限;单线程机制在进行繁重计算时容易产生瓶颈,尤其在面对大规模历史数据和庞大参数空间的优化时,速度会变得极其缓慢且内存占用飙升。

项目已停滞:该框架自2019年中期后就不再积极更新和添加新功能,且部分用户反馈在重采样(resampling)等功能上存在Bug。

NautilusTrader

- 优点:机构级高性能:核心组件基于Rust语言(结合Cython)编写,提供纳秒级的时间精度和极低的延迟,不仅优化速度远超传统Python框架,还能够应对高频交易(HFT)级别的数据处理需求。

回测与实盘无缝衔接:在统一平台内原生支持回测和实盘交易。它的核心系统在模拟和实盘环境中完全一致(Research-to-live parity),直接消除了回测到生产环境间经常导致基金失败的“实现鸿沟”。

功能极其完备:具备实时订单管理、跨交易所多资产交易能力,并内置了风控和仓位管理系统。 - 缺点:学习曲线极其陡峭:其架构设计(包含时钟、缓存、消息总线等)和API远比传统的测试框架复杂。要构建一个最基础的策略,也需要编写大量繁杂的样板代码(boilerplate code)。

社区相对较小:相比于面向个人开发者的主流工具,其应用更偏向机构,目前的社区规模偏小,且文档示例仍需完善。

回测结果和实盘交易之间常存在“生产差距”(Production Gap),即在策略验证阶段表现完美的模型,往往在真实市场条件下会走向崩溃。这种差距主要由数据使用偏差、交易模拟的非现实假设、过度拟合风险以及底层基础设施的脱节等几个核心原因造成:

一、 数据层面的偏差 (Data Biases)

- 前瞻偏差(Look-ahead bias): 回测中使用了在实际交易时刻尚未公布或不可用的未来信息。例如,未考虑财务报表发布后的数据修正、股票拆分,或错误地对齐了时间戳。如果机器学习算法在这些失真的历史数据上进行训练,在实盘交易中几乎注定会失败。此外,某些向量化回测工具假设事件都发生在K线的开盘时刻,这也会人为地夸大策略表现。

- 幸存者偏差(Survivorship bias): 如果回测历史数据集仅包含目前仍在活跃交易的证券,而排除了那些随着时间推移因破产、退市或被收购而消失的资产,会使回测结果产生严重的向好偏斜。

- 样本期缺乏代表性(Sample period mismatch): 历史样本数据如果未能真实反映当前或未来相关的市场环境(例如波动率或交易量状态),或者缺乏真实的极端历史事件,回测结果就无法泛化到未来的实盘中。

二、 模拟与实盘交易环境的差异 (Simulation & Execution Discrepancies)

- 决策与执行的时序错位: 模拟系统常常对接收信号和交易时间做出不切实际的假设。例如,策略可能基于当前的收盘价计算出交易信号,但在实盘中实际上只能以下一个交易日的开盘价去执行,这两个价格之间往往差异巨大。此外,不同的回测框架对交易触发的默认逻辑不同(例如在信号出现后的下一根K线开盘执行,还是假设以当前K线价格执行),这会造成极大的执行偏差。

- 低估交易成本与滑点(Slippage): 真实市场并不允许在所有时间点都能以目标价格执行所有交易。回测如果低估了经纪商佣金、忽略了缺乏对手盘情况下的做空限制,或者没有充分考虑大宗交易/低流动性资产带来的市场冲击(滑点),实盘利润将被大幅侵蚀。

三、 过度拟合与统计幻觉 (Overfitting & Statistical Illusions)

- 多重测试导致的过度拟合: 在同一套历史数据集上反复进行测试以挑选最佳策略,极易导致发现“虚假的模式”(Spurious patterns)。这种由于数据挖掘和多重测试带来的结果,仅仅是对测试样本的过度拟合,产生了具有欺骗性的积极业绩,但根本无法在实盘遇到新数据时泛化。

四、 基础设施与实施鸿沟 (Infrastructure & Implementation Gaps)

- 系统分离与扩展性瓶颈: 许多基金在研究和实盘操作阶段使用不同的系统框架,这导致了严重的实施鸿沟。一个完美的理论回测模型在转化为实盘系统时,可能会面临多代码、部分平仓等复杂的系统层面挑战。如果基础设施不具备扩展性,或者无法与机构经纪商顺利集成,实盘交易时就会在系统负载下出现性能瓶颈,甚至需要耗费数月时间重建生产系统,从而导致资金损失和策略失效。因此,使用统一的回测和实盘交易执行框架是消除这种实施差距的关键。

利用机器学习(ML)和替代数据来开发量化交易策略,需要遵循一个被称为ML4T(Machine Learning for Trading)的系统性工作流。这个工作流涵盖了从数据获取、特征工程、模型训练到策略回测和执行的完整生命周期。

以下是开发量化交易策略的核心步骤与方法:

1. 寻找和评估替代数据 (Alternative Data)

随着数字化发展,替代数据已成为获取市场信息优势(Alpha信号)的关键来源。替代数据主要分为三大类:

- 个人产生的数据: 包括社交媒体(如Twitter、StockTwits)的情绪数据、搜索引擎历史、应用下载量和电商评论等。

- 业务流程数据: 例如信用卡交易记录、企业废气排放数据或供应链订单数据。

- 传感器数据: 包括用于监测农业产量、矿产或油轮活动的卫星图像,以及用于跟踪零售客流的地理位置数据(GPS)。

评估标准: 并非所有替代数据都有价值。在引入数据时,需要评估其信号质量(是否包含未被市场消化的Alpha)、排他性、数据的历史长度以及相关的法律和声誉风险(例如是否包含内幕信息或个人隐私)。

2. 金融特征工程与 Alpha 因子提取

算法无法直接理解原始数据,必须通过特征工程将数据转化为能够预测价格波动的信号(Alpha因子)。

- 传统量化因子: 可以利用TA-Lib、NumPy和pandas等工具,构建动量(Momentum)、价值(Value)、波动率(Volatility)和质量(Quality)等金融特征。

- 自然语言处理 (NLP): 针对文本类替代数据(如SEC文件、财报电话会议记录、新闻和社交媒体),需要将非结构化文本转换为数值特征。可以使用词袋模型(BOW)、主题建模(Topic Modeling)来提取潜在主题。更先进的方法是使用词嵌入(Word Embeddings,如Word2Vec、Doc2Vec),通过捕捉词语的上下文语义来预测收益惊喜或进行情绪分析。

3. 应用机器学习模型寻找交易信号

量化策略可以利用多种机器学习算法,从提取风险因子到预测收益方向:

- 监督学习 (Supervised Learning): 目标是根据历史特征预测未来的绝对收益或价格变动方向。常用模型包括随机森林(Random Forests)和梯度提升树(Gradient Boosting,如LightGBM、XGBoost、CatBoost),它们在处理表格数据和捕捉非线性关系方面表现优异。对于时间序列或图像数据,卷积神经网络 (CNN) 和 循环神经网络 (RNN/LSTM) 可以提取高维数据中的深层特征,甚至能将时间序列转换为二维网格以图像形式进行预测。

- 无监督学习 (Unsupervised Learning): 适用于未标记的数据。可以使用主成分分析(PCA)或独立成分分析(ICA)进行降维并提取数据驱动的潜在风险因子。自编码器 (Autoencoders) 也可以用于学习复杂的非线性资产特征。在资产配置阶段,可以使用层次聚类 (Hierarchical Clustering) 构建分层风险平价(HRP)投资组合,优化风险回报。

- 强化学习 (Reinforcement Learning): 极其适合交易场景,它模拟交易员在市场环境中的交互。可以通过OpenAI Gym等环境,训练智能体(Agent)使用 Q-learning 或深度 Q 网络(DDQN)不断试错,学习在复杂且连续的市场状态下执行最优的买卖动作以最大化长期回报。

- 生成对抗网络 (GANs): 为了解决金融历史数据有限且容易导致“回测过拟合”的问题,可以使用 TimeGAN 等模型生成逼真的合成金融时间序列数据,用于扩充训练集或进行策略测试。

4. 策略回测与投资组合优化

在将资金投入实盘前,必须在历史数据上通过回测引擎对策略进行严格的模拟与验证。

- 框架选择: 选择回测框架应基于你的最终目标。Backtrader 是可靠的基础工具,适合开发和验证策略,但速度在优化时是瓶颈;VectorBT 是极速的向量化研究引擎,但缺乏原生实盘交易能力;Zipline 具有深厚的学术背景,适合学术研究与复杂数据管道;而 NautilusTrader 则专为需要极速参数优化和机构级生产环境的基金而建。

- 避开回测陷阱: 实施回测时必须使用**时间点数据(Point-In-Time Data)**以避免“预见性偏差(Look-ahead bias)”;同时,数据样本必须包含已退市的资产以避免“幸存者偏差(Survivorship bias)”;最后,需要警惕回测过拟合(即单纯的数据挖掘造成的虚假信号)。

- 投资组合执行: 获取模型信号后,策略需要解决仓位规模的分配问题,使用均值-方差优化(Mean-Variance Optimization)、凯利公式(Kelly Criterion)或前文提到的机器学习层次风险平价算法来对投资组合进行风险管理和优化。

NautilusTrader 的 Rust 核心为高频交易(HFT)带来了机构级的性能提升,主要体现在以下几个关键方面:

- 纳秒级的时间精度:其底层拥有确定性的事件驱动核心,支持纳秒级(nanosecond)的时间分辨率。无论是在回测模拟还是实盘交易环境中,它都能提供一致且极其精确的计时器和警报,这对于对时间极其敏感的高频交易至关重要。

- 极低的执行延迟与内存安全:通过使用 Rust(以及 Cython)编写核心组件,NautilusTrader 克服了纯 Python 架构的性能瓶颈,不仅保证了系统的内存安全,还提供了捕捉稍纵即逝的交易机会所需的高性能和低延迟执行能力。

- 超高的数据吞吐量:在处理高频交易产生的大量数据时,该框架能够以每秒高达 500 万行的速度传输数据,并且能够高效处理超出可用内存(RAM)容量的海量历史和实时数据。它可以轻松应对从逐笔报价(ticks)到 K 线(bars)的各种极端数据负载。

- 满足高频时间框架的需求:社区用户指出,其底层架构提供的速度优势非常适合处理“类似高频交易时间框架的数据”(HFT-like timeframe data)。即使是目前只进行日内交易的用户,也认为其速度优势能够为未来涉足高频交易领域“敞开大门”。

2

2 0

0