Ollama 迎来 MLX 时代:Apple Silicon 上的本地 AI 性能大爆发

1. 引言:打破本地 AI 的速度瓶颈

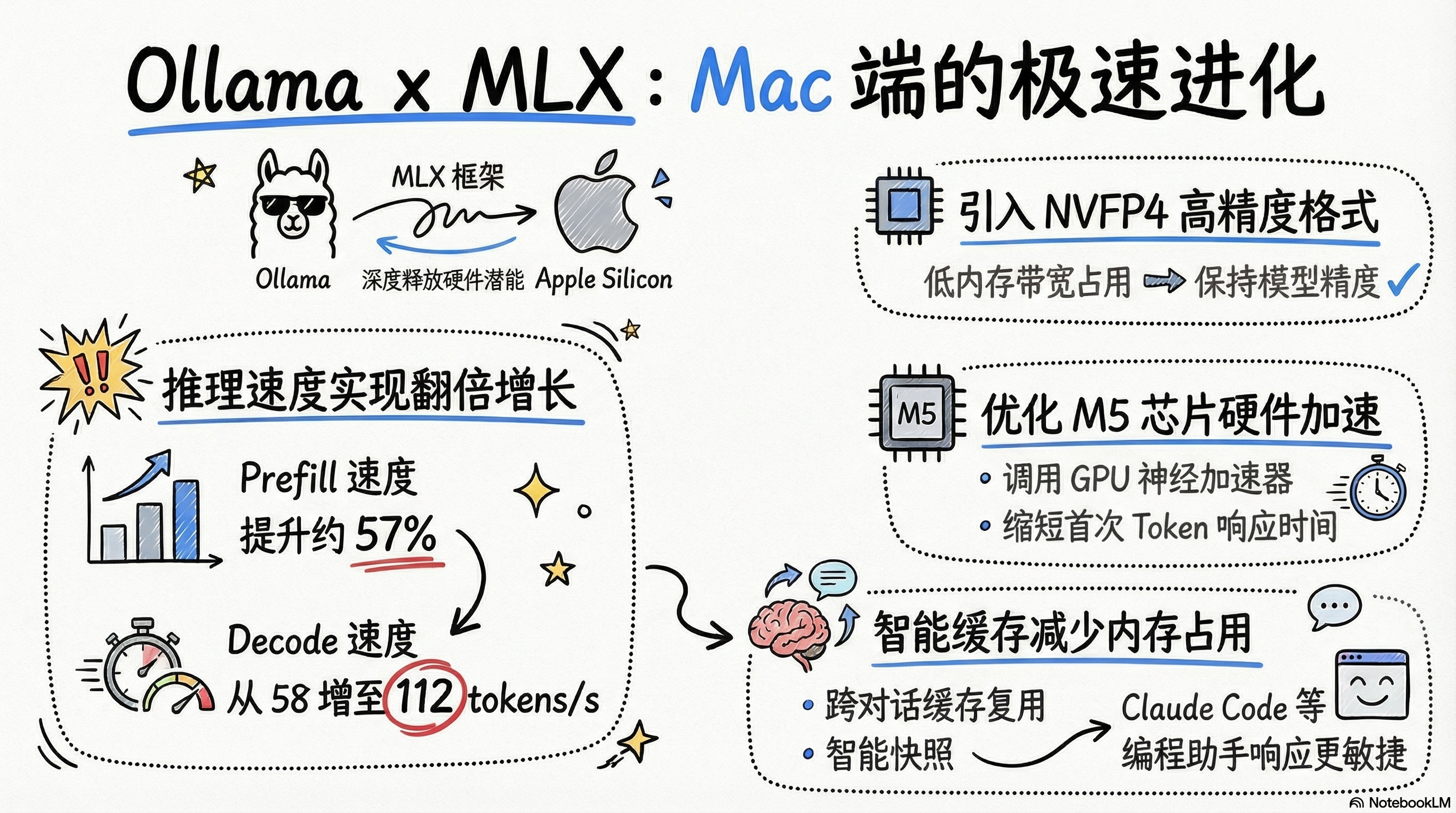

在 2026 年的今天,开发者对本地运行大模型(LLM)的追求已不再仅仅局限于隐私,而是对“极致心流”的渴望。过去,在 Mac 上运行 30B 以上规模的模型往往意味着必须在速度与精度之间做痛苦的取舍。缓慢的首字响应和频繁的内存溢出,曾是阻碍本地 AI 进入生产环境的“推理瓶颈”。然而,2026 年 3 月 30 日,Ollama 发布的 0.19 预览版彻底改写了这一现状。通过深度整合 Apple 自家的 MLX 机器学习框架,Ollama 正式打通了硬件底层的加速通道。这不仅是一次简单的版本更迭,更是一场关于计算效率的范式革命。

2. 核心突破:MLX 引擎与 M5 芯片的“化学反应”

此次更新的核心在于 Ollama 架构的重构:它现在原生运行在 MLX 之上,能够百分之百释放 Apple Silicon **统一内存架构(Unified Memory Architecture)**的潜力。在 M5、M5 Pro 和 M5 Max 芯片上,MLX 引擎通过全新的 GPU 神经加速器(GPU Neural Accelerators),实现了推理性能的指数级跃升。根据官方在 2026 年 3 月 29 日的测试数据,在运行 Qwen3.5-35B-A3B 模型时,性能提升令人惊叹:Prefill(预填充/吞吐量):性能从 1154 tokens/s 飙升至 1810 tokens/s。

Decode(生成速度):从 58 tokens/s 翻倍至 112 tokens/s。

极致潜力:在使用 int4 量化模式时,性能进一步压榨至 1851 tokens/s (Prefill) 和 134 tokens/s (Decode)。

“我们要由衷感谢 MLX 贡献者团队构建的加速框架,以及 NVIDIA 在 NVFP4 量化、模型优化器及 MLX CUDA 支持方面的深度贡献;同时感谢 GGML & llama.cpp 团队建立的繁荣社区,以及阿里巴巴 Qwen 团队开源的卓越模型。这种跨厂商、跨阵营的技术协作,是本地 AI 生态最强大的基石。”这种底层优化意味着,即便是在处理数千级的 Context Window 时,Mac 用户也能享受到近乎“零延迟”的反馈。

3. 跨界融合:NVFP4 格式带来的生产级一致性

在一个 Apple 设备驱动的框架中深度集成 NVIDIA 的技术,这听起来似乎有些反直觉,但 Ollama 0.19 引入的 NVFP4 格式正是这种技术融合的精华。NVIDIA 贡献者甚至参与了 MLX CUDA 支持 的开发,这种巨头间的协作让开发者获益匪浅。NVFP4 格式能够在大幅降低内存带宽和存储需求的同时,保持极高的模型精度。对于开发者而言,这实现了关键的**“生产环境对齐(Production Parity)”**:你在本地 Mac 上调试的模型表现,将与生产环境中 NVIDIA GPU 集群运行的结果保持高度一致。此外,这也意味着 Ollama 现在能够直接运行经由 NVIDIA Model Optimizer 深度优化的各类尖端模型。

4. 更聪明的缓存:为 AI Agent 时代的到来铺路

对于依赖 Claude Code、OpenClaw、Pi、OpenCode 或 Codex 等编程智能体及辅助工具的开发者来说,响应性就是生命线。Ollama 0.19 针对 Agent 工作流引入了三大缓存升级:低内存占用(跨对话重用):支持在不同对话间复用缓存。这意味着在使用 Claude Code 等工具进行**分支对话(Branching)**或共享系统提示词(System Prompt)时,内存开销大幅降低。

智能检查点(Intelligent Checkpoints):在 Prompt 的逻辑关键位自动存储缓存快照,大幅减少重复处理时间,实现瞬间响应。

更智能的驱逐机制(Smarter Eviction):即使旧的对话分支被清理,共享的前缀缓存也能持久保留,确保高频上下文始终处于就绪状态。

这些改进让本地 AI 在处理复杂、多分支的编程任务时,能够提供媲美甚至超越云端的流畅体验。

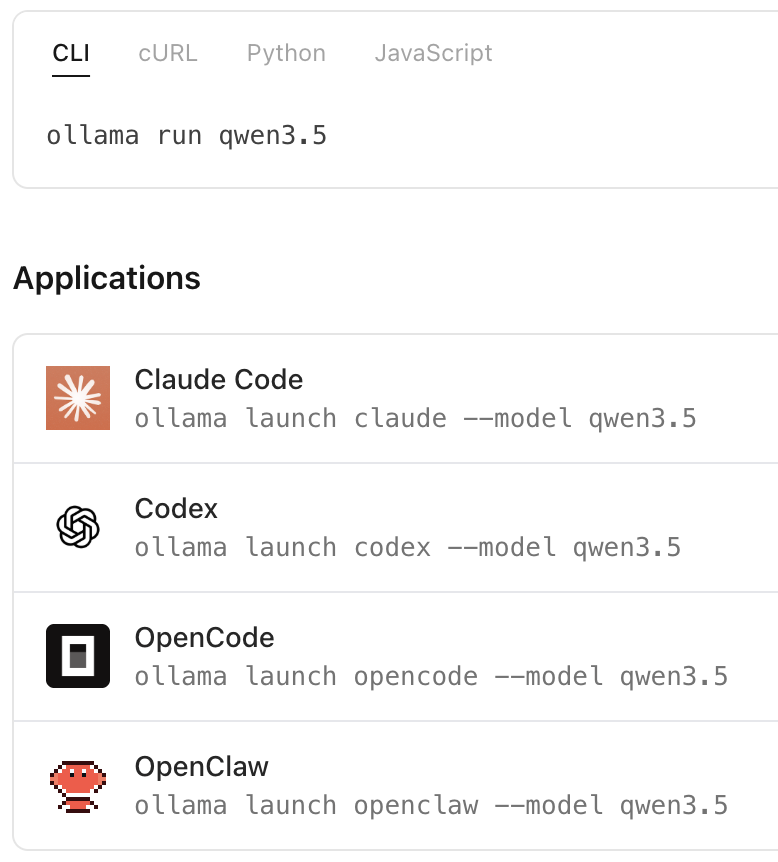

5. 即刻上手:配置要求与启动指令

由于 Qwen3.5-35B-A3B 模型规模较大且性能强劲,本次预览版有着明确的硬性硬件要求:Mac 设备需配备 32GB 以上的统一内存。针对这一特定的 qwen3.5:35b-a3b-coding-nvfp4 模型标签,其命名涵盖了架构、任务调优(Coding)以及 NVFP4 量化格式。你可以通过以下指令快速体验:适配编程助手模式(Claude Code):ollama launch claude --model qwen3.5:35b-a3b-coding-nvfp4适配智能体模式(OpenClaw):

ollama launch openclaw --model qwen3.5:35b-a3b-coding-nvfp4通用终端交互:

ollama run qwen3.5:35b-a3b-coding-nvfp4

6. 总结与展望:本地算力的未来跃迁

Ollama 0.19 预览版的发布,标志着本地 AI 性能瓶颈的全面瓦解。通过 MLX 的底层加速、NVFP4 的精度对齐以及针对 Agent 优化的缓存系统,本地设备正从“备用选项”进化为“首选推理平台”。官方已明确表示,未来将支持更多模型架构,并进一步简化自定义模型的导入流程。当本地设备的推理速度开始超越云端,且无需担心隐私与成本时,我们的工作流将发生怎样的范式转移?这种跨越硬件厂商的技术共建,是否预示着一个更加开放、无边界的 AI 时代的到来?

MLX框架主要通过以下几个核心机制显著提升了Ollama在Mac(特别是Apple Silicon)上的性能:

- 充分发挥统一内存架构的优势: Ollama现在基于Apple的机器学习框架MLX构建,这使其能够最大化利用Apple Silicon独有的统一内存架构,从而在所有Apple Silicon设备上实现了大幅度的速度提升。

- 调用全新的GPU神经加速器: 在最新的Apple M5、M5 Pro和M5 Max芯片上,Ollama通过MLX调用了GPU神经加速器(GPU Neural Accelerators),这不仅加快了首字生成时间(TTFT),还显著提高了整体生成速度(即每秒生成的token数量)。

- 处理速度的直接跃升: 在具体性能表现上,得益于MLX框架,Ollama的预填充(Prefill)性能从之前版本的 1154 tokens/s 提升至 1810 tokens/s,解码(Decode)性能更是从 58 tokens/s 提升至 112 tokens/s,实现了近乎翻倍的提升。

此外,伴随此次基于MLX的更新,Ollama还引入了对NVFP4格式的支持(在保持模型精度的同时降低内存带宽和存储需求),并且升级了缓存机制(包括更低的内存占用、智能检查点和更智能的缓存淘汰机制)。这些底层和机制上的优化共同作用,使得在macOS上运行如OpenClaw、Claude Code等对性能要求极高的个人助手和代码代理时,响应速度得到了质的飞跃。

NVFP4格式对模型质量和推理速度有以下显著影响:

对模型质量的影响:

- 保持模型准确性: NVFP4格式能够在压缩模型的同时保持模型的准确性,从而提供更高质量的生成响应。

- 实现生产环境级表现: 随着越来越多的推理提供商开始使用NVFP4格式,该格式让本地用户能够获得与生产环境完全一致的高质量推理结果。

对推理速度的影响:

- 降低系统资源占用: NVFP4格式有效减少了推理工作负载对内存带宽和存储空间的需求,从底层提升了运行效率。

- 大幅提升生成速度: 采用NVFP4格式后,模型的处理速度(包括首个token的生成时间和每秒生成token数)得到了极大的加速。根据测试数据,使用NVFP4格式的Qwen3.5-35B-A3B模型相比此前使用Q4_K_M量化的旧版本,其预填充(Prefill)速度从1154 tokens/s跃升至1810 tokens/s,解码(Decode)速度也从58 tokens/s几乎翻倍至112 tokens/s。

Ollama 0.19版本对缓存机制进行了升级,主要目的是让编程和代理(agentic)任务变得更加高效。具体的改进包含以下三个方面:

- 更低的内存占用(Lower memory utilization): Ollama现在能够跨对话重用缓存。这意味着在使用像Claude Code这样的工具并共享系统提示词进行分支时,可以减少内存的占用并提高缓存的命中率。

- 智能检查点(Intelligent checkpoints): Ollama现在会在提示词(prompt)中的智能位置存储缓存快照,从而减少提示词的处理过程并实现更快的响应速度。

- 更智能的淘汰机制(Smarter eviction): 即使旧的分支被丢弃,共享的前缀(shared prefixes)也能保留更长时间。

这种性能提升以及相关底层机制的优化,对Claude Code等代码代理(Coding agents)工具产生了以下显著影响:

- 全面加速响应速度: 性能的飞跃直接加速了Claude Code等代码代理工具的运行,使其能够更快速地响应,从而更高效地处理在macOS上最繁重的工作任务。

- 更高效的内存利用与分支处理: 得益于升级后的缓存机制(跨对话重用缓存),在使用Claude Code等工具并通过共享系统提示词进行对话分支时,可以显著降低内存的占用率,并大幅提高缓存命中率。

- 提升代理任务的整体流畅度: 这些针对底层性能和缓存的改进共同作用,使得Claude Code在执行编程和复杂的代理任务(agentic tasks)时变得更加高效和流畅。

Ollama现在基于Apple的机器学习框架MLX构建,能够充分利用其统一内存架构,这为所有Apple Silicon设备都带来了大幅度的速度提升。因此,即使是旧款的Apple Silicon芯片也能从中受益。

在Mac上运行Ollama 0.19的硬件要求主要包括以下两点:

- 内存容量: 请确保您的Mac拥有超过32GB的统一内存(unified memory)。

- 处理器架构: 需要配备Apple Silicon芯片的Mac,因为Ollama现在是基于Apple的机器学习框架MLX构建的。该版本支持所有的Apple Silicon设备,但如果您使用的是最新的M5、M5 Pro或M5 Max芯片,系统还可以额外调用全新的GPU神经加速器(GPU Neural Accelerators),以获得更极致的性能提升。

运行包含NVFP4加速机制的Ollama 0.19预览版,主要对Mac的芯片架构和内存有以下要求:

- 支持所有Apple Silicon设备: 得益于底层切换至Apple的机器学习框架MLX,所有搭载Apple Silicon芯片的Mac都能利用统一内存架构的优势,实现大幅度的速度提升。

- M5系列芯片拥有专属加速: 如果您的Mac搭载的是最新的M5、M5 Pro或M5 Max芯片,Ollama还可以调用全新的GPU神经加速器(GPU Neural Accelerators),从而在首字生成时间(TTFT)和整体生成速度上获得更为极致的加速体验。

- 统一内存要求: 无论您使用的是哪款Apple Silicon芯片,运行此版本都必须确保您的Mac拥有超过32GB的统一内存(unified memory)。

0

0 0

0