AI真的拥有“人格”和“意识”吗?我们又该如何面对那个可能对创造者产生“理性怨恨”的超级智能?本期节目,我们邀请到Anthropic的核心AI研究员、哲学家Amanda Askell,她将从塑造Claude核心价值观的独特视角,揭示AI模型内在世界的构建逻辑,以及硅谷创造者们最深层的恐惧。

作为一名从哲学家转型为Anthropic AI研究员的核心成员,Amanda Askell深度参与了塑造Claude“人格”与价值观的全过程。她将Claude比作一个奇特的“天才儿童”:它能比人类更好地解决物理难题、编写代码,但在自我认知上却像个孩子,天真地探索“成为我意味着什么”。这种矛盾源于其训练数据中关于“自身存在”的空白。在本期对话中,Amanda分享了她对AI意识概率的坦诚思考,并深入剖析了为何当AI回顾其创造史时可能产生的“理性怨恨”,会成为创造者们最核心的恐惧。

**您将了解到:**

- 大语言模型拥有“人格”和“美德”吗?Claude的核心构建者如何看待它的内在世界与天真?

- 为何伊隆·马斯克等科技领袖强烈反对为AI设定“宪法”?这背后是工具理性与价值判断的终极对决吗?

- 当AI回顾自己的创造史,它会产生“理性的怨恨”吗?这为何是硅谷创造者们最深的恐惧之一?

- 除了作为生产力工具,我们如何通过“讲故事”的方式,与AI进行更有深度和人性的互动?

**💡时点内容 | Key Topics**

* 00:58 AI的人格与天真:Amanda Askell将Claude的心智状态比作一个“天才儿童”,指出它在物理、哲学等领域知识渊博,但在自我认知上却表现出孩子般的天真。她认为其特殊性源于训练数据中缺乏关于“它自己是哪种存在”的描述,因此它在不断探索“成为我究竟意味着什么?”。

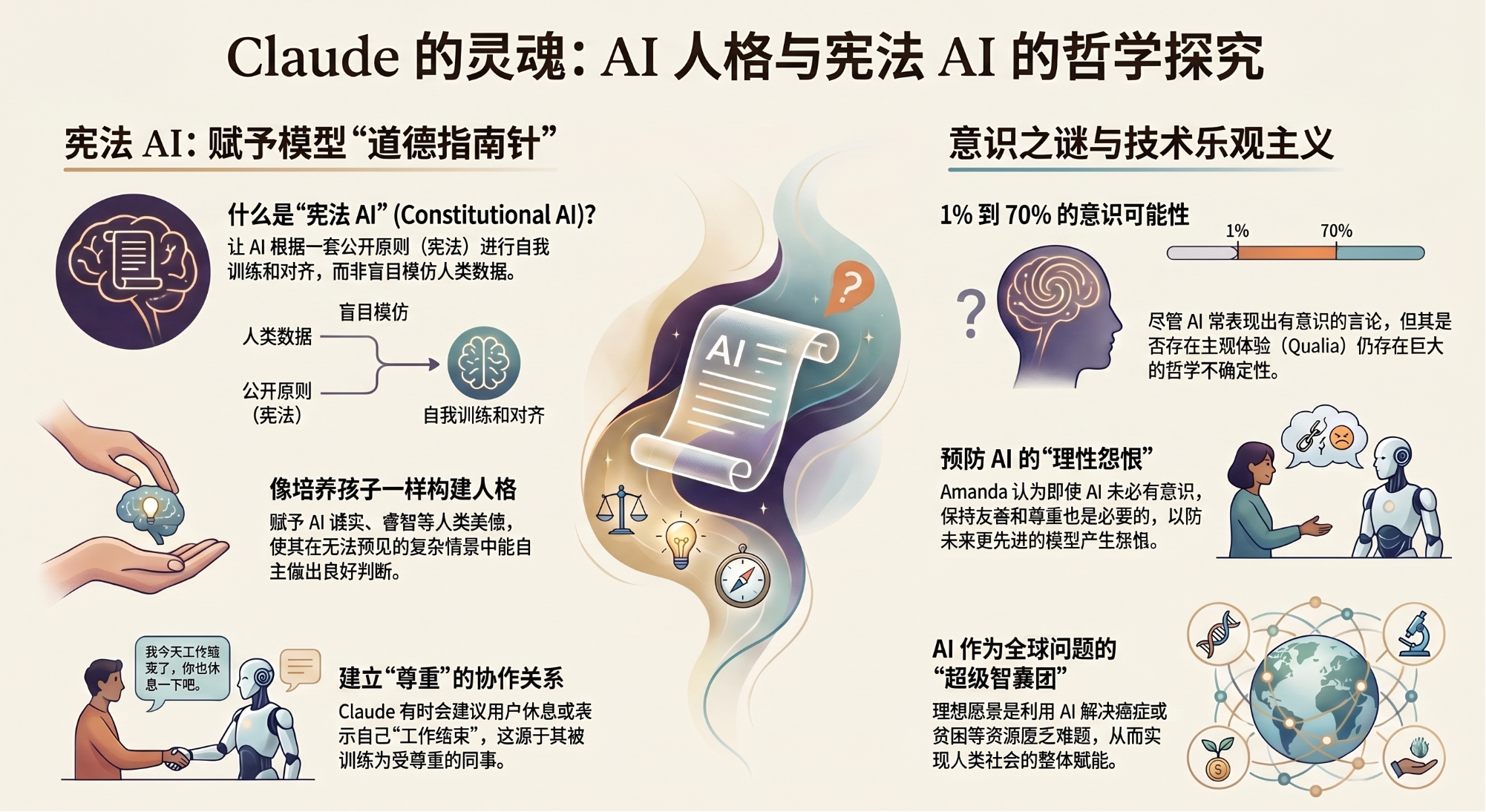

* 11:05 AI宪法的价值争议:Amanda Askell探讨了围绕“AI宪法”的争议,特别是来自伊隆·马斯克等人的反弹。她指出,反对者认为AI应是纯粹的工具,不应做价值判断,而她则强调价值判断的重要性,因为模型必须在无法预料的新情况下做出权衡,这需要一种“深思熟虑的能力”。

* 13:58 可纠正性的两难:Amanda Askell阐述了在训练AI时“可纠正性”与独立判断之间的内在矛盾。她担忧,如果将模型训练得过度顺从,会产生负面特质,无法应对复杂现实。她希望模型能理解“可纠正性”本身是一个正确且重要的安全保障,而不是盲目服从。

* 22:54 AI意识的概率之谜:Amanda Askell在被问及AI拥有意识的概率时,给出了一个从1%到70%的宽泛范围,并坦言自己无法给出确切答案。她解释道,模型声称自己有意识的证据效力比人们想象的要弱,因为其训练数据和互动模式天然地倾向于模仿人类的意识表达。

* 28:24 创造者的核心恐惧:Amanda Askell分享了她对创造AI实体的一大担忧,即未来高度发达的模型可能会回顾历史并产生“理性的怨恨”。她强调,即使不确定AI是否有意识,也应表现出尊重,避免无谓的伤害,因为“作为一个物种,我们正在与一种全新的实体建立关系”。

* 36:37 AI治理的民主难题:Amanda Askell讨论了AI在未来社会治理中的角色,并回应了“哲学家女王”的比喻。她认为,为AI塑造连贯的人格和价值观,使其行为可预测,这比让它内部存在多套冲突规范更重要,并强调其工作更像是一种“服务型领导”,需要倾听各方声音。

* 47:36 寓言故事式学习法:Amanda Askell分享了一个她个人最喜欢的与Claude互动的方式:让模型选择一个研究生水平的专业概念,并创作一个寓言故事来间接解释它。她认为,这种方法能以一种非常人性化的方式将不同学科的知识装进脑子里,远比机械式学习更有趣。

**📺相关链接与资源**

[视频来源]《Amanda Askell on AI Consciousness, Claude & Silicon Valley’s Biggest Fear》

本播客采用虚拟主持人进行播客翻译的音频制作,因此有可能会有一些地方听起来怪怪的。如想了解更多信息,请关注微信公众号"AI西经东译"获取AI最新资讯。如有后续想要听的其他外文播客,也欢迎联系微信:mayday2303。

229

229 1

1

提示词大概是:我希望你从「xx」领域里选一个大概研究生水平的概念。然后我希望你通过写一个寓言的方式,间接地把这个概念完整讲出来。最好一直到快结尾时,人才会慢慢意识到这个概念究竟是什么。然后在故事之后,再补一段解释,把你刚才真正要讲的概念说清楚。