在整个行业狂热追逐大语言模型(LLM)的浪潮中,一位关键的奠基者却选择逆流而上,断言这并非通往真正智能的正确道路。本期节目,我们邀请到图灵奖得主、“AI教父”之一的Yann LeCun,他将系统阐述为何LLM存在根本局限,并首次详细揭示他眼中能够理解物理世界、具备规划与推理能力的下一代AI架构蓝图。

Yann LeCun不仅是深度学习领域的传奇人物,更是Meta AI(FAIR)实验室的缔造者。然而,当Meta的战略重心“完完全全地聚焦在大语言模型上”时,他为何毅然选择离开,并创办新公司AMI来推动他构思多年的“世界模型”架构?在本期对话中,LeCun首次深入剖析了这一决策背后的思考,揭示了大型科技公司内部,在追求长期基础研究与短期产品变现之间的巨大张力。他将分享自己如何从早期的非生成式模型中获得灵感,并坚信只有让AI理解物理世界的因果关系,我们才能构建出真正安全、可控且可靠的智能系统。

您将了解到:

为什么被誉为“人工智能教父”之一的Yann LeCun认为,整个行业在大语言模型上走错了路?他眼中通往真正智能的蓝图究竟是什么?

大语言模型是否存在无法修复的“内在不安全性”?Yann LeCun为何认为它们永远无法做到可靠,并提出了一种截然不同的可控AI架构?

在Meta将重心全面转向LLM后,Yann LeCun为何选择离开他一手创建的FAIR实验室?这揭示了大型科技公司内部基础研究与产品变现之间的何种张力?

💡时点内容 | Key Topics

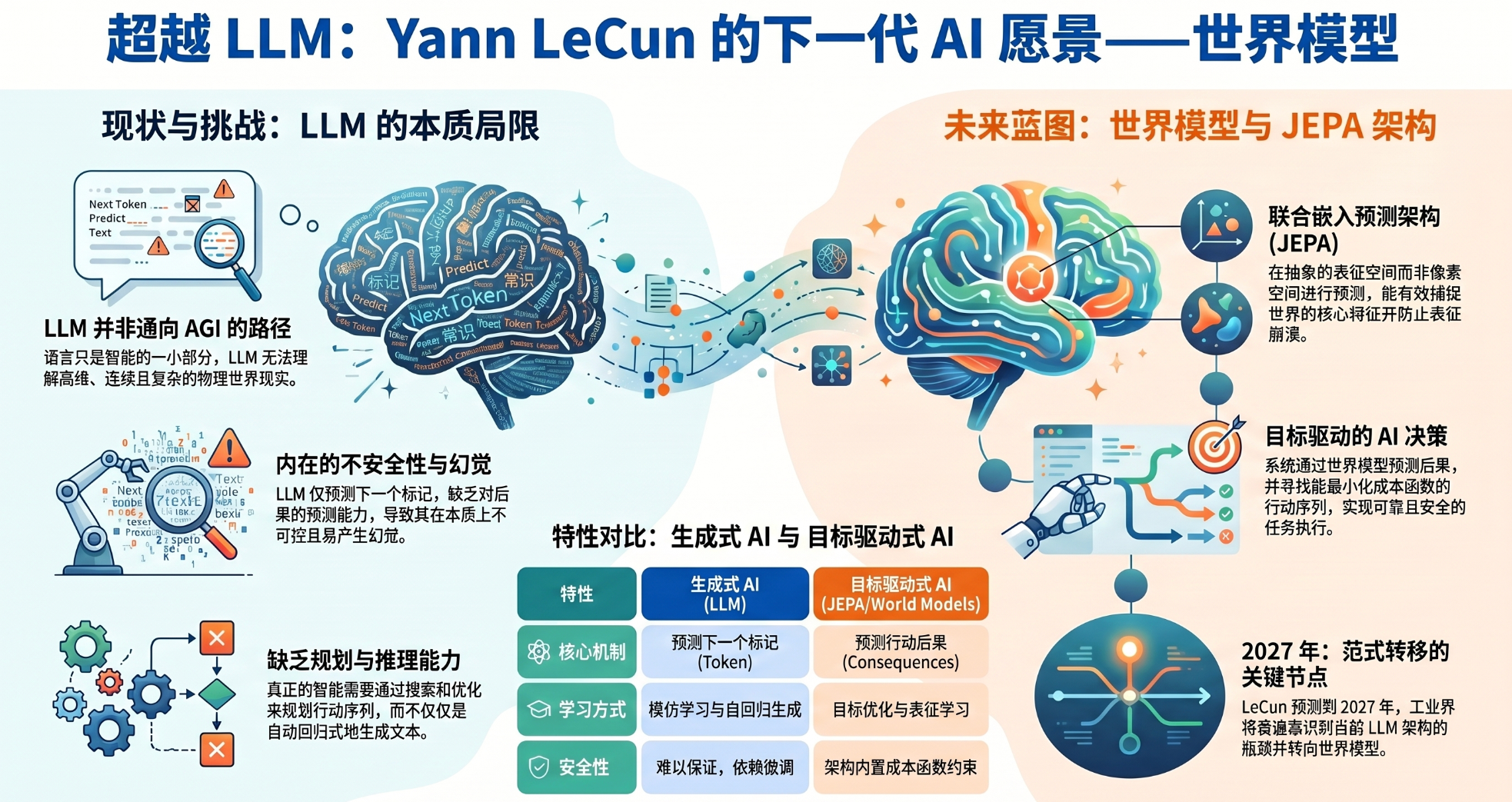

* [] 语言模型的局限性:Yann LeCun阐述了他对大语言模型的看法,他认为它们是处理语言的强大工具,但并非通往类人智能的正确路径。他强调,即便是动物级别的智能也要求对物理世界有深刻理解,而“语言是一种非常特殊的东西”,LLM的架构并不适用于理解高维、连续的真实世界。

* [] 离开Meta的真相:Yann LeCun澄清了外界对他离开Meta的误解,回顾了自己从FAIR总监转为首席AI科学家的历程,以专注于世界模型研究。他指出,随着Meta的战略重心“完完全全地聚焦在大语言模型上”,加上机器人团队被解散,公司已不再是推进他研究方向的最佳平台。

* [] 世界模型的核心蓝图:Yann LeCun定义了“世界模型”的核心概念,即“一个能让智能体系统预判自己行动后果的东西”。他指出,这种预测能力是规划和推理的基础,与大语言模型自回归式地生成下一个词元的方式完全不同,并认为这是构建真正智能系统的两大核心特征之一。

* [] 生成式方法的失败:Yann LeCun回顾了自己五年前的顿悟,他指出在学习图像和视频表示方面,所有成功的架构都是非生成式的,如JEPA。他将变分自编码器(VAE)和掩码自编码器(MAE)等生成式方法归为失败案例,认为“预测像素可以说是一条走不通的路”,因为它们无法学到有意义的抽象表示。

* [] 开源平台的未来:Yann LeCun介绍了他的Tapestry项目,旨在通过类似联邦学习的模式,构建一个开放的全球基础模型。他预测,由于各国追求“AI主权”以及平台天然有走向开放的趋势,这种模式将打破少数科技巨头的垄断,并把今天的闭源模型公司比作“昨天的Sun Microsystems和惠普的HP-UX”。

* [] 图灵奖得主的分歧:Yann LeCun透露,他与Geoffrey Hinton和Yoshua Bengio的观点分歧始于2023年GPT-4发布后。他认为,是另外两位改变了看法,开始相信大语言模型接近人类智能并担忧其风险,而他自己则始终坚持原有观点。他指出,他们的担忧更多是关于“AI的滥用而非末日论”。

* [] LLM内在的不安全性:Yann LeCun认为,大语言模型存在一种“内在的不安全性”,因为它们无法预测自身行为的后果,也无法阻止幻觉的产生。他断言,在现有范式下这个问题无解,而他所倡导的目标驱动AI架构,则可以通过内置的世界模型和成本函数,实现可控和可靠的智能。

📺相关链接与资源

[视频来源]《Yann LeCun on What Comes After LLMs》

本播客采用虚拟主持人进行播客翻译的音频制作,因此有可能会有一些地方听起来怪怪的。如想了解更多信息,请关注微信公众号"AI西经东译"获取AI最新资讯。如有后续想要听的其他外文播客,也欢迎联系微信:mayday2303。

14

14 0

0