前游戏开发者,现海外云厂商架构师 [反向弯曲] 主理的 [AI×游戏] 播客!

帮助互联网|游戏从业人员 拆解全球游戏 AI 前沿动态,深挖技术落地干货。

让你轻松拿捏行业脉搏,预判 AI + 游戏的 “下一帧”。

对未来好奇?速戳订阅!

小红书b站同名:反向弯曲

=====================================

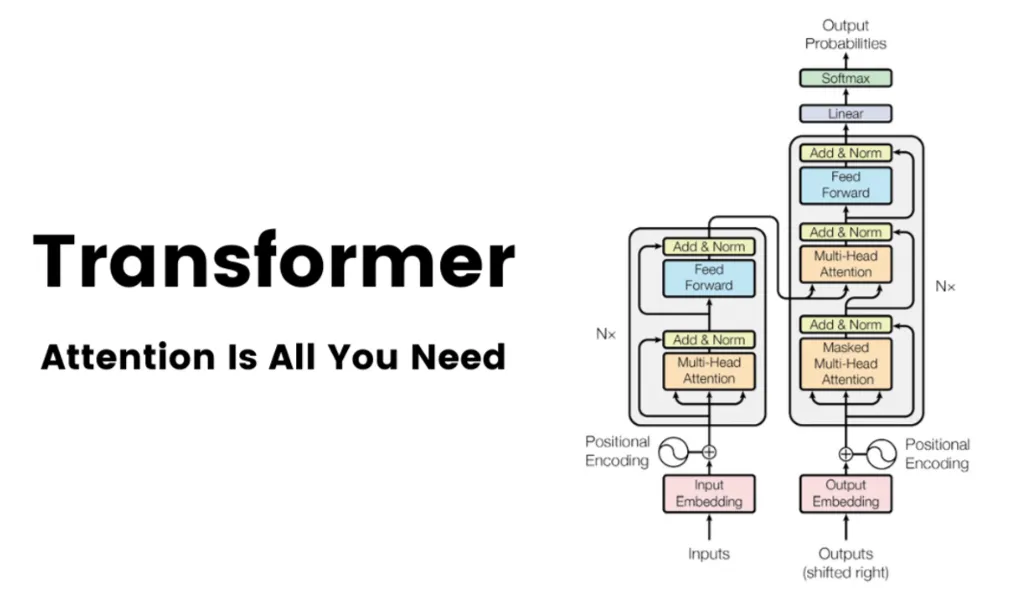

「Most of us just pretend to understand Transformers.」——这是 Reddit 上一个机器学习从业者的自白,底下几百条回复纷纷+1。ChatGPT、Claude、Gemini、Stable Diffusion、Sora,这些 AI 产品的底层都是 Transformer,但 99% 的教程都在讲公式怎么算,却不讲为什么要这样设计。这期我换个讲法:不讲公式,从用户痛点入手,用人话把 Transformer 的核心思想讲明白。Q、K、V 到底是什么?多头注意力在干嘛?它又是怎么从处理文本扩展到图像、视频的?我会用图书馆找书、派对社交这些类比帮你建立直觉,还会聊聊 Vision Transformer、Swin、Stable Diffusion 里的 Cross-Attention,以及 Sora 背后的 DiT 架构。听完这期,你可能还是写不出代码,但至少在同事聊起这些的时候,你不用再装懂了。

=====================================

03:29 Transfomer到底在解决什么问题?

04:52 QKV那个让所有人都卡住的地方

09:00 自注意力机制

10:48 多头注意力机制

12:33 位置编码

13:40 前馈神经网络

15:00 GPT和BERT有什么区别?

19:38 Vision Transfomer

21:40 Stable Diffusion 和 Sora

24:30 总结容易误解的问题

26:54 Transfomer的升级之路

=====================================

参考链接:

- The Illustrated Transformer

- 3Blue1Brown

- 跟李沐学AI

- what-changed-in-the-transformer-architecture

- Attention Is All You Need (2017)

背景音乐:

153

153 10

10