上周我受到一个邀约,主持了一场围绕具身大脑的技术分享直播。

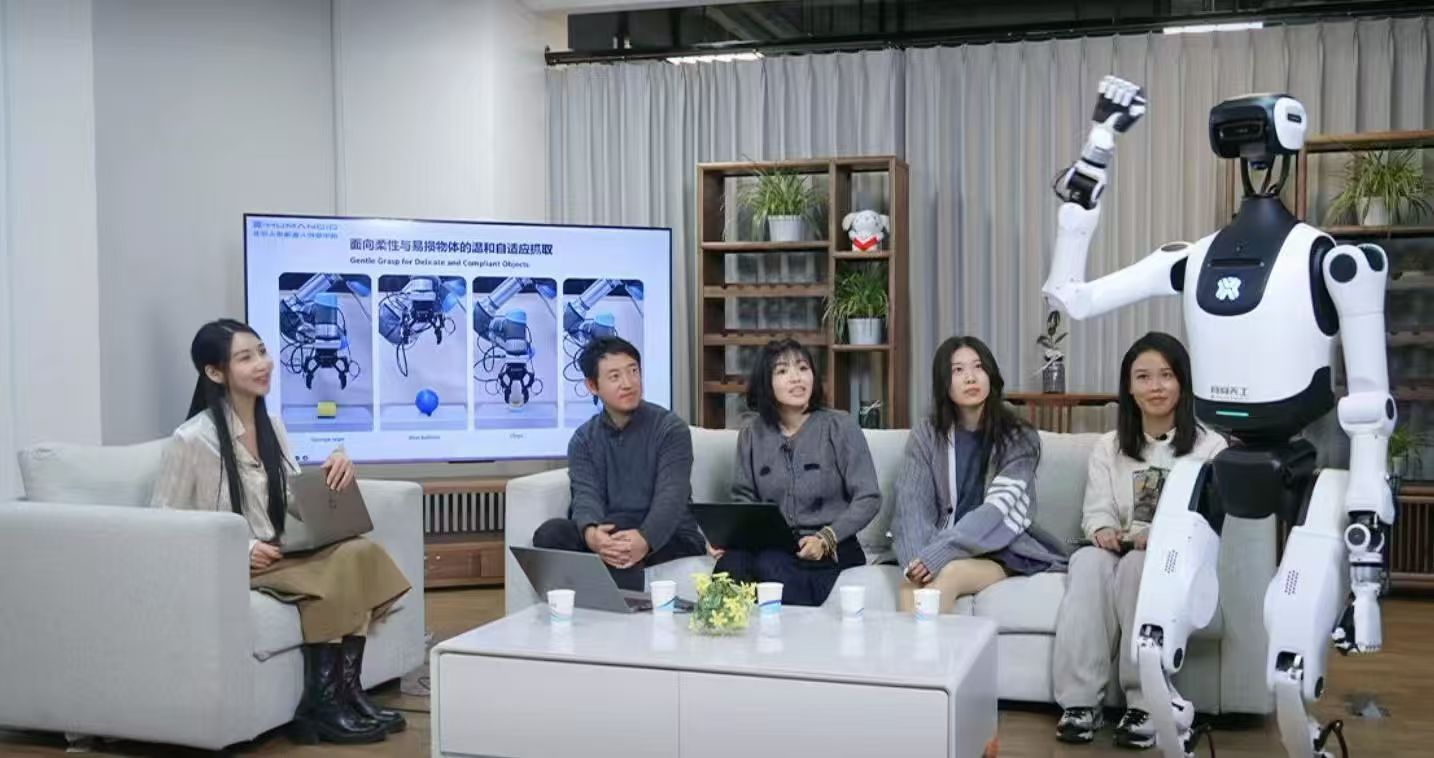

(本期视频将很快登陆b站账号。图片从左至右为:诗婕、鞠笑竹、Joy、Selina、Yoyo)

主办方是北京人形机器人创新中心,他们也是今年机器人马拉松大赛的冠军、天工机器人的主创团队。

在当下具身智能这股为机器人造脑的热潮中,北京人形这个团队也交出了自己的研究成果——

他们最新开源了具身大脑 Pelican-VL。围绕这个最大尺寸(70B)的开源具身多模态脑模型,我们逐步还原了为机器人造脑背后的全过程,并进行了包含VLM、VLA等一系列具身知识的科普,还解析了不同技术路线的差异。

围绕具身智能的学习,我已开辟了一个单独专题「Robot‘s coming!」,过往第45期节目中,我曾陪伴过人形机器人进工厂,非常合适与本期内容一起收听。这期节目的视频版也将在不久后登陆b站、视频号、小红书等平台,大家可以对照着PPT更直观地理解~也可以关注我的公众号「卫诗婕 商业漫谈」。

让我们一起学习具身领域的知识,共同迎接一种融合文明的到来~

本期嘉宾:北京人形机器人创新中心研发团队

(男)鞠笑竹 北京人形机器人创新中心大模型负责人

(女)Joy 多模态大模型算法研究员

(女)Selina 多模态大模型算法工程师

(女)Yoyo 多模态大模型算法工程师

本期Shownotes:

04:28 从自动驾驶到具身智能:传感器、摄像头与激光雷达

二者都需要感知环境、判断行动

智驾进入深水区,具身智能仍处早期,气氛较自由

RT系列:模仿学习让机器人能完成任务,但像一个没感情的执行机器

机器人需更具泛化性,能自主思考、完成多样任务

09:56 概念科普:VLM(Vision- Language-Model,视觉语言模型) & VLA(Vision- Language-Action,视觉语言动作模型)

VL负责感知,VLA(的其中一种) = VLM + Action

模型架构不断演进,核心VL部分不变

通用模型和具身之间的Gap:感知时序、理解空间,具备function call

具身智能:模型借机器人的身体,实现与物理世界的接触

大模型工作机制:DPPO(Deliberate Practice Policy Optimization)算法

当前大模型的空间感知能力不如3岁小孩

强化学习(RL)+ 监督微调(SFT):先让模型自己学习,再针对性辅导

30:40 具身智能的 Scaling Law 何时出现:视频数据 VS 具身数据

视频数据 VS 具身数据的特点

算力资源、怼数据与模型失智

不同尺寸的模型应用

多维benchmark:where to place、robospecials…

英伟达 Cosmos:衡量物理常识推理和具身决策能力

李飞飞提出世界模型的三大关键能力:多模态理解、交互、生成

为什么物理能力对具身智能很重要?

可供性(affordance):源自1977年心理学概念,对具身至关重要

大脑力控 & 触觉反馈修正

(本期内容专业性较强,可结合「商业漫谈」后续发布的视频中的PPT观看,更易理解)

加入漫谈听友群👇

7080

7080 8

8